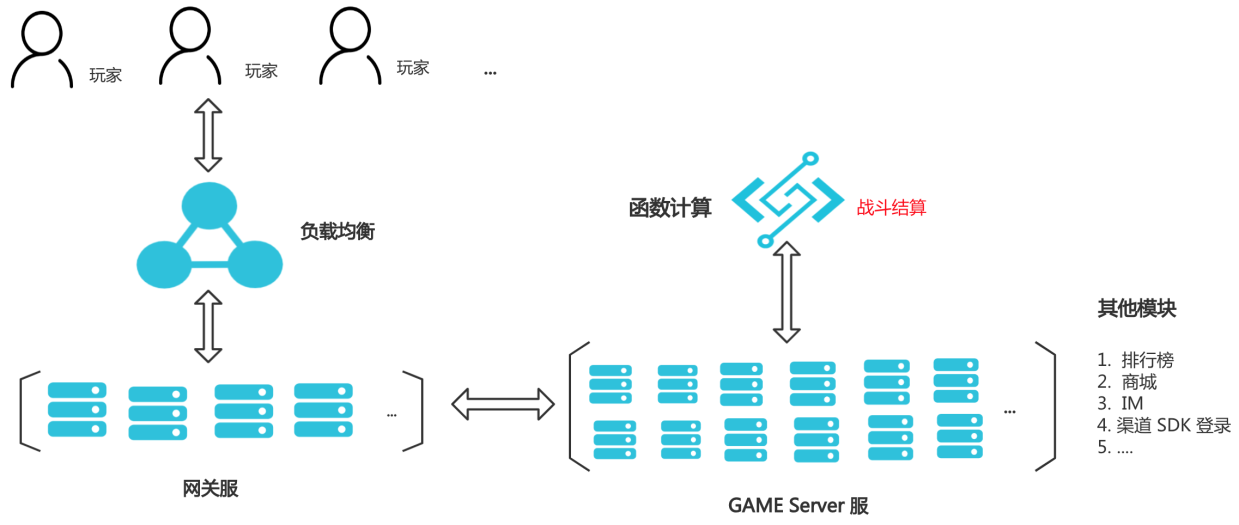

基于ECI+FaaS构建游戏战斗结算服

在游戏行业的很多SLG游戏作品中,为了防止客户端作弊,在每局战斗之后,在客户端预判玩家胜利的情况下,需要服务端来进行战斗数据的结算,从而确定玩家是不是真正的胜利。战斗结算是强CPU密集型,结算系统每日需要大量的计算力,尤其是开服或者活动期间忽然涌入的大量玩家,导致需要的计算量瞬间几倍增长,同时需要结算系统保持稳定的延时来保证玩家的用户体验。 1. ECI支持500台实例30S弹出,快速解决业务模块扩容压力。FaaS毫秒级伸缩扩容,化解算力瓶颈,平滑解决暴增调用请求。 2. 降低成本:ECI每天弹性运行8小时,与6代同规格包月相比节省成本40%+,FaaS按需付费,即开即用,节省预留资源消耗。 3. 免运维:FaaS和ECI都是全托管免运维的服务,客户专注业务开发即可。 4. 模块公共化:减轻游戏逻辑服的压力,结算需求复用到类似需求的游戏。

游戏载体区分 类别 代表作 主机游戏 使命召唤、孤岛惊魂(XBOX)、血源诅咒(PS)等 PC端游 仙剑、传奇、石器时代、大话西游等 页游 热血三国、小小海贼王、热血海贼王等 手游 王者荣耀、欢乐斗地主、开心消消乐等 H5小游戏 沙巴克传奇、小小三国志、斗罗大陆等 AR/VR游戏 一起来捉妖、我的世界、VR射击等 云游戏 格来游戏...

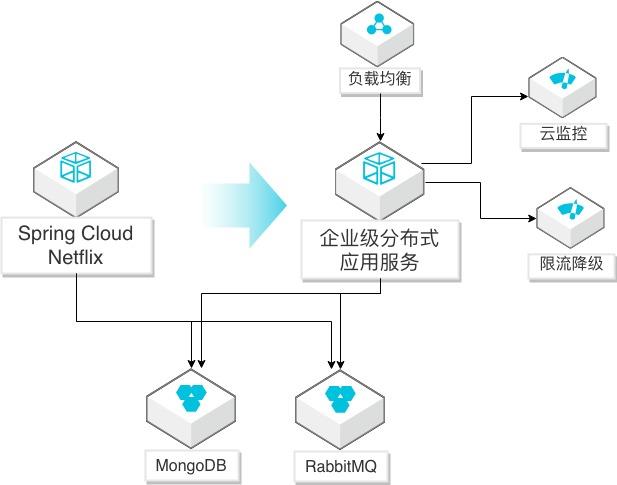

Spring Cloud Netflix应用迁移EDAS

场景描述 Spring Cloud Netflix微服务应用迁移到EDAS 服务(SpringCloud Alibaba云版本)的方法, 迁移后充分利用阿里云监控、调用链、限流降级 等能力,优化应用生命周期管理。 解决问题 1.帮助自建SpringCloudNetflix微服务应用 通过简单修改迁移到阿里云企业级分布式 应用服务(EDAS)平台。 2.迁移到EDAS后,简化应用的运维,提升监 控、调用链探测、限流降级等管理能力,提 高对应用的全生命周期管理。 产品列表 企业级分布式应用服务(EDAS) 负载均衡(SLB) 专有网络(VPC) 云服务器(ECS)

文档版本:20200106 4 Spring Cloud Netflix应用迁移 EDAS Spring Cloud Netflix应用迁移 EDAS平台介绍 2.EDAS提供了保证 SLA的服务发现与配置管理服务,您无需再自行运维 Eureka、Zookeeper、Consul等中间件,直接使用 EDAS提供的商业版服务发现与配置管 理。3.EDAS 服务治理界面提供了一个统一的服务治理控制台,目前仅...

金融专属大数据workshop

实践目标 学习搭建一个实时数据仓库,掌握数据采集、存储、计算、输出、展示等整个业务流程。 整个实时数据仓库系统全部基于阿里云产品进行架构搭建,用户可以掌握并学会运用各个服务组件及各个组件之间如何联动。 理解阿里云原生实时离线一体数仓解决方案架构以及掌握交付落地的实践使用方法。 前置知识要求 熟练掌握SQL语法 对大数据体系系统知识有一定的了解

系统架构设计 下图为所设计的系统架构设计,主要包括数据源(两类业务数据:用户行为日志和业 务后台数据库)、日志采集、日志传输、实时计算、数据存储和同步、数据展现这几 大模块共同构成实时大数据数据仓库。注:对于DIM(维度层)的维度数据可以主要使用MySQL、HBase、Hologres三种存储 引擎。对于维表数据比较少的...

来自:

最佳实践

相关产品:块存储,云服务器ECS,云数据库RDS MySQL 版,对象存储 OSS,弹性公网IP,数据传输,DataWorks,大数据计算服务 MaxCompute,DataV数据可视化,实时计算,数据总线,Quick BI,Hologres

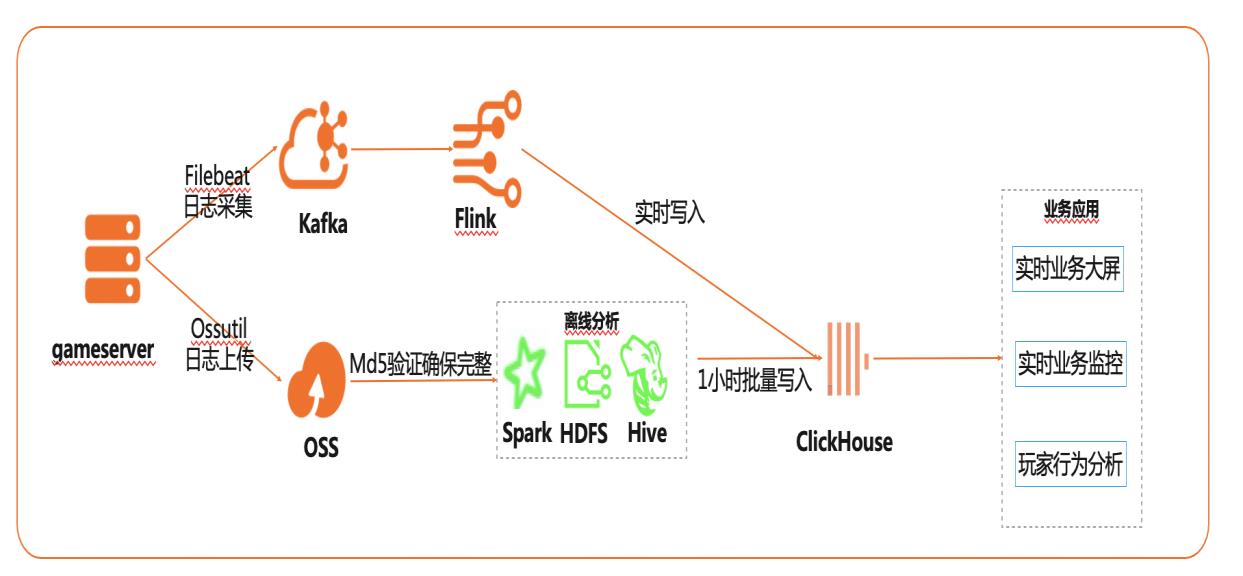

基于Flink+ClickHouse构建实时游戏数据分析

在互联网、游戏行业中,常常需要对用户行为日志进行分析,通过数据挖掘,来更好地支持业务运营,比如用户轨迹,热力图,登录行为分析,实时业务大屏等。当业务数据量达到千亿规模时,常常导致分析不实时,平均响应时间长达10分钟,影响业务的正常运营和发展。 本实践介绍如何快速收集海量用户行为数据,实现秒级响应的实时用户行为分析,并通过实时流计算Flink/Blink、云数据库ClickHouse等技术进行深入挖掘和分析,得到用户特征和画像,实现个性化系统推荐服务。 通过云数据库ClickHouse替换原有Presto数仓,对比开源Presto性能提升20倍。 利用云数据库ClickHouse极致分析性能,千亿级数据分析从10分钟缩短到30秒。 云数据库ClickHouse批量写入效率高,支持业务高峰每小时230亿的用户数据写入。 云数据库ClickHouse开箱即用,免运维,全球多Region部署,快速支持新游戏开服。 Flink+ClickHouse+QuickBI

MergeTree系 列是官方主推的存储引擎,支持几乎所有 ClickHouse核心功能。本实践以 MergeTree 系列为例进行介绍,关于如何选择 ClickHouse 表引擎,详情请参考:文档版本:20201224 32 基于 Flink+ClickHouse构建实时游戏数据分析 基础环境部署 https://help.aliyun.com/document_detail/156340.html 步骤1 创建本地表,...

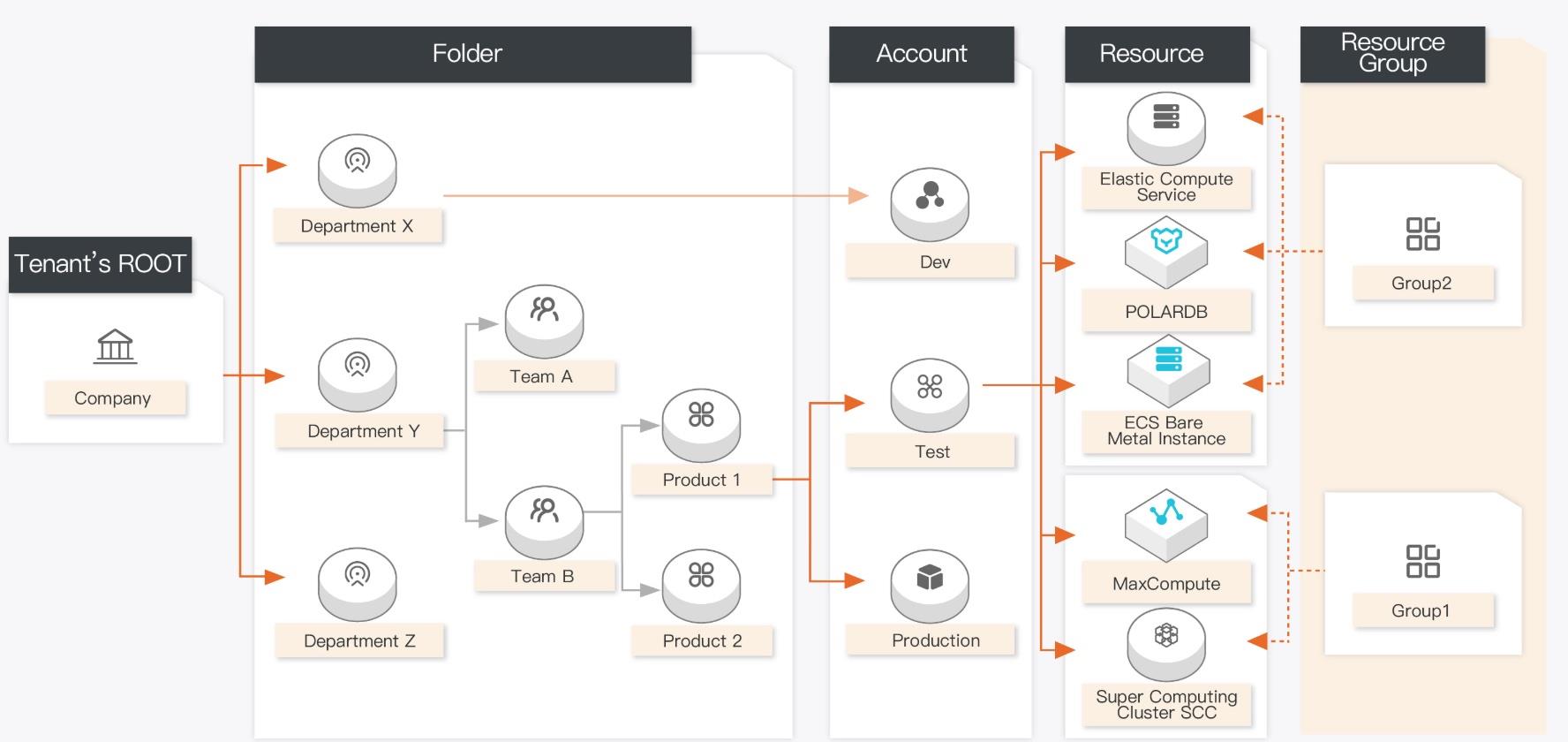

资源管理

场景描述 随着企业IT成熟度不断提高、管理的云上资源 不断增多,如何对资源进行高效管理的问题就会 凸显出来。阿里云的资源管理服务支持您按照业 务需要搭建适合的资源组织关系,使用目录、资 源夹、账号、资源组分层次组织与管理您的全部 资源,更好的实现项目成功。 解决问题 1.按照企业组织结构管理账号体系。 2.指定结算账号进行统一结算 3.统一管理成员账号权限系统 4.账号下的资源按照资源组进行分类 5.可以按照自定义财务单元进行分账管理 产品列表 资源管理

使用 RAM,您可以创建、管理 RAM用户(例如员 工、系统或应用程序),并可以控制这些 RAM用户对资源的操作权限。当您的企 业存在多用户协同操作资源时,使用 RAM可以让您避免与其他用户共享云账号密 钥,按需为用户分配最小权限,从而降低企业信息安全风险。详见:https://www.aliyun.com/product/ram 成员账号:类型分为...

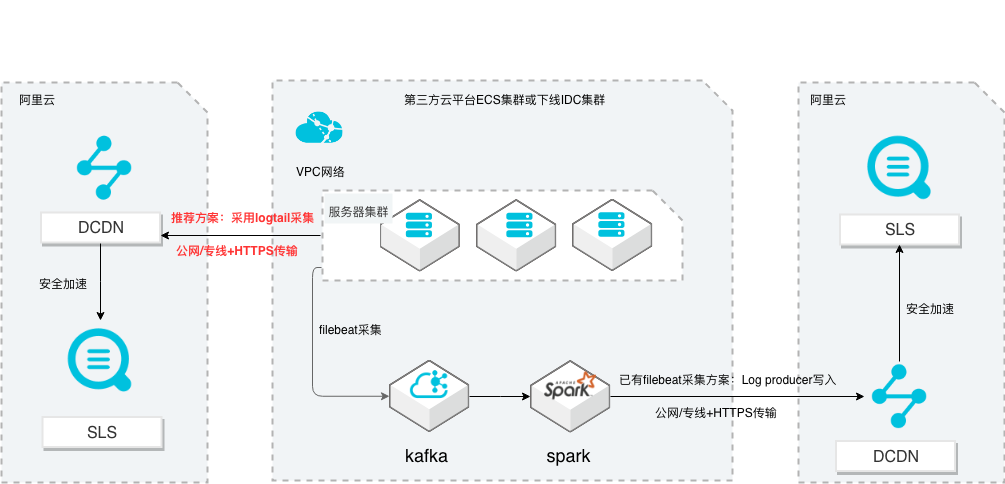

SLS多云日志采集、处理及分析

场景描述 从第三方云平台或线下IDC服务器上采集 日志写入到阿里云日志服务,通过日志服务 进行数据分析,帮助提升运维、运营效率, 建立DT 时代海量日志处理能力。 针对未使用其他日志采集服务的用户,推荐 在他云或线下服务器安装logtail采集并使用 Https安全传输;针对已使用其他日志采集 工具并且已有日志服务需要继续服务的情 况,可以通过Log producer SDK写入日志 服务。 解决问题 1.第三方云平台或线下IDC客户需要使用 阿里云日志服务生态的用户。 2.第三方云平台或线下IDC服务器已有完 整日志采集、处理及分析的用户。 产品列表 E-MapReduce 专有网络VPC 云服务器ECS 日志服务LOG DCDN

编写完成 的代码从我提供的 git仓库中获取。步骤1 使用 git clone git@code.aliyun.com:best-practice/kafka-spark-sls.git 命令下载 作业源码(前面下载过略过这步)。步骤2 使用 IDE(本例采用 IDEA)打开源码,找到 SampleProducerWithCallback这个类(这个作业是基于 Log producer 的 sample code修改的)。步骤3 找到 ...

Spark on ECI大数据分析

场景描述 方案优势 1.计算引擎弹性扩缩容,兼顾资源弹性与计 算资源成本优化。 2.计算与存储分离架构,结合阿里云原生云 存储产品,海量数据湖优势。 3.Kubernetes原生的调度性能优势,提升在 大规模分析作业时的分析性能优势分。 4.集群资源隔离和按需分配。 解决问题 1.计算资源弹性能力不足,计算资源成本管 控能力欠缺. 2.集群资源调度能力和隔离能力不足。 3.计算与存储无法分离,大数据量分析时出 现数据存储资源瓶颈。 4.Spark submit方式提交分析作业参数支持 有限等缺点。 产品列表 容器服务Kubernetes版(ACK) 弹性容器实例(ECI) 文件存储HDFS 对象存储OSS 专有网络VPC 容器镜像服务ACR

如果我 们想提升作业的运行速度,就需要提升并发的 Spark executor Pod的数量,如果我们 将并发的 Spark executor Pod的数量修改为 10,再次提交作业,由于测试使用的集 群是 2台 2核 8GB的 ECS搭建的,集群资源是非常有限的,因此会出现由于集群 Worker节点的 CPU资源不足无法起更多的 Spark executor Pod导致没有办法提升...

互联网+监管解决方案

互联网+监管解决方案基于阿里巴巴的大数据计算能力和风控模型优势,构建“互联网+监管”平台,通过多维监管数据汇聚和智能分析,实现对监管业务和科学管理决策方针,实现规范监管、联合监管、监管的全覆盖,推动政府监管更加高效、智能。

大数据计算服务是一种快速、完全托管的 GB/TB/PB 级数据仓库服务.实时计算Flink版.全链路流计算开发,涵盖数据采集到数据处理的完整流式数据处理.基于数据计算服务的数据挖掘、建模、预测的工具.支撑多种数据类型的分析展示的数据展示大屏.交互式 BI 系统.海量数据即席分析,高效地完成业务数据分析洞察.DataQ 数据资源平台...

来自:

解决方案

CentOS到Alinux操作系统迁移

操作系统迁移解决方案为企业提供ECS实例运行的操作系统EOL(生命周期结束)后的替换或升级服务。满足在控制台一键备份和迁移的能力,具有界面易用、过程可靠、数据安全的优势。

操作系统迁移解决方案为企业提供ECS实例运行的操作系统EOL(生命周期结束)后的替换或升级服务。满足在控制台一键备份和迁移的能力,具有界面易用、过程可靠、数据安全的优势。CentOS到Alinux操作系统迁移 操作系统迁移解决方案为企业提供ECS实例运行的操作系统EOL(生命周期结束)后的替换或升级服务。满足在控制台一键...

来自:

技术解决方案

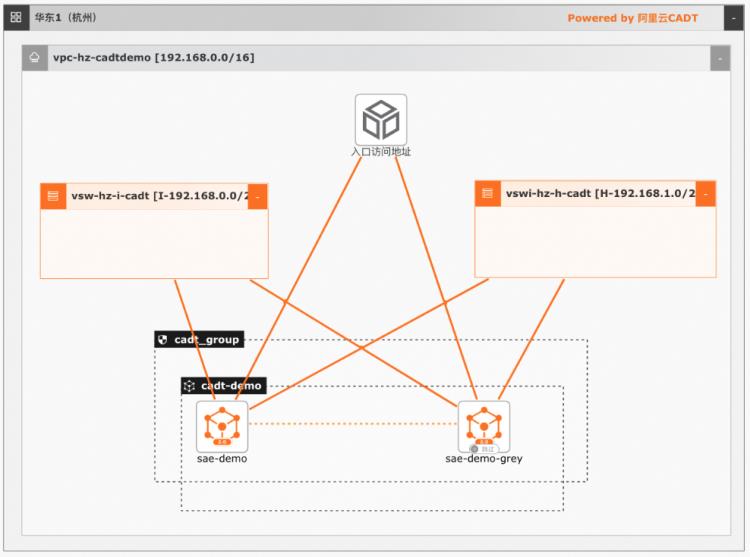

基于SAE的一站式Web服务托管方案

通过SAE提供的内置CICD能力,代码提交后可以触发自动构建,并部署应用到SAE,部署完成后,应用自动产生访问域名,外部请求通过域名可以直接访问应用。SAE提供了内置的可观测,灰度,回滚能力,通过控制台可以白屏化完成整个操作。SAE适合应用容器化快速上云,客户只需要提供代码仓库,后续的CICD,应用访问,弹性管理,运维监控,SAE都提供了内置的集成能力

基于SAE 2.0的一站式 Web服务托管方案 业务架构 场景描述 Web服务在互联网架构中有广泛的应用,通过 SAE提供的一站式方案,可以快速完成 CICD整 个流程,并且通过 SAE的内置能力,可以快速完 成灰度发布,应用观测,异常回滚等能力。应用场景 通过 SAE提供的内置 CICD能力,代码提交后可 以触发自动构建,并部署应用到 SAE...

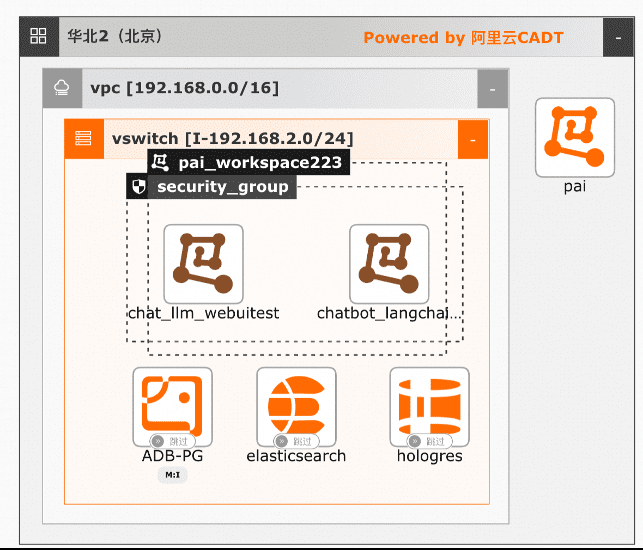

大模型RAG对话系统部署

大模型RAG对话系统最佳实践,旨在指引AI开发人员如何有效地结合LLM大语言模型的推理能力和外部知识库检索增强技术,从而显著提升对话系统的性能,使其能更加灵活地返回用户查询的内容。适用于问答、摘要生成和其他依赖外部知识的自然语言处理任务。通过该实践,您可以掌握构建一个大模型RAG对话系统的完整开发链路。

大模型 RAG对话系统部署 最佳实践 业务架构 场景描述 大语言模型(LLM)在生成准确和实时的回复方面存 在局限性,不适合直接用于需要精确信息的客服或问 答等场景。当前业界普遍采用基于检索增强的 RAG 技术来改善 LLM的表现。该方法通过结合 LLM的归 纳生成能力和向量检索库的检索能力,增强对用户查 询的理解,并产生更加...

系统运维管理 OOS

阿里云系统运维管理(简称OOS)提供的云上自动化运维服务,通过执行模板来完成任务的自动化运行,可以使用OOS管理ECS、RDS、SLB、VPC等云产品,提升日常运维管理效率

使用运维编排 OOS 实现 ECS 的定时管理如果您需要对云服务器ECS做一些重复性的运维管理操作,比如周期性进行系统漏洞修复、定时在ECS内执行某些命令、批量更换ECS实例的系统盘等,可以通过运维编排 OOS 轻松搞定。运维编排支持的自动化任务包括定时任务、周期性任务、批量任务等。35分钟查看教程查看更多技术解决方案周期性...

来自:

云产品

SpringCloud应用托管到ACK服务

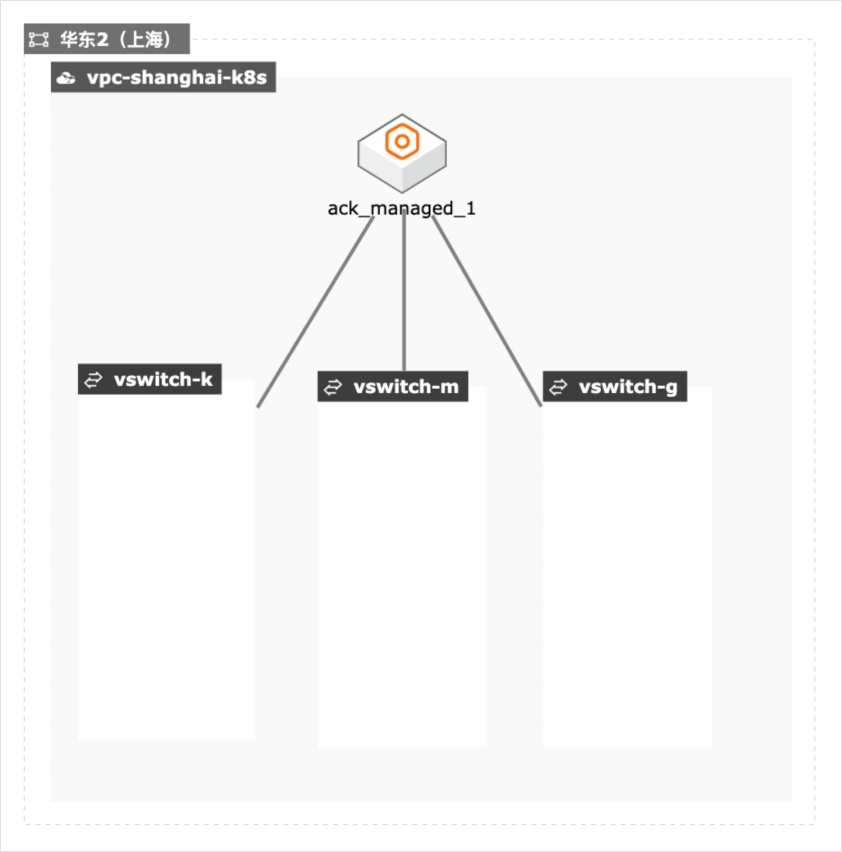

场景描述 本实践适用于将SpringCloud应用托管到 ACK服务的场景中,创建容器服务ACK后, 利用Helm一键部署SpringCloud应用,将 SpringCloud应用托管到容器服务ACK。 解决问题 1.将SpringCloud应用托管到容器服务 ACK 产品列表 容器服务ACK 云服务器ECS

SpringCloud应用托管到 ACK服务 最佳实践 部署架构图 场景描述 本实践适用于将 SpringCloud应用托管到 ACK 服务的场景中,创建容器服务 ACK后,利用 Helm 一键部署 SpringCloud应用,将 SpringCloud应 用托管到容器服务 ACK。解决问题 将 SpringCloud应用托管到容器服务 ACK 产品列表 容器服务 ACK 云服务器 ECS 云速搭 ...

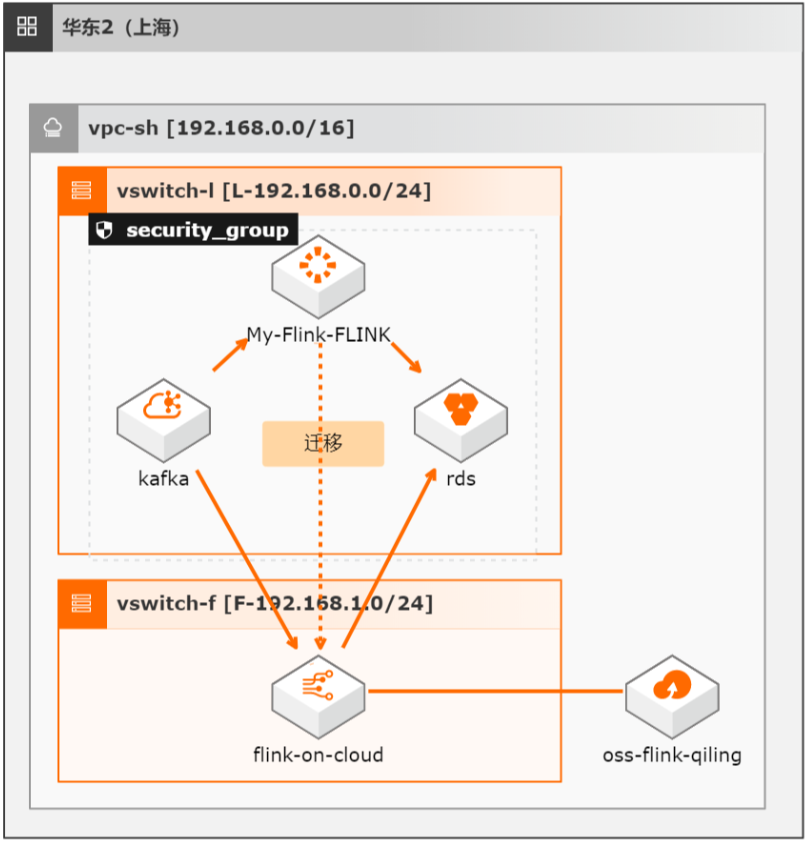

开源Flink迁移实时计算Flink全托管版最佳实践

本方案介绍如何将自建开源Flink集群的流式任务(包含Datastream、Table/SQL、PyFlink任务)迁移至阿里云实时计算全托管版。

开源 Flink迁移实时计算 Flink全托管版 最佳实践 业务架构 场景描述 解决的问题 Flink全托管产品(Flink Serverless)是一款基于 Flink各类任务如何迁移 Apache Flink 构建的全托管产品,为您提供全托 数据准确性如何校验 管一站式的实时计算服务,具有免运费、高增值、业务稳定性如何验证 低成本等特性。本方案介绍如何将...

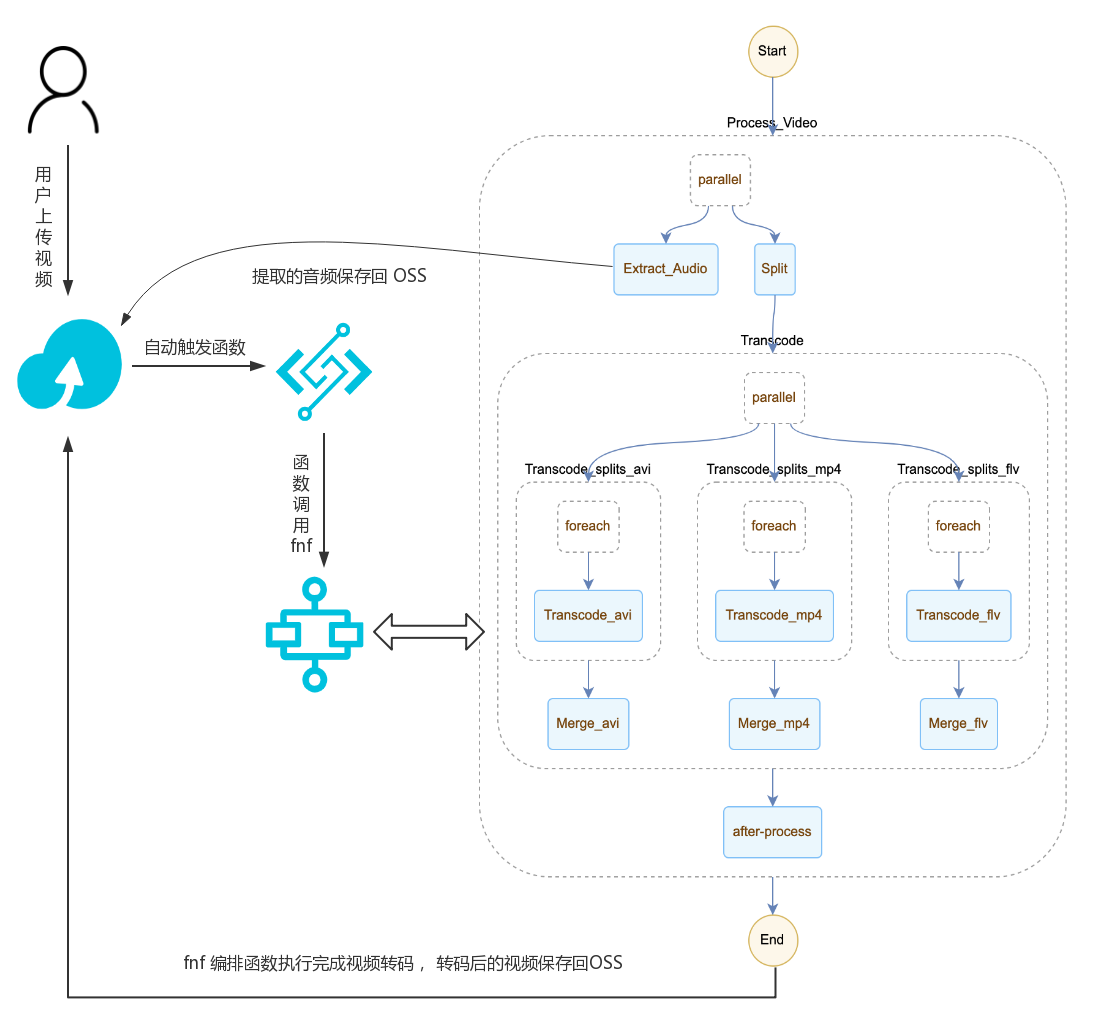

函数计算实现弹性音视频处理系统

场景描述 本示例通过函数计算部署一个高弹性高可用的 音视频处理系统。尤其适合视频网站使用,每天 有大量的上传视频,需要及时转码处理以适配各 种终端及网络条件,要求短时间内准备大量的计 算资源进行大规模并行转码处理,同时希望基于 FFmpeg自建的转码服务能简单迁移。 解决问题 1.如何使用函数计算部署音视频处理系统。 2.如何进行系统的压测。 产品列表 函数计算服务 文件存储NAS 对象存储OSS 函数工作流FnF 日志服务SLS

这使您的函数可以像访问本地文件系 统一样编写访问存储在其中一个 NAS 文件系统上的文件。详见 https://cn.aliyun.com/product/nas 对象存储 OSS:海量、安全、低成本、高可靠的云存储服务,提供 99.9999999999%的数据可靠性。使用 RESTful API 可以在互联网任何位置存储和访问,容量和处 理能力弹性扩展,多种存储类型供...

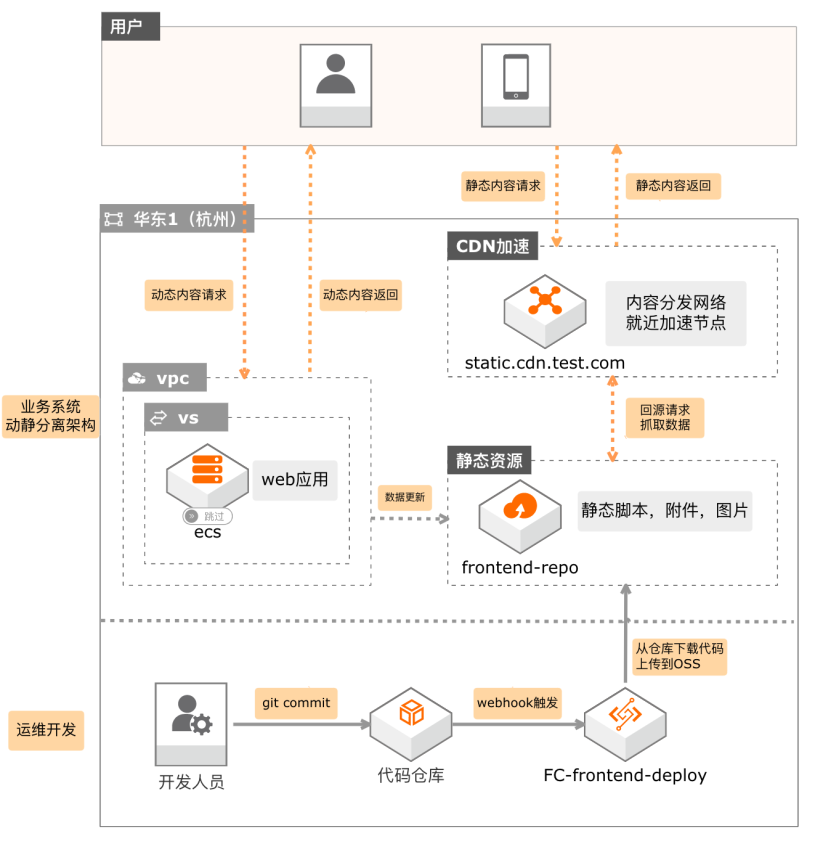

Function Compute搭建前端CICD系统

场景描述 传统动静不分离的产品架构,随着访问量在增 长,性能会成为瓶颈。在这种情况下,用户可以 通过利用OSS和CDN对网站进行架构优化, 做到网站文件的动静分离,提升用户访问体验, 实现成本可控。本方案使用函数计算监听前端代 码库提交的分支变更,上传分支文件至OSS,通 过CDN进行前端资源加速。 方案优势 1.面向serverless:无需购买服务器 2.免运维:无需部署配置Jenkins 3.提供日志查询、性能监控和报警等功能 4.一站式:事件驱动方式触发响应 5.费用极低:按需付费 产品列表 专有网络VPC 对象存储OSS 日志服务SLS 函数计算 CDN

Function Compute计算搭建前端 CICD系统最佳实践 业务架构图 场景描述 传统动静不分离的产品架构,随着访问量在增 长,性能会成为瓶颈。在这种情况下,用户可 以通过利用 OSS和 CDN对网站进行架构优 化,做到网站文件的动静分离,提升用户访问 体验,实现成本可控。本方案使用 Function Compute监听前端代码 库提交的分支...

云速搭部署 NAS 文件系统

本实践通过云速搭构建一个 NAS,并将 NAS 文件系统挂载到 ECS 的目录上。

云速搭部署 NAS文件系统 文档版本信息 云速搭 部署 NAS文件系统 最佳实践 文档版本:20211027(发布日期)云速搭部署 NAS文件系统 文档版本信息 文档版本信息 文本信息 属性 内容 文档名称 云速搭部署 NAS文件系统 文档编号 245 文档版本 V1.0 版本日期 2021-10-27 文档状态 对外发布 制作人 洁谦 文档变更记录 版本编号 ...

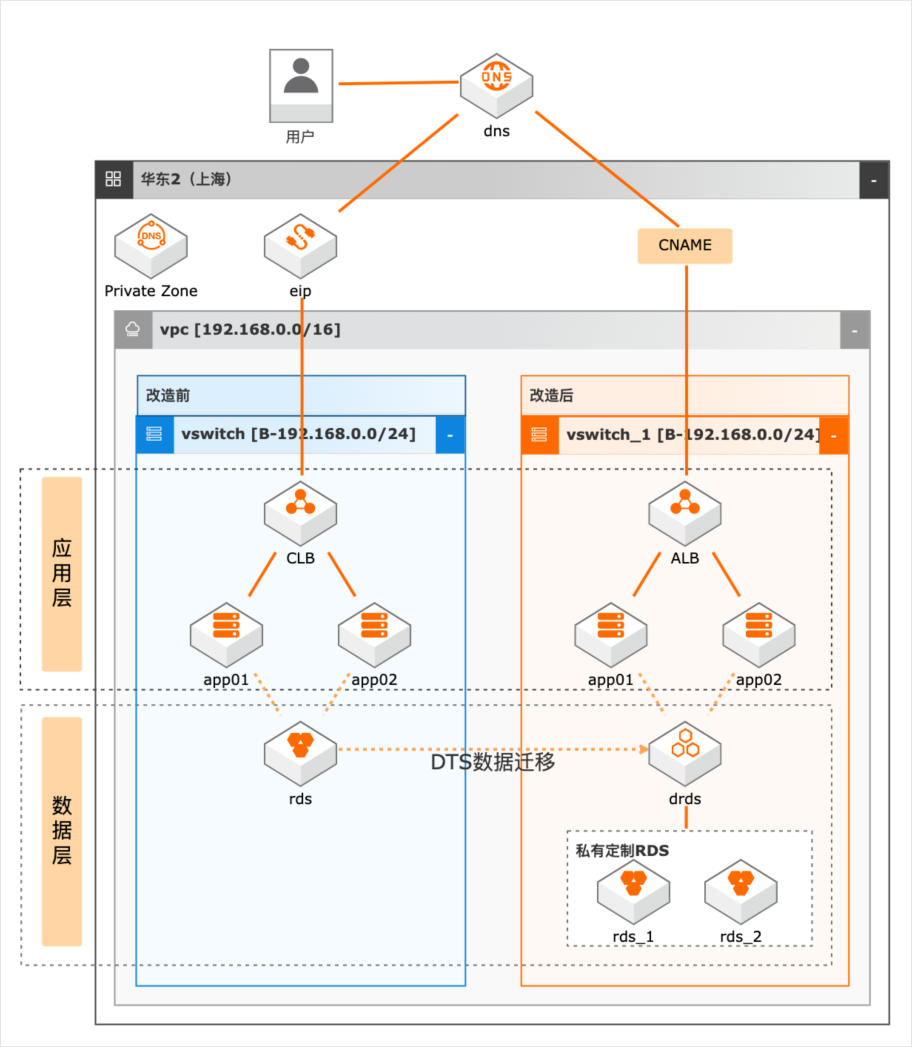

云上高并发系统改造

场景描述 随着业务的发展,系统并发压力越来越大,如何 进行系统改造以满足高并发场景的业务需求成 为了一个技术难题。本实践抽象于客户的实际场 景,提供高并发下系统改造的理论指导和部分实 操演示。主要适用于以下场景: 1.系统并发压力大,需要进行系统应用改造。 2.数据层并发压力大,需进行分库分表改造。 3.数据库数据量巨大,亟待分库分表解决查询 和写入瓶颈的场景。 方案优势/解决问题 1.在水平扩展阶段,我们除了通过SLB做负载 均衡外,我们可以通过SLB下挂nginx的方 式,增加负载均衡侧的可扩展性 2.在数据库拆分阶段,在做好数据规划后,我 们借助DTS进行数据迁移,通过DRDS将 RDS MySQL的数据拆分到多个分库和分 表中。 产品列表 专用网络VPC 负载均衡SLB 云服务器ECS 数据库RDSMySQL 数据传输服务DTS PrivateZone 分布式关系型数据库DRDS

尽可能避免跨库查询:关联查询的数据尽量分散到同一个分片中,跨库查询对系 统性能损耗很大。避免跨分表联表查询的方式有:a)剥离出高频访问的表,与核心表 1:1关系的,进行反范式设计,将核心表加 宽 b)如果与核心表是 N:1关系的,将高频访问字段冗余到核心表中 c)低频访问数据,业务功能设计上,避免一页展示大而全,...

- 产品推荐

- 这些文档可能帮助您