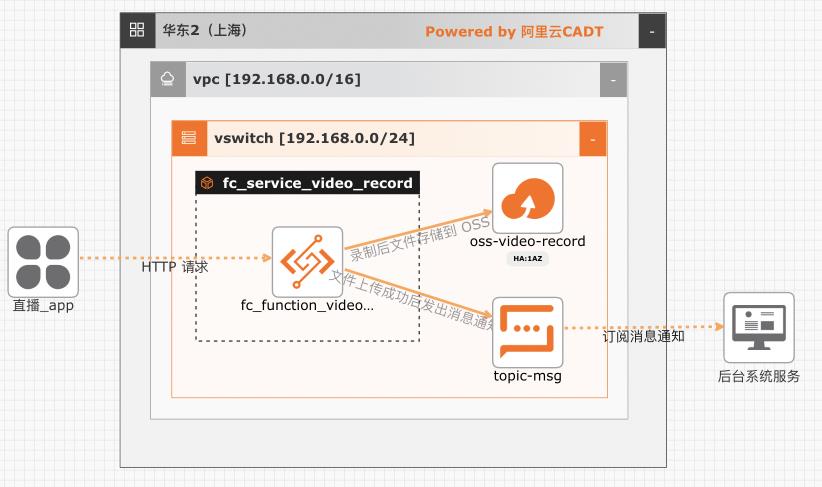

基于函数计算实现直播流录制-存储-通知

在互娱、教育、电商等行业都会有直播相关的业务,大部分场合都需要对直播相关的业务做安全审核,或者对直播的课程进行录制和转码。该方案实现了一种完全按需拉起、按量弹性、按实际使用付费的录制方案。基于本方案还可以扩展实现直播流截帧、自动化安全审核等能力

一键释放资源.30 文档版本:20240227 III 基于函数计算实现自定义直播-拉流-录制-存储-通知 最佳实践概述 最佳实践概述 方案概述 在互娱、教育、电商等行业都会有直播相关的业务,大部分场合都需要对直播相关的业务做安 全审核,或者对直播的课程进行录制和转码。该方案实现了一种完全按需拉起、按量弹性、按 实际使用付费...

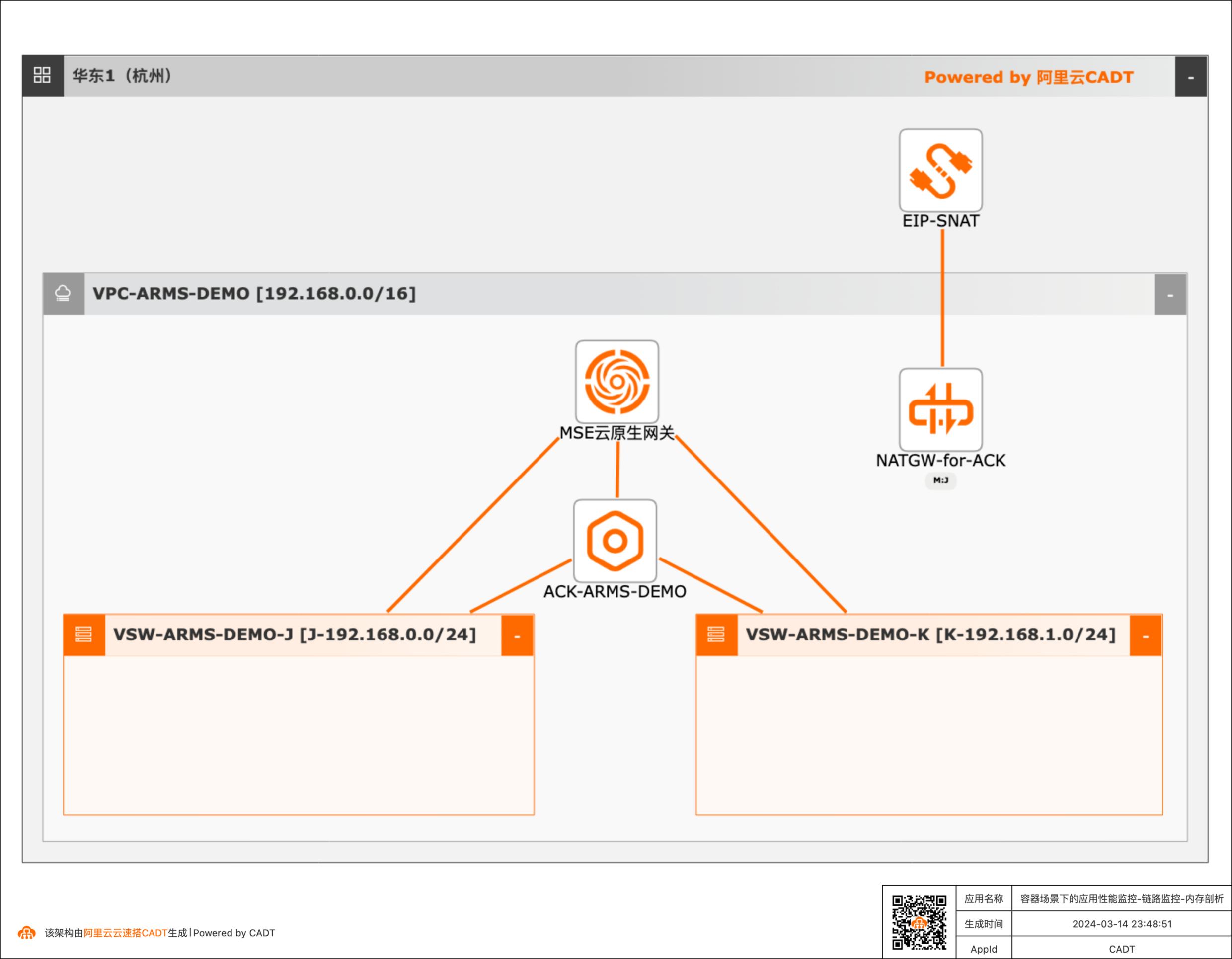

容器场景下的应用性能监控、调用链拓扑、内存剖析

场景描述 随着云原生及微服务技术的普及,越来越多的系统已经通过云原生和微服务技术实现企业的降本增效,同时因微服务及云原生的复杂性给系统运维带来非常大的挑战,云原生应用监控arms通过全链路应用监控,从端到端及代码级别的链路下钻能力、CPU、内存持续剖析及诊断能力,帮助客户降低系统故障定位难度,此demo,您将体验arms的链路监控、内存剖析等能力 应用场景 微服务+容器场景下链路调用拓扑,调用链可以显示出服务之间的调用顺序和层次关系,帮助开发人员理解和追踪代码的执行流程 在分布式系统中,一个请求往往需要通过多个服务来完成。当出现问题时,如请求超时、错误或异常,很难快速定位问题所在。 解决问题 调用链可以帮助运维人员解决以下问题: · 故障排查:当请求失败或出现错误时,调用链可以显示整个请求的路径和每个服务的执行情况,从而帮助运维人员快速定位问题所在。 · 性能优化:通过调用链,运维人员可以了解请求在系统中的执行时间和瓶颈所在,从而进行优化。 · 系统监测:调用链可以提供实时的系统监测和分析,帮助运维人员了解系统的健康状况和资源利用情况。

网络架构: 整个方案会在某个Region下,该示例使用的是杭州Region 在Region下会创建1个VPC 在该VPC下会创建2个交换机分布在J和K可用区 在该VPC下会创建一个安全组(ACK自动创建) ACK在该VPC的交换机下,NODE节点分布在2个交换机 1个EIP+1个NATGW用于VPC内的NODE节点访问外网拉取镜像使用 在VPC下...

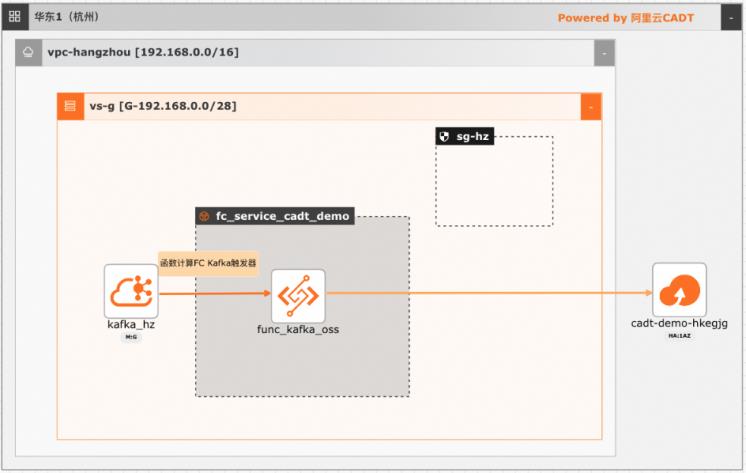

基于函数计算FC实现阿里云Kafka消息轻量级ETL处理

在大数据ETL场景,Kafka是数据的流转中心,Kafka中的数据一般是原始数据,可能存在多种数据混杂的情况,需要进一步做数据清洗后才能进行下一步的处理或者保存。利用函数计算FC,可以快速高效的搭建数据处理链路,用户只需要关注数据处理的逻辑,数据的触发,弹性伸缩,运维监控等阿里云函数计算都已经做了集成,函数计算FC也支持多种下游,OSS/数据库/消息队列/ES等都可以自定义的对接

专有网络 VPC 阿里云交换机 解决问题 阿里云安全组•快速搭建起数据处理全链路 阿里云函数计算(FC)•全链路自适应弹性,无需为流量峰谷做频繁 对象存储 OSS 的手工处理 阿里云云消息队列 Kafka 版•内置 CICD平台能力,灰度,回滚,监控开箱 云速搭 CADT 即用•按量付费,没有资源闲置费用 最佳实 践频道 ...

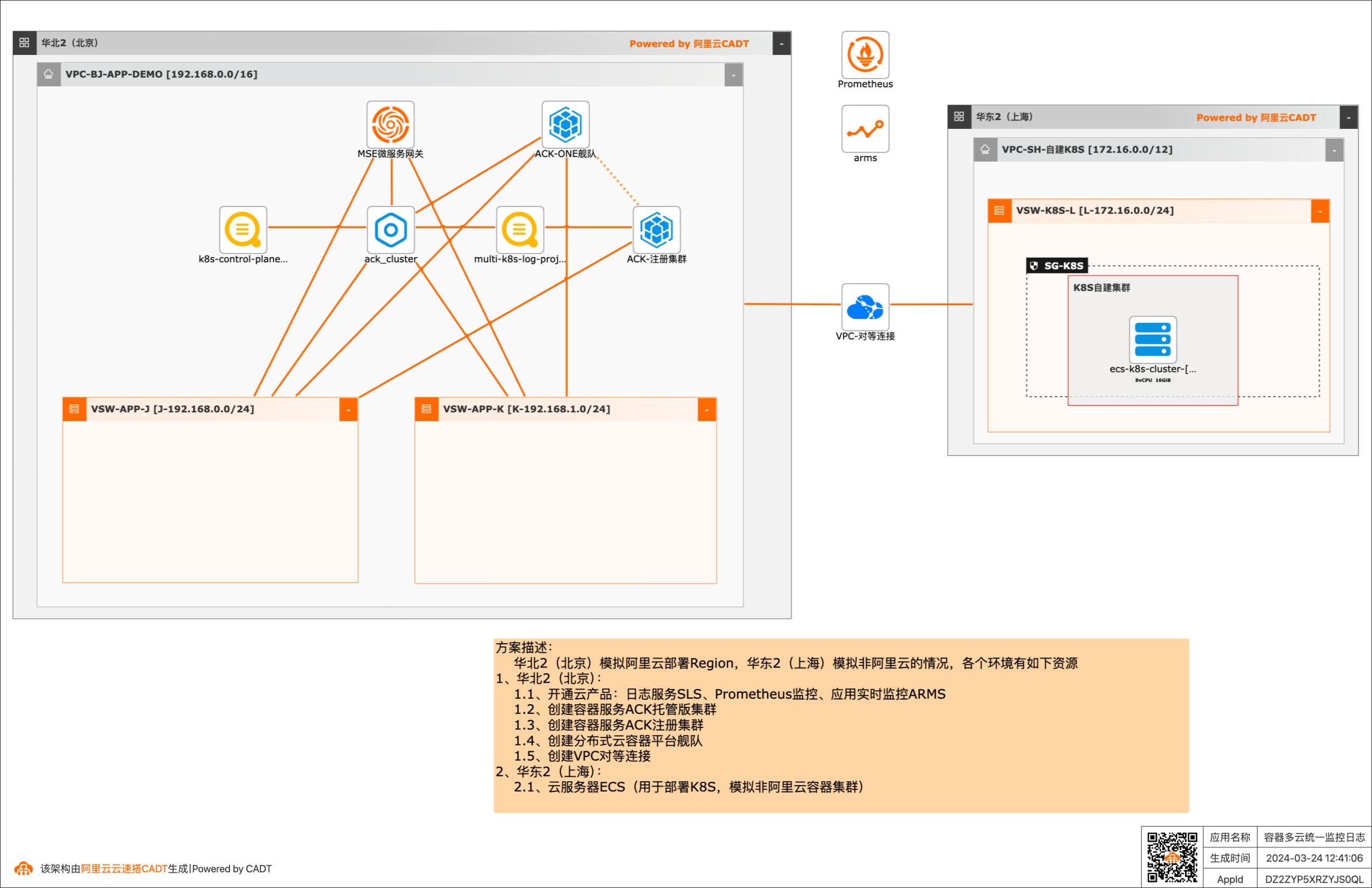

容器多云统一监控日志

多云、混合云成为常态,Forrester 报告中指出,未来 89% 的企业至少使用两个云,74% 的企业至少使用三个甚至更多公有云,在面对多云/混合云这样大的趋势下,Gartner报告指出,安全、运维复杂性、财务复杂性是多云架构的主要挑战,本方案给出了在多云/混合云场景下,构建基于容器环境下的统一管理、统一监控和统一日志方案,解决多云、混合云场景下,运维复杂性问题。 应用场景 客户在阿里云以外的其他云服务商(AWS、Azure、GCP、TencentCloud、HuaweiCloud等)或者IDC基于容器(Kubernetes)运行业务系统,希望构建容器场景下的统一监控日志系统,方便做不同大屏和问题分析定位。 解决问题 •构建容器多云统一监控和日志系统,在一个平台可以看到不同环境系统的运行情况。

容器多云统一监控日志 最佳实践 业务架构 场景描述 多云、混合云成为常态,Forrester报告中指出,未来89%的企业至少使用两个云,74%的企业 至少使用三个甚至更多公有云,在面对多云/混 合云这样大的趋势下,Gartner报告指出,安全、运维复杂性、财务复杂性是多云架构的主要挑 战,本方案给出了在多云/混合云场景下,构建 ...

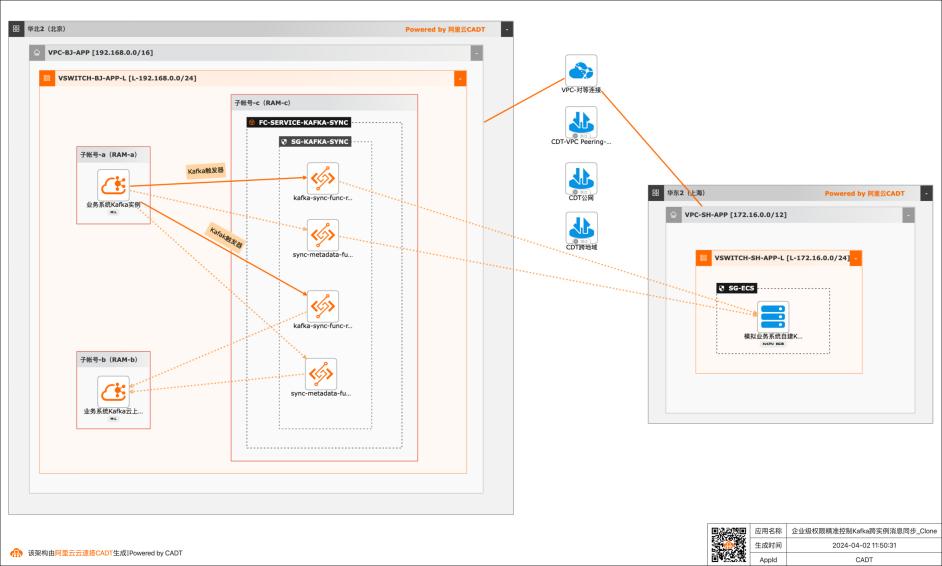

基于函数计算FC实现企业级权限精准控制Kafka跨实例消息同步

应用场景 在大数据场景,企业的Kafka实例可能存在多种情况,比如使用阿里云Kafka服务,可能是自建开源Kafka,或者是其他云上的云Kafka。不同的业务使用不同类型的Kafka实例,在这个前提下Kafka实例之间可能会需要消息同步的情况: 同帐号容灾场景:比如Kafka实例都是阿里云Kafka,但是Kafka实例会有主备之分,需要将主Kafka实例的消息实时同步到备Kafka。 跨帐号或异地容灾:这类场景比如主Kafka是阿里云Kafka,备Kafka是IDC开源自建Kafka,或者是其他云上的Kafka。 不同业务之间消息同步:因为现在的业务通常不会是信息孤岛,都需要消息互通,所以可能是A业务的Kafka实例消息需要同步到B业务的Kafka实例,并且这两个Kafka实例归属不同的RAM角色,有自己独自的权限控制。 解决问题 解决使用开源组件做消息同步的高成本问题。 解决使用开源组件做消息同步的并发性能、稳定性问题。 解决使用开源组件做消息同步的可靠性问题(重试机制,容错机制,死信队列等)。 大幅提升构建消息同步架构的效率,降低构建复杂度问题。

文档版本:20240330 10基于函数计算FC实现企业级权限精准控制Kafka跨实例消息同步 部署基础环境 CADT可以一站式的帮用户创建实例、部署实例、创建Topic/Group,所以这里可以 一气呵成的将这些配置信息全部设置好,相较在产品控制台上多个步骤,跳转多个页 面做开通部署配置的传统方式,CADT这种模式可以极大提高效率。...

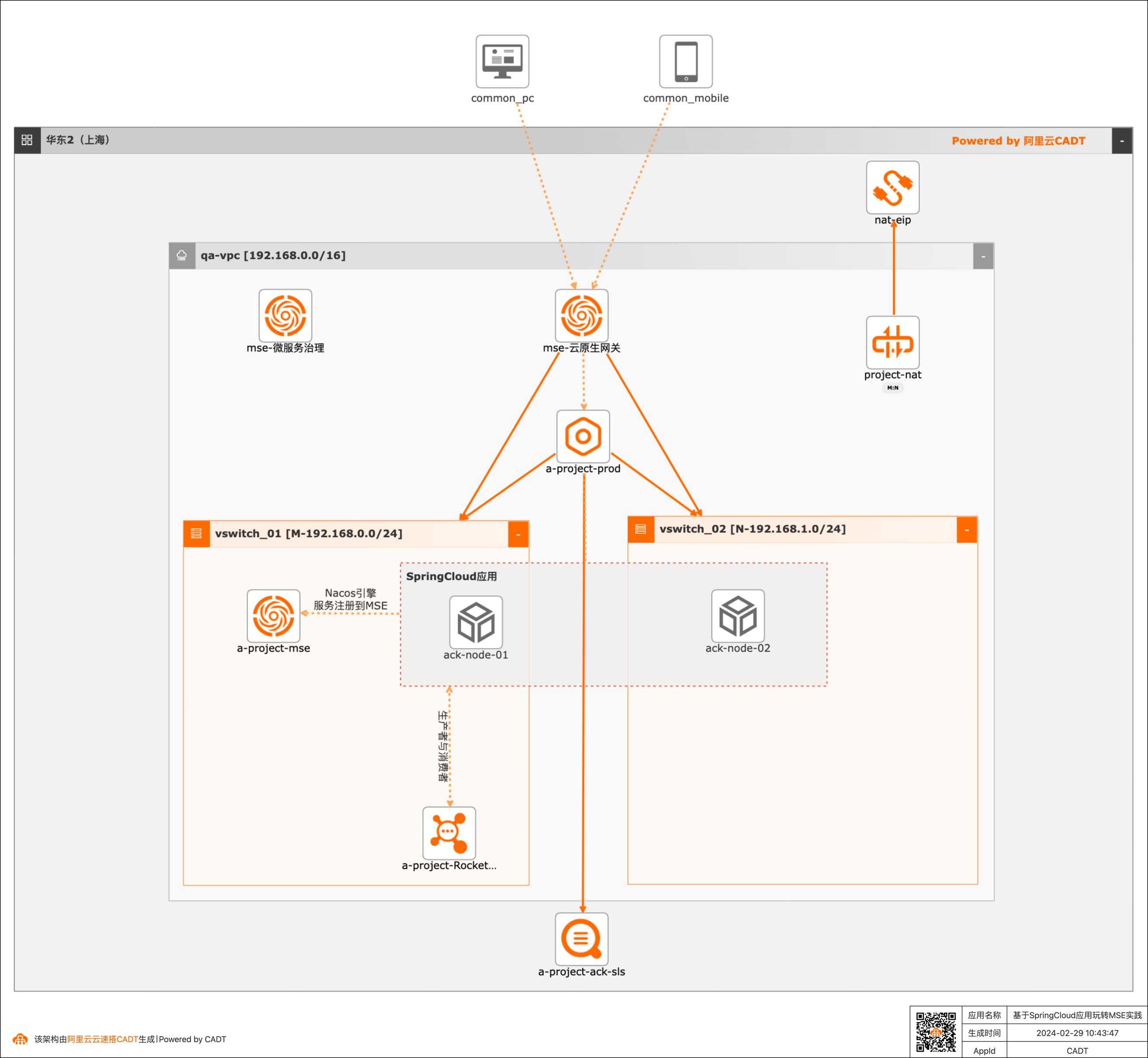

基于SpringCloud应用玩转MSE实践

随着业务不断创新,大型的单个应用和服务会被拆分为数个甚至数十个微服务,微服务架构已经被广泛应用。 微服务的好处在于快速迭代,如何在迭代过程中保障线上流量不受损。依赖开源产品缺少无运维工具,常常需要投入较大的运维人力和成本。 本实践提供基于云原生应用产品提供微服务注册配置中心、微服务治理和云原生网关等一系列高性能和高可用的企业级云服务能力。

弹性公网IP:是独立的公网IP资源,可与阿里云专有网络VPC类型的云服务器ECS、NAT网关、ENI 网卡、私网负载均衡SLB绑定,并可以动态解绑满足灵活管理的要求。弹性公网IP可为您在云上部署 的网站提供Internet访问服务。 NAT网关(NATGateway)提供公网NAT和私网NAT两种功能。公网NAT网关通过自定义SNAT、文档版本:...

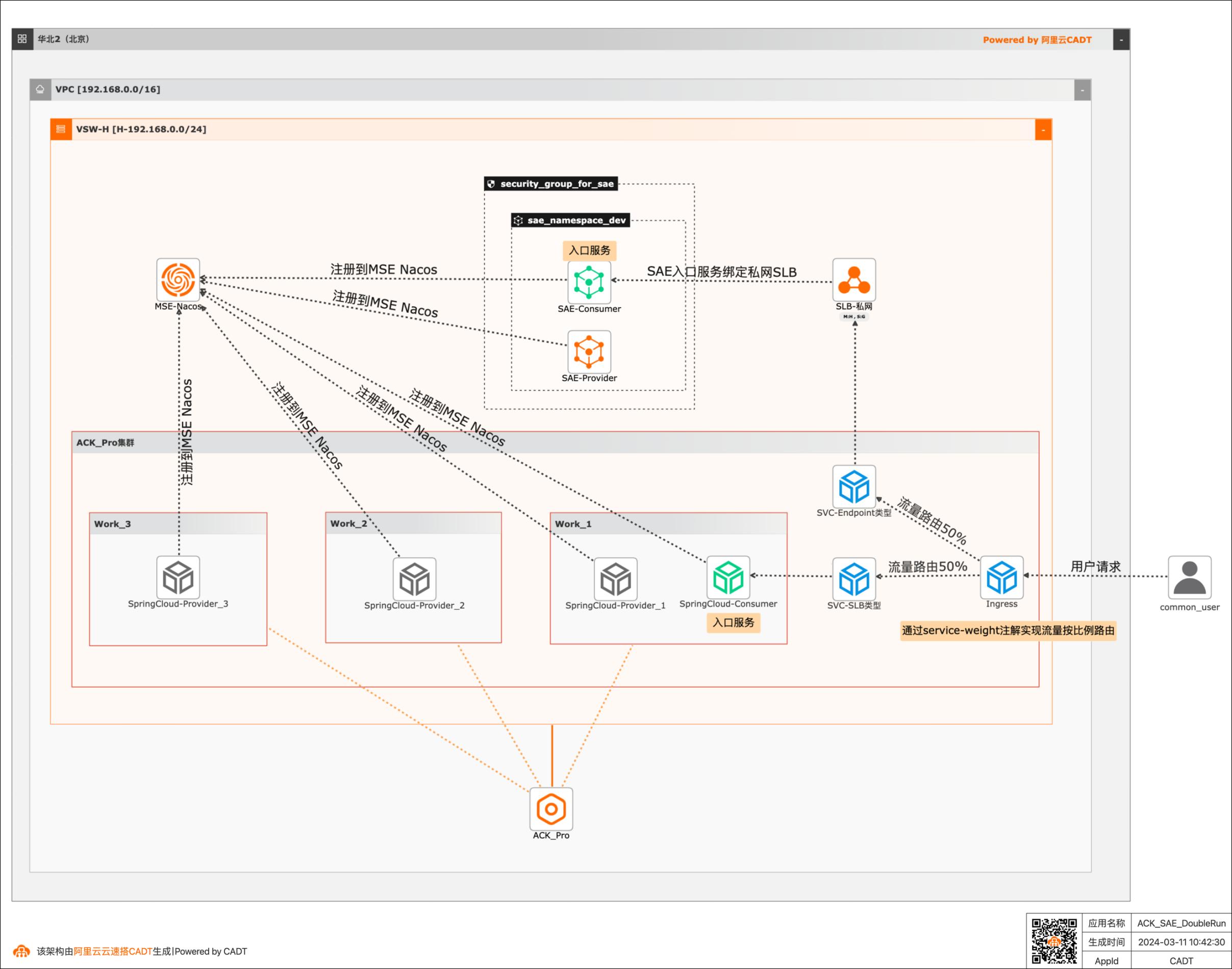

SAE-ACK应用双跑最佳实践

场景描述 实现ACK、SAE中部署的应用在东西向和南北向互通,实现SAE-ACK应用双跑。 应用场景 该最佳实践应用于两类场景: l 因为SAE支持更丰富自动扩缩指标(比如QPS,RT,TCP连接数等),所以将相对稳态的应用部署在ACK中,将相对弹性波动大的应用部署在SAE,借助SAE更强大的自动扩缩应对流量洪峰。 l 将K8s架构迁移到Serverless架构时,需要平滑过渡,所以该最佳实践中的双跑架构可以有效帮用户平滑的完成迁移。

网络架构: 整个方案会在某个Region下,该示例使用的是北京Region 在Region下会创建一个VPC 在该VPC下会创建一个某可用区的交换机,该示例使用的H可用区 在该VPC下会创建一个安全组,该安全组会给SAE使用。ACK会自己创建一个 独立的安全组(在架构图中没有显式的显示)。 SAE、MSE、ACK的Worker节点(ECS)...

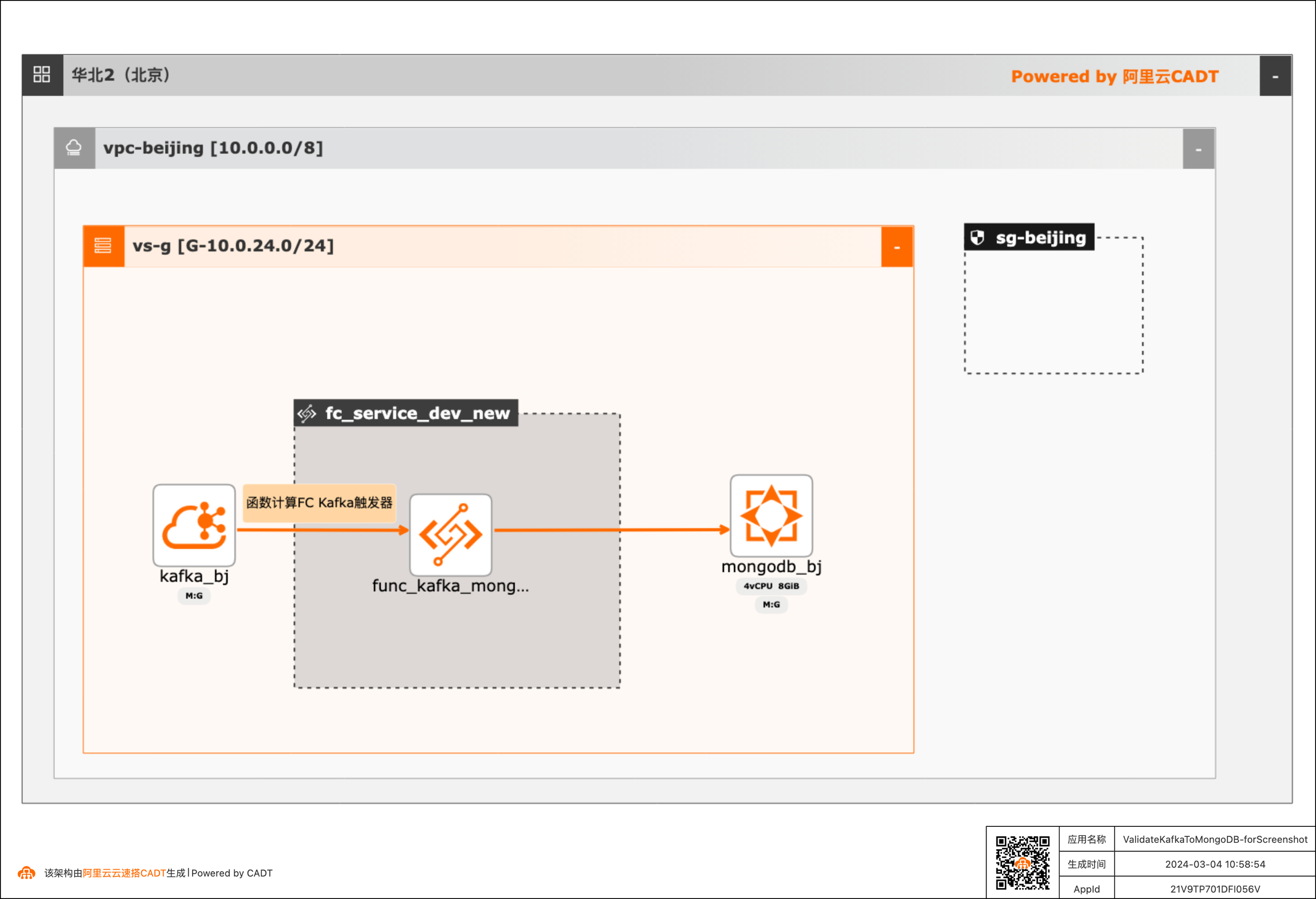

基于函数计算FC实现阿里云Kafka消息内容控制MongoDB DML操作

在大数据ETL场景,将Kafka中的消息流转到其他下游服务是很常见的场景,除了常规的消息流转外,很多场景还需要基于消息体内容做判断,然后决定下游服务做何种操作。 该方案实现了通过Kafka中消息Key的内容来判断应该对MongoDB做增、删、改的哪种DML操作。 当Kafka收到消息后,会自动触发函数计算中的函数,接收到消息,对消息内容做判断,然后再操作MongoDB。用户可以对提供的默认函数代码做修改,来满足更复杂的逻辑。 整体方案通过CADT可以一键拉起依赖的产品,并完成了大多数的配置,用户只需要到函数计算和MongoDB控制台做少量配置即可。

l 网络架构:n 整个方案会在某个 Region 下,该示例使用的是北京 Region n 在 Region 下会创建一个 VPC u 在该 VPC 下会创建一个某可用区的交换机,该示例使用的是 G 可用区 u 在该 VPC 下会创建一个安全组 n Kafka,FC,MongoDB 都在该 VPC 的 G 可用区的交换机下 n FC 在与 VPC 其他资源互通时会使用到 VPC 下的安全组 ...

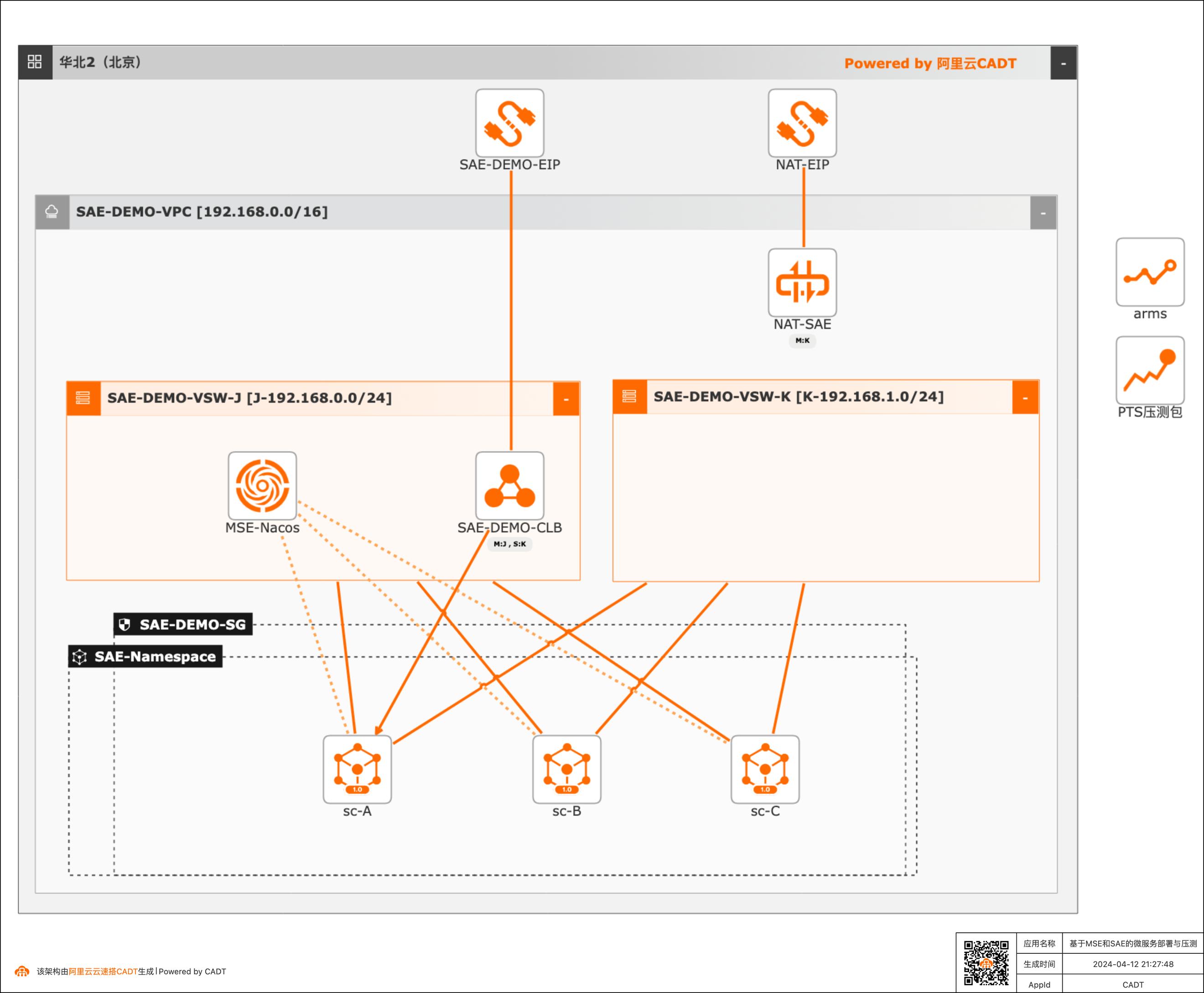

基于MSE和SAE的微服务部署与压测

通过云原生微服务引擎MSE、SAE、PTS、ARMS产品,为spring cloud微服务应用提供部署和测试能力,提供一个经典微服务应用上云的典型架构,实现微服务应用的快速落地。

SAE-DEMO-CLB 付费模式 按量付费 实例计费方式 按使用量计费 实例计费方式 按 高可用部署 SAE-DEMO-CLB 主可用区 北京可用区J 高可用部署 备可用区 北京可用区K 实例类型 私网 计费类型 按使用流量计费 IP版本 ipv4 实例删除保护 关闭 文档版本:20240415 3基于MSE和SAE的微服务部署与压测 部署基础环境 资源组 ...

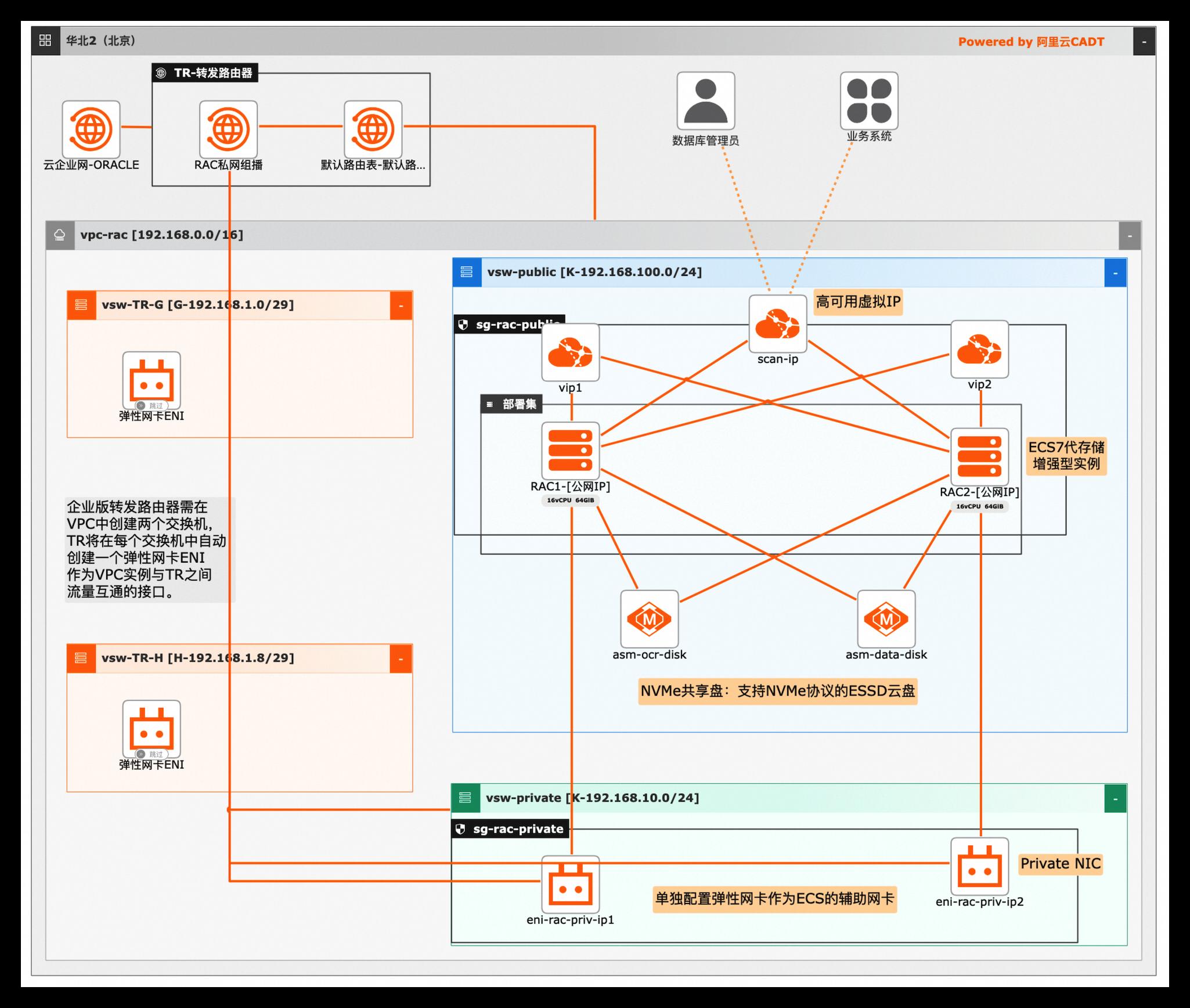

Oracle RAC 12C云上部署

Oracle RAC架构迁移上云,提供高并发,高吞吐,高安全等特性,适用于金融,电力,电信,制造业等传统客户的核心交易系统。

云企业网CEN:云企业网(CloudEnterpriseNetwork,简称CEN)是阿里云提 供的一款能够快速构建混合云和分布式业务系统的全球网络服务,为用户提供优 质、高效、稳定的网络传输环境,帮助用户打造一张具有企业级规模和通信能力 的云上网络。适用于集团企业、全球网络等场景。 转发路由器TR(TransitRouter):提供连接...

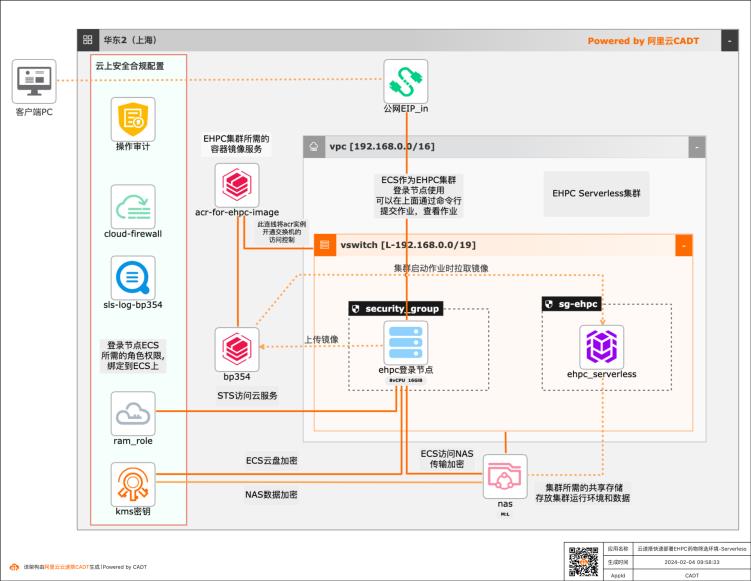

基于云速搭CADT快速构建药物筛选批量计算环境-serverless版

本方案基于云速搭 CADT提供一个快速构建云上Serverless版HPC批量计算环境的模板,针对生物制药领域的药物筛选场景,提供开箱即用的整套解决方案工具包,整个云上环境仅需1个小时即可完成自动化部署搭建。

a)vpc/vswitch:专有网络和交换机,网段建议不要和存量 IT基础设施中的网 络段重合。建议结合ehpc serverless集群将来的作业并发规模来合理规划网 段。比如说,作业并发运行时需要启动 1000个节点,那么交换机的网段地址 至少需要能提供 1000个 IP地址,可以设置网段为 192.168.0.0/22。b)ehpc_serverless:serverless 版本的...

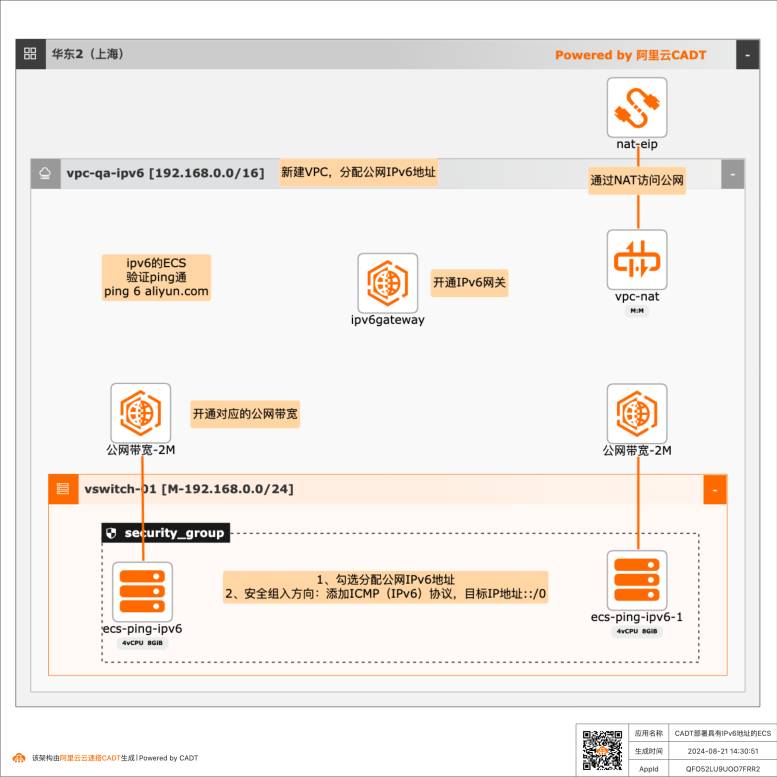

通过云速搭创建具有IPv6地址的ECS

随着国家推进 IPv6 规模部署行动计划的贯彻落实,以及工业互联网、物联网、5G 等前沿技术的快速发展,各行业用户 IPv6 改造诉求愈发强烈。 阿里云 IPv6 在互联网、金融、政企、传媒等各行业,提供了丰富的产品选择和可靠安全的服务体验。本文针对希望部署具有IPv6地址的ECS场景,提供一键部署模版,进行部署和效果验证。 应用场景 l 针对具备IPv6地址的ECS提供可视化架构 l 支持方案的批量部署和效果验证

弹性公网 IP:弹性公网 IP是独立的公网 IP资源,可与阿里云专有网络 VPC类型的云服 务器ECS、NAT网关、ENI网卡、私网负载均衡 SLB绑定,并可以动态解绑满足灵活管理的要 求。弹性公网 IP可为您在云上部署的网站提供 Internet访问服务。NAT网关:阿里云 NAT网关提供公网 NAT和私网 NAT两种功能。公网 NAT网关通过自定义 SNAT...

智能商业分析 Quick BI

瓴羊智能商业分析 Quick BI 是阿里云用户臻选的数据可视化工具,大幅提升数据分析和报表开发效率,一站式满足企业各种场景的数据分析和决策的诉求。

Q:能让企业用起来的,才是真正的智能 BI2024.04.29开发参考如何使用Ticket报表和票据管理增强嵌入方案的安全性2024.04.23开发参考如何基于已有的仪表板、数据大屏、电子表格和数据填报,创建自定义模板2024.06.19功能场景配置全局参数实现不同用户订阅不同数据2023.08.02产品简介Quick BI是一款全场景数据消费式的BI平台,...

来自:

云产品

Alibaba Cloud Linux

Alibaba Cloud Linux 是阿里云打造的 Linux 服务器操作系统发行版。为云上应用程序提供 Linux 社区的增强功能,同时通过引入更完善的发行版质量体系,确保产品品质,提供云上最佳用户体验。

21分钟查看教程更多免费试用场景技术解决方案等保合规镜像弹性扩容方案神龙裸金属容器优化方案等保合规镜像提供等保2.0三级版的安全合规镜像满足等保 2.0 要求基于 ECS+Alibaba Cloud Linux 等保合规镜像的实例,满足国家网络安全等级保护制度 2.0 规定的要求。快速批量实现可快速实现批量机器上的操作系统等保合规。相关...

来自:

云产品

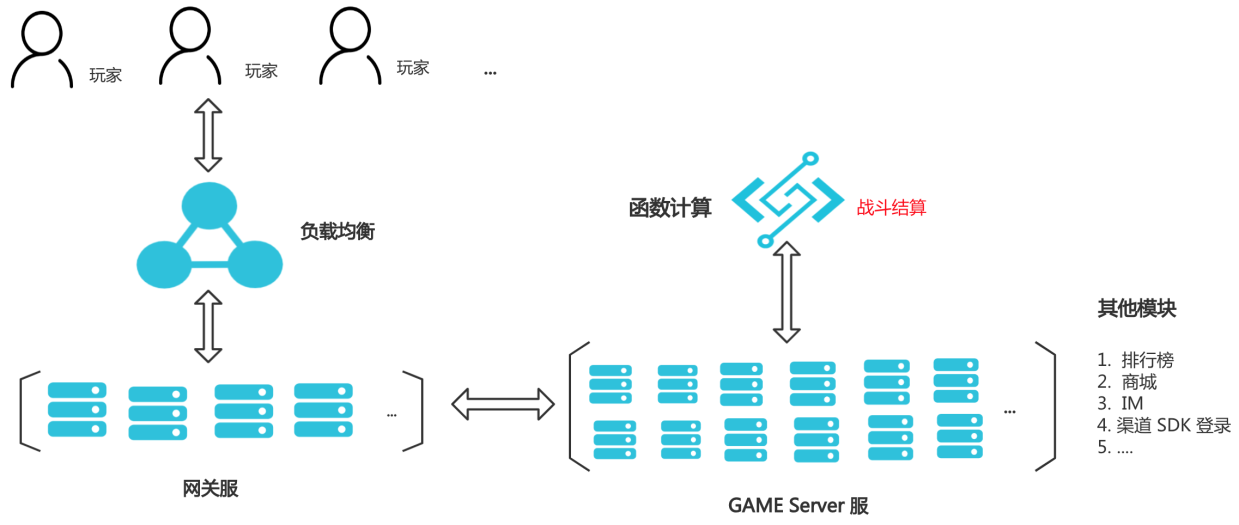

基于ECI+FaaS构建游戏战斗结算服

在游戏行业的很多SLG游戏作品中,为了防止客户端作弊,在每局战斗之后,在客户端预判玩家胜利的情况下,需要服务端来进行战斗数据的结算,从而确定玩家是不是真正的胜利。战斗结算是强CPU密集型,结算系统每日需要大量的计算力,尤其是开服或者活动期间忽然涌入的大量玩家,导致需要的计算量瞬间几倍增长,同时需要结算系统保持稳定的延时来保证玩家的用户体验。 1. ECI支持500台实例30S弹出,快速解决业务模块扩容压力。FaaS毫秒级伸缩扩容,化解算力瓶颈,平滑解决暴增调用请求。 2. 降低成本:ECI每天弹性运行8小时,与6代同规格包月相比节省成本40%+,FaaS按需付费,即开即用,节省预留资源消耗。 3. 免运维:FaaS和ECI都是全托管免运维的服务,客户专注业务开发即可。 4. 模块公共化:减轻游戏逻辑服的压力,结算需求复用到类似需求的游戏。

节点 IP数量 如果您选择的网络模式为 Flannel,您需设置节点 IP 数量。说明:节点 IP数量是指可分配给一个节点的 IP数量,建议保 持默认值。文档版本:20201127 24 基于ECI+FaaS构建游戏战斗结算服 游戏架构搭建篇 文档版本:20201127 25 基于ECI+FaaS构建游戏战斗结算服 游戏架构搭建篇 步骤5 Worker配置。配置项 说明 ...

容器计算服务 ACS

容器计算服务 ACS 是以 K8s 为使用界面供给容器算力资源的云计算服务,提供符合容器规范的算力资源。

灵活调配,了解 ACS 如何管理计算资源安全合规基础设施安全数据安全:默认加密容器计算服务 ACS 管控侧用户数据,保证客户数据在容器计算服务 ACS 管控侧传输全链路 TLS 加密,同时提供完备的审计和控制面组件日志投递能力。供应链安全安全左移:提供镜像构建、安全扫描、全球同步和部署的自动化集成应用交付链能力,帮助...

来自:

云产品

- 产品推荐

- 这些文档可能帮助您