系统运维管理 OOS

阿里云系统运维管理(简称OOS)提供的云上自动化运维服务,通过执行模板来完成任务的自动化运行,可以使用OOS管理ECS、RDS、SLB、VPC等云产品,提升日常运维管理效率

标签可按照OSType、AppVersion、Env等不同用途进行分类批量操作的风险控制通过运维编排分批执行云助手命令,验证内容符合预期后再进行后续批次相关产品系统运维管理OOS本产品云服务器ECS云助手在线咨询管理抢占式实例抢占式实例适用于无状态的应用场景,比如可弹性伸缩的Web站点服务、图像渲染、大数据分析和大规模并行计算...

来自:

云产品

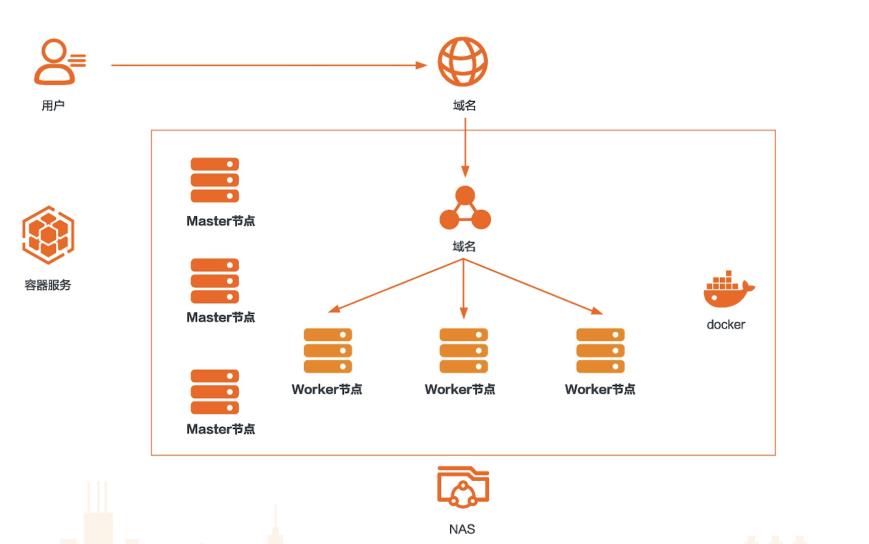

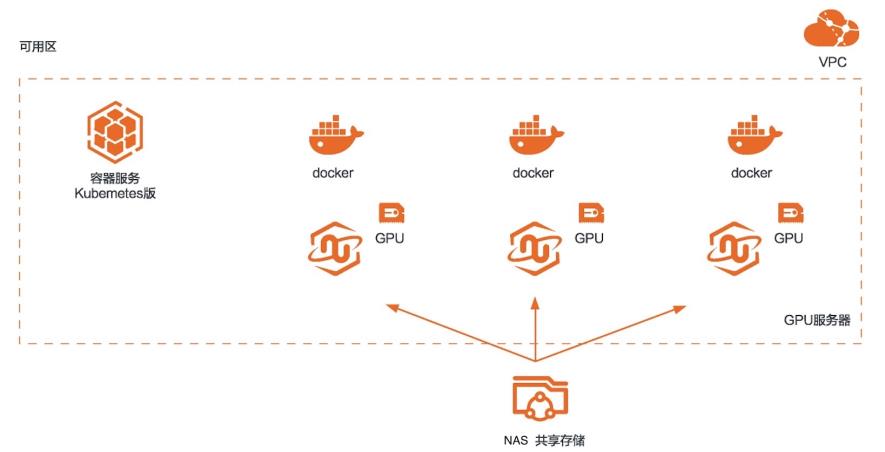

基于弹性计算的AI推理

场景描述 本方案适用于使用GPU进行AI在线推理的场 景。在推理之前,模型已经训练完成。例如,刷脸 支付中,我们在刷脸的时候,就是推理的一个过 程。再比如图像分类,目标检测,语音识别,语 义分析等返回结果的过程。 解决问题 使用GPU云服务器搭建推理环境 使用容器服务Kubernetes版构建推理 环境 使用NAS存储模型数据 使用飞天AI加速推理工具加速推理 产品列表 GPU云服务器 容器服务Kubernetes版 NAS共享存储

Kubernetes支持通过 CRD的方式定义不同类型的工作负载,用于分布式的应用生命 周期管理,例如,在深度学习领域,支持 MPI、ParameterServer等模式;在深度学 习解决方案中,支持 MPI、Tensorflow Parameter Server等模式。要在 Kubernetes上 运行他们,您需要在集群中部署 tj-job、mpi-operator、tf-job-dashboard等基础...

移动测试

阿里云移动测试(Mobile Testing)是为广大企业客户和移动开发者提供真机测试服务的云平台,拥有大量热门机型,提供7x24全天候App测试服务,帮助客户发现APP中的各类隐患(应用崩溃、各类兼容性问题、功能性问题、性能问题等),减少用户流失,提高APP质量和市场竞争力。

精准的图像识别,提高游戏测试效率.具备机器学习的AppRipper能够智能测试应用,模拟真人操作,支持性能基线对比,快速检测出崩溃、未响应等问题,并提供通用解决方案.不断提高对被测App的理解,提高测试效率和效果.提供通用的问题解决方案,帮助快速定位问题、解决问题.问题解决方案.以应用历史性能数据为基线,对比被测...

来自:

云产品

智能视觉

智能视觉是一款面向线上图片和视频计算场景的AI计算产品。智能视觉(IntelligenceVision)为零算法基础的开发者和企业提供AI视觉计算能力,包括图像分类、物体检测、事件检测、视频检测、视频识别等能力,可以应用于家庭监控、明厨亮灶、智慧工地等各种场景,通过API支撑开发各类业务应用。

可以在明厨亮灶应用中增加对厨房视频画面中出现的未戴口罩、抽烟、玩手机、垃圾桶未盖等违规行为进行自动识别的功能,达到自动告警的目的.检测画面中的后厨员工是否存在未戴工作帽的情况,如果有则输出告警事件.检测后厨员工是否存在未戴口罩的情况,如果有则输出告警事件.检测后厨员工是否存在未戴手套的情况,如果有则...

来自:

云产品

人工智能平台 PAI

阿里云人工智能平台 PAI 涵盖交互式建模、可视化建模、分布式训练到模型在线部署全流程;快速搭建人工智能推荐系统;深度学习模型训练速度提升数十倍;减少50%GPU成本

同时支持自定义构建文本打标模型,识别不同类型的文本标签,服务于推荐等其他业务应用.通用文本打标.支持不同量级的模型结构,视频帧输入和文+视频的多模态输入形式,单标签和多标签的输出形式。根据不同的需求快速自定义构建各种类型的视频打标模型,快速从视频数据中识别各种类型的视频标签,服务于下游推荐或其他应用...

来自:

云产品

RAPIDS加速图像搜索

场景描述 本方案适用于使用RAPIDS加速平台 +GPU云服务器来对图像搜索任务进行加 速的场景。相比CPU,利用GPU+ RAPIDS在图像搜索场景下可以取得非常 明显的加速效果。 解决问题 1.搭建RAPIDS加速图像搜索环境 2.使用容器服务Kubernetes版部署图 像搜索环境 3.使用NAS存储计算数据 产品列表 容器服务Kubernetes版 GPU云服务器 文件存储NAS

图像识别和搜索,图像搜索任务可以实现以图搜 图,在不同行业应用和业务场景中帮助您搜索相同或相似的图片。图像搜索任务背 后的两项主要技术是特征提取及向量化、向量索引和检索。27 RAPIDS加速图像搜索 单机部署图搜应用 本文案例中,使用开源框架 TensorFlow和 Keras配置生产环境,然后使用 ResNet50卷积神经网络完成...

GPU云服务器

阿里云GPU云服务器(GPU Cloud Computing,GPU)是提供 GPU 算力的弹性计算服务,具有超强的计算能力,服务于深度学习、科学计算、图形可视化、视频处理多种应用场景。阿里云作为亚洲第一的云服务提供商,随时为您提供触手可得的算力,有效缓解计算压力,提升您的业务效率,助您提高企业竞争力。

图像领域作为深度学习应用最为成熟的领域,在阿里云强大的GPU算力助力下能够更准确识别图片,提升准确率,也提高运行效率.最新GPU针对AI、数据分析在各种规模上实现出色的加速,应对极其严峻的计算挑战。同时阿里云提供多种GPU实例规格,提供不同算力和场景需求的灵活性.强大的训练能力.提供业界领先的推理能力,最新GPU...

来自:

云产品

- 产品推荐

- 这些文档可能帮助您