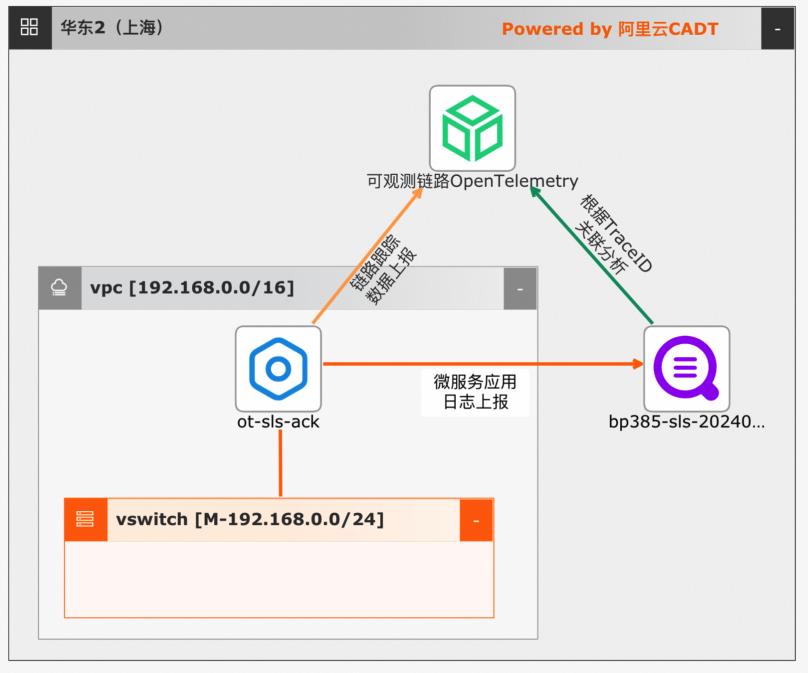

可观测链路 OpenTelemetry版结合日志服务SLS关联分析最佳实践

可观测链路 OpenTelemetry 版为分布式应用的开发者提供了完整的调用链路还原、调用请求量统计、链路拓扑、应用依赖分析等工具,可以帮助开发者快速分析和诊断分布式应用架构下的性能瓶颈,当应用出现业务异常问题时,您可以在可观测链路 OpenTelemetry 版控制台关联查看日志进行分析,精准定位业务异常。

可观测链路 OpenTelemetry 版结合日志服务 SLS关联分析 最佳实践 场景描述 业务架构 可观测链路 OpenTelemetry 版为分布式应用的 开发者提供了完整的调用链路还原、调用请求量 统计、链路拓扑、应用依赖分析等工具,可以帮 助开发者快速分析和诊断分布式应用架构下的 性能瓶颈,当应用出现业务异常问题时,您可以 在可观测...

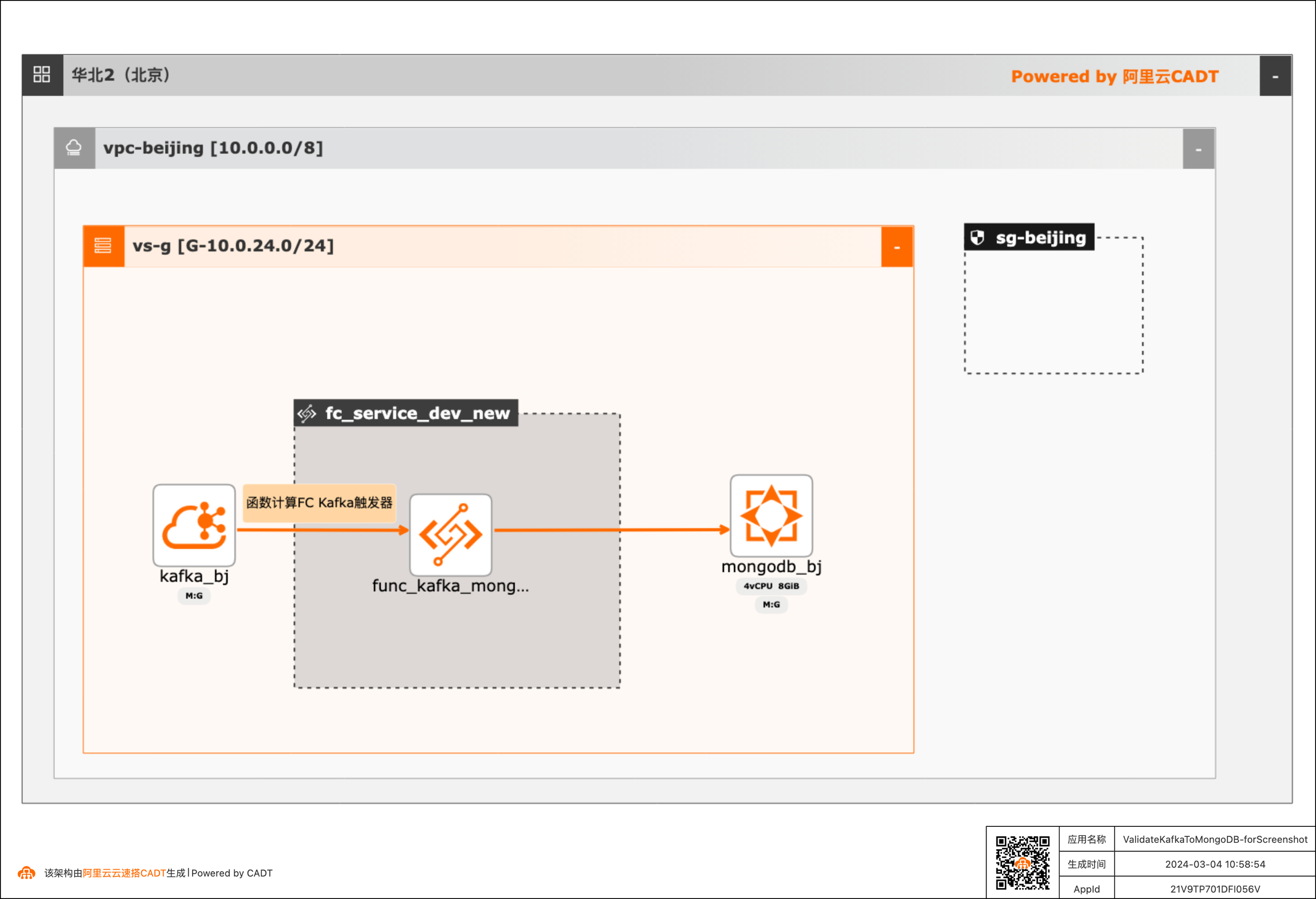

基于函数计算FC实现阿里云Kafka消息内容控制MongoDB DML操作

在大数据ETL场景,将Kafka中的消息流转到其他下游服务是很常见的场景,除了常规的消息流转外,很多场景还需要基于消息体内容做判断,然后决定下游服务做何种操作。 该方案实现了通过Kafka中消息Key的内容来判断应该对MongoDB做增、删、改的哪种DML操作。 当Kafka收到消息后,会自动触发函数计算中的函数,接收到消息,对消息内容做判断,然后再操作MongoDB。用户可以对提供的默认函数代码做修改,来满足更复杂的逻辑。 整体方案通过CADT可以一键拉起依赖的产品,并完成了大多数的配置,用户只需要到函数计算和MongoDB控制台做少量配置即可。

l 数据库版本:MongoDB 7.0(也可以根据实际需求选择其他版本)l 节点数:三节点。(除此外还提供 5 节点,7 节点)l 只读节点:无只读节点。l 存储引擎:WiredTriger l 存储类型:ESSD PL1 云盘(除此以外,还提供 PL2,PL3,AutoPL 的类型)l 加密类型:不加密 l 规格类别:独享规格 l 规格:4 核 8GB(独享型)(可以...

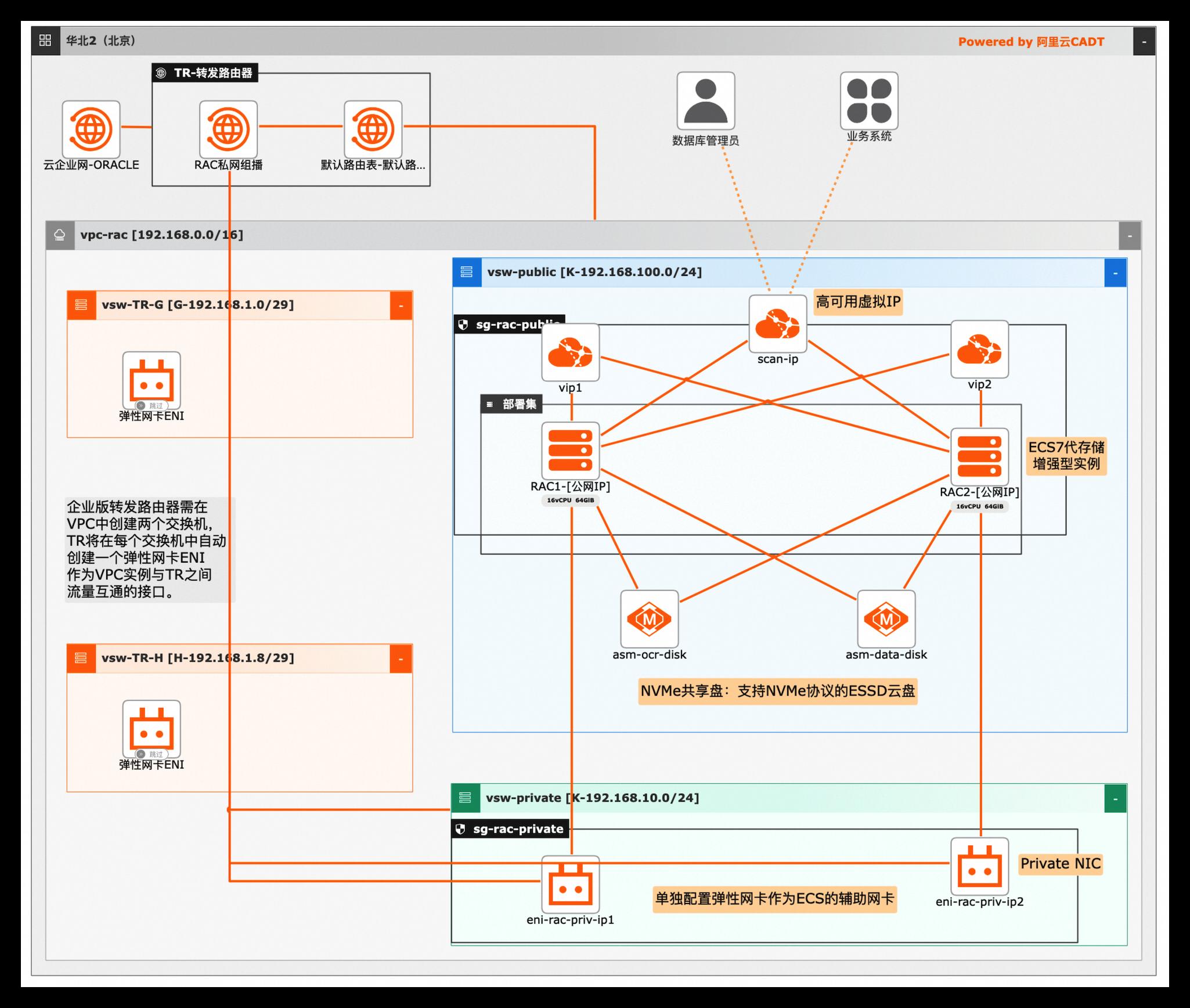

Oracle RAC 12C云上部署

Oracle RAC架构迁移上云,提供高并发,高吞吐,高安全等特性,适用于金融,电力,电信,制造业等传统客户的核心交易系统。

基于ESSD存储NVMe协议提供的多实 例共享能力的双机集群OracleRAC架 构,为用户提供统一数据服务的同时提 供故障切换与恢复能力(FailOver集群 功能),避免单点故障,减少停机时间,确保系统全年7*24小时稳定运行。2.在集群环境运行中的所有实例通过共享 的数据库运行事物,RAC架构相对上层 应用架构完全透明,整体数据负载...

云数据库 RDS MySQL 版

阿里云云数据库RDS MySQL是一种稳定可靠、可弹性伸缩的在线MySQL数据库服务, 提供了高可用、高可靠、高安全、易运维等一站式的数据库解决方案,帮助您免除MySQL运维的烦恼。

产品解决方案文档与社区权益中心定价云市场合作伙伴支持与服务了解阿里云备案控制台云数据库 RDS MySQL 版产品简介产品优势产品功能产品选型入门与试用技术解决方案产品定价安全合规客户案例常见问题社区云数据库 RDS MySQL 版稳定可靠、可弹性伸缩的在线 MySQL 数据库服务,帮助您免除 MySQL 运维的烦恼。立即购买免费试用...

来自:

云产品

云原生数据库

PolarDB是阿里云自研的云原生数据库,在存储计算分离架构下,利用了软硬件结合的优势,为用户提供秒级弹性、高性能、海量存储、安全可靠的数据库服务。100%兼容MySQL和PostgreSQL生态,支持分布式扩展,高度兼容Oracle语法。

企业版是基于RDMA网络互联计算和PolarStore存储的数据库集群类型,通过软件和硬件结合的技术支持更加丰富的Super MySQL能力,如全局一致性、三层解耦、Smart-SSD等,丰富的产品系列和功能全面覆盖多种场景需求.标准版是PolarDB全新推出的数据库集群类型,采用阿里云全新一代高性能低成本的ECS基础设施,用户使用较低的成本...

来自:

云产品

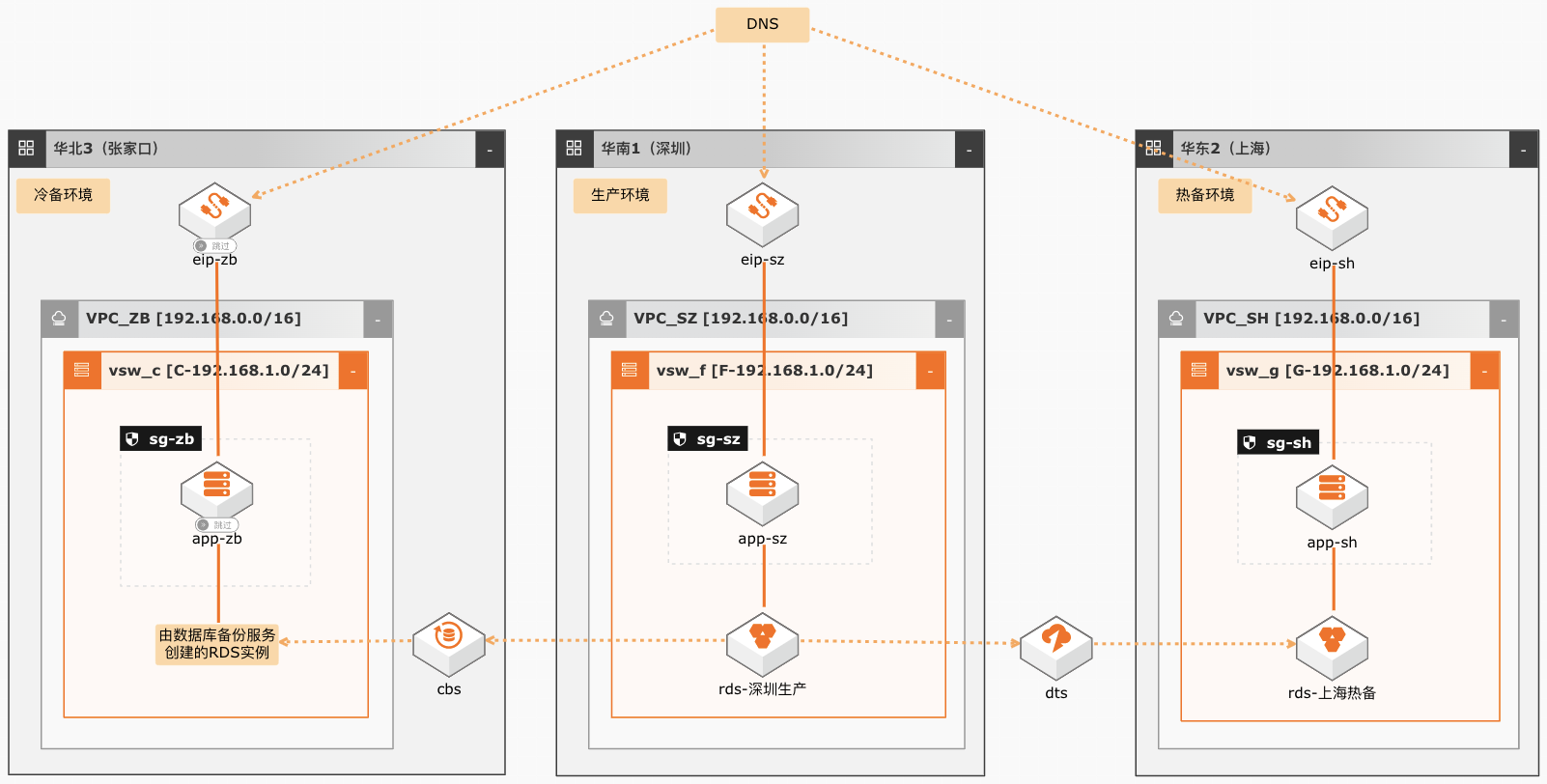

数据库异地灾备

场景描述 适用于不满足于单地域,对数据可靠性 (RPO)和服务可用性(RTO)要求更高 的,希望防范断电、断网等机房故障,抵 御地震、台风等自然灾害,具备异地容灾 备份恢复能力的客户业务场景。 解决问题 1.实时备份,RPO达到秒级 2.表级恢复,故障恢复时间大大缩短 3.长期归档,自动管理备份生命周期 4.异地灾备,构建数据库灾备中心 产品列表 专有网络VPC 云服务器ECS 弹性公网IP(EIP) 负载均衡SLB 云数据库RDSMySQL 数据库备份服务DBS 对象存储服务OSS 数据湖分析服务DLA 数据管理服务DMS 数据传输服务DTS

步骤7 完成数据库恢复配置之后,预检查将会检查所有前面的配置选项、数据库连通性、数 据库权限等内容。预检查完成后,单击立即启动。步骤8 在恢复任务列表,可以看到该恢复任务状态从初始化中,运行中,变到完成,单击管 理,可查看恢复任务详情。文档版本:20220207 84 数据库异地灾备 容灾演练 步骤9 恢复完成后,点击 ...

云数据库MongoDB版

阿里云云数据库MongoDB版是完全兼容MongoDB协议、高度兼容DynamoDB协议的在线文档型数据库服务。支持单节点、双节点、副本集和分片集群四种部署架构,能够满足不同的业务场景需要。

专业的DMS数据管理平台,提供可视化的MongoDB数据管理,图形化轻松管理数据库(Database)、集合(Collection)、文档(Document)等对象,全面提升研发、运维效率.数据库内核版本管理.主动升级,快速修复缺陷,免去日常版本管理苦恼;优化数据库MongoDB参数配置,最大化利用系统资源.可视化管理及运维平台,简单易用,系统...

来自:

云产品

云原生内存数据库Tair

云原生内存数据库Tair是阿里云推出的,基于云原生架构的内存数据库,兼容Redis API,支持内存、持久内存、ESSD三种存储介质,并提供大量扩展型数据结构及企业级能力。

据测算,相比原有数据库产品,Tair帮助行情业务系统的数据库成本降低50%以上.Tair内存型的高性能以及 TairRoaring 模块支持的 RoaringBitmap 数据结构,成功支持了神策数据的精准营销场景。TairRoaring 将用户数据体积降低至原始数据体积的1/7,访问延时降低至亚毫秒级,吞吐达到每秒百万次请求.十荟团采用云数据库Tair内存...

来自:

云产品

云原生数据库PolarDB MySQL版

PolarDB MySQL版是自研的云原生关系型数据库,100%兼容MySQL。多主多写、多活容灾、HTAP、交易和分析性能最高分别是开源数据库的6倍和400倍,TCO低于自建数据库50%。

采用存储和计算分离架构,使得数据库服务器的CPU、内存能够快速扩容,只需数分钟即可完成集群配置升降级.利用底层分布式存储的快照技术,只需分钟级即可完成对上TB数据量大小的数据库的备份,且整个备份过程不需要加锁,效率高,影响小.云原生数据库 PolarDB.云数据库HBase.云原生数据仓库ADB版.数据传输DTS.推荐搭配产品....

来自:

云产品

云数据库RDS SQL Server版

阿里云SQL Server数据库已含微软License,支持复杂的SQL查询,性能优秀,对基于Windows平台.NET架构的应用程序具有完美的支持,广泛应用于新零售、医疗、房地产等行业。

云数据库SQL Server版已通过ISO 20000、SOC、PCI-DSS、等保三级等十项安全合规认证.3层安全防护,十项安全合规认证.系统资源监控.提供CPU利用率、IOPS、连接数、磁盘空间等实例信息实时监控及报警,随时随地了解实例动态.智能优化方案支持.自动化的智能巡检诊断,支持定制化监控项关注,提供专业的SQL语句优化意见及实例...

来自:

云产品

智能商业分析 Quick BI

瓴羊智能商业分析 Quick BI 是阿里云用户臻选的数据可视化工具,大幅提升数据分析和报表开发效率,一站式满足企业各种场景的数据分析和决策的诉求。

可按需增购数据应用企业门户不支持支持支持订阅推送(邮件)不支持支持支持自助取数不支持(普通导出支持最高1万行)不支持(普通导出支持最高1万行)支持(大数据量导出支持最高100万行)监控告警不支持不支持支持数据源云数据库支持支持支持自建数据库支持支持支持上传本地文件支持支持支持表单填报(原数据填报)不支持...

来自:

云产品

云数据库OceanBase

云数据库 OceanBase 版是构建在阿里云基础设施上的公有云数据库服务,基于完全自主研发的原生分布式数据库。通过多租户、高压缩存储、多级弹性伸缩、HTAP等能力,在保障数据库高性能的同时,显著降低数据库成本。同时在云上集成了评估、迁移、监控、诊断、备份恢复、运维优化等工具,让数据库管理与运维更简单。

一般在分布式系统或者分库分表架构中,由于架构的复杂度通常放弃了全局索引、全局一致性等,用户需要付出额外的成本来关注这些问题,为了更好的解决这些问题,OceanBase 通过持续可用的全局时间戳,在全局范围内实现了“快照隔离级别”和“多版本并发控制”的能力,并在此基础上实现了全局索引,您可以像使用单机关系数据库...

来自:

云产品

- 产品推荐

- 这些文档可能帮助您