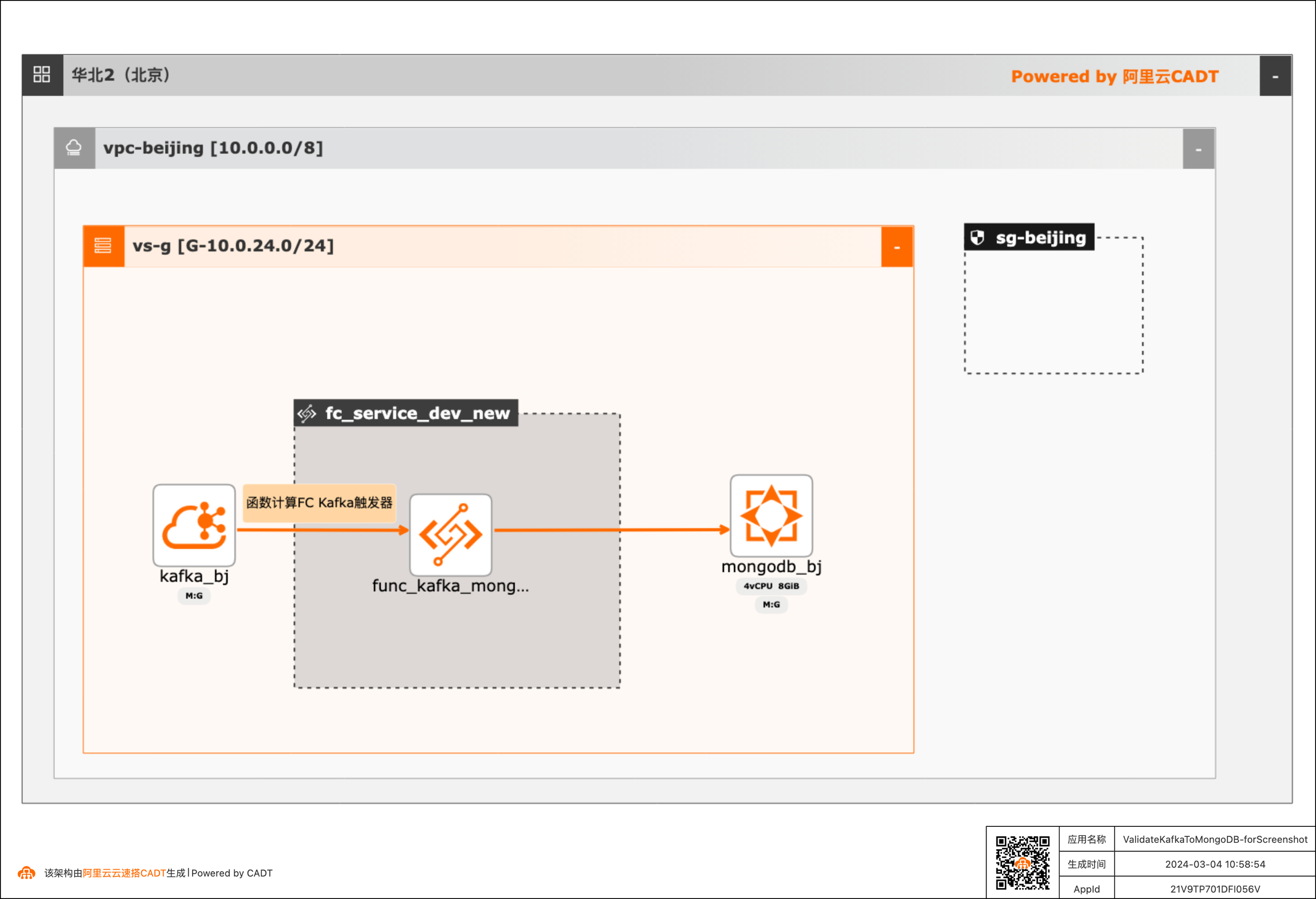

基于函数计算FC实现阿里云Kafka消息内容控制MongoDB DML操作

在大数据ETL场景,将Kafka中的消息流转到其他下游服务是很常见的场景,除了常规的消息流转外,很多场景还需要基于消息体内容做判断,然后决定下游服务做何种操作。 该方案实现了通过Kafka中消息Key的内容来判断应该对MongoDB做增、删、改的哪种DML操作。 当Kafka收到消息后,会自动触发函数计算中的函数,接收到消息,对消息内容做判断,然后再操作MongoDB。用户可以对提供的默认函数代码做修改,来满足更复杂的逻辑。 整体方案通过CADT可以一键拉起依赖的产品,并完成了大多数的配置,用户只需要到函数计算和MongoDB控制台做少量配置即可。

u 分区数:默认 12 个分区,通常建议分区数是 12 的倍数,减少数据倾斜风险。u 存储引擎:阿里云 Kafka 架构,有云存储和 Local 存储。(详细对比参见文档:https://help.aliyun.com/zh/apsaramq-for-kafka/cloud-message-queue-for- kafka/product-overview/comparison-between-storage-engines )u 消息类型:普通消息。...

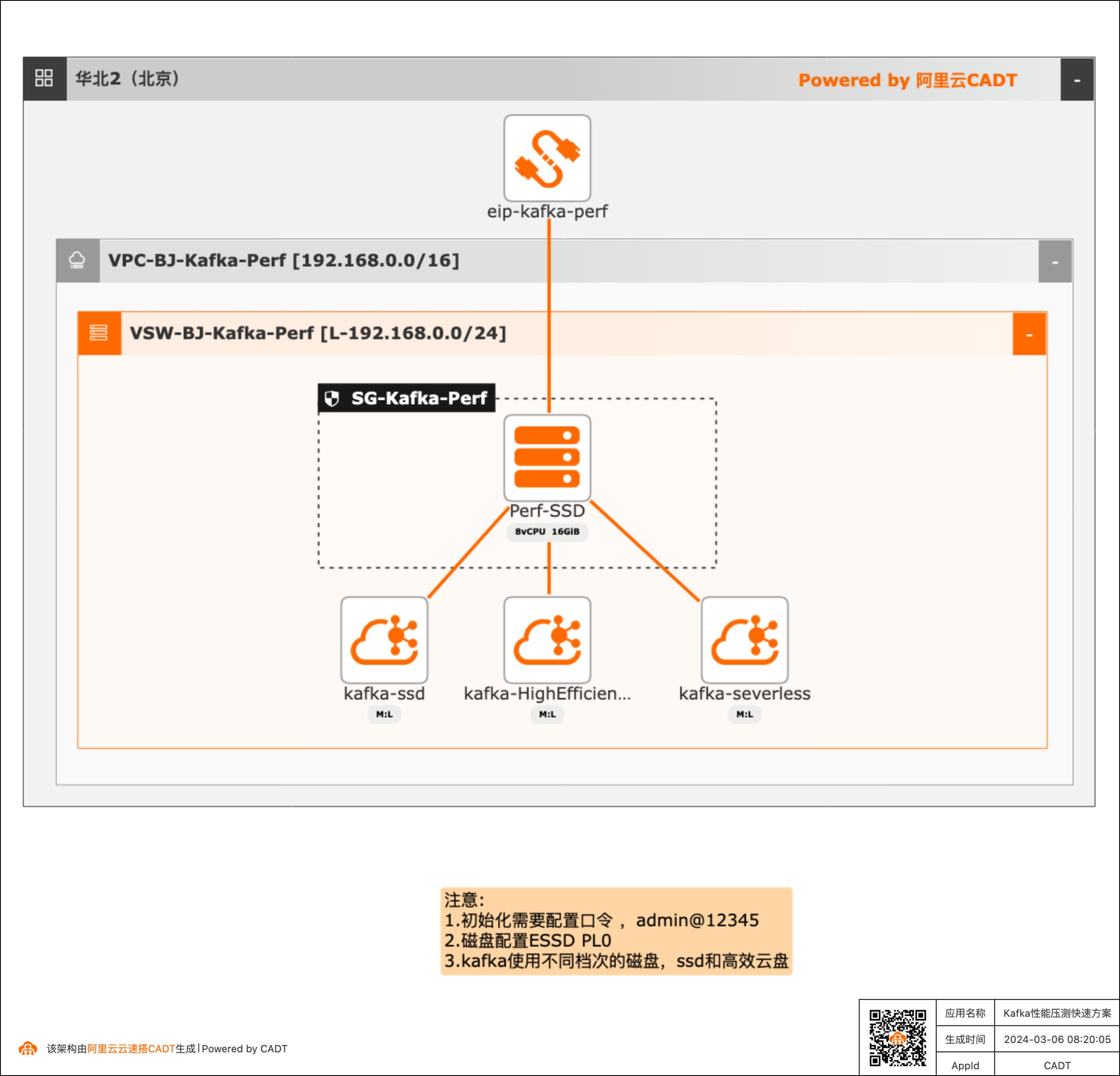

Kafka性能压测快速方案

产品性能基线测试场景需要对产品进行性能测试得到详细的压测数据,本方案可以快速构建测试的客户端(kafka官方的压测客户端)和不同的Kafka服务端( SSD云盘版、高效云盘、Serverless版三种实例),方便客户进行POC完成性能验证。

Kafka性能压测快速方案 最佳实践 业务架构 场景描述 产品性能基线测试场景需要对产品进行性能测 试得到详细的压测数据,本方案可以快速构建测 试的客户端(kafka官方的压测客户端)和不同 的Kafka服务端(SSD云盘版、高效云盘、Serverless版三种实例),方便客户进行POC完成 性能验证。应用场景 有需要通过PoC得到Kafka产品...

互联网电商行业离线大数据分析

电商网站销售数据通过大数据分析后将业务指标数据在大屏幕上展示,如销售指标、客户指标、销售排名、订单地区分布等。大屏上销售数据可视化动态展示,效果震撼,触控大屏支持用户自助查询数据,极大地增强数据的可读性。

执行后,等待运行状态如下图:步骤8 执行成功后,可查看到数据已经更新到最新了(具体数值根据实验购买的产品数量和 金额来观察数据的准确性)。步骤9 在DataV大屏展示页面,可以看到销售额和销售量数据已更新为最新统计的数据。3.6.自动更新离线数据大屏展示 手动测试通过后,我们可以在离线同步任务和ODPSSQL节点配置调度...

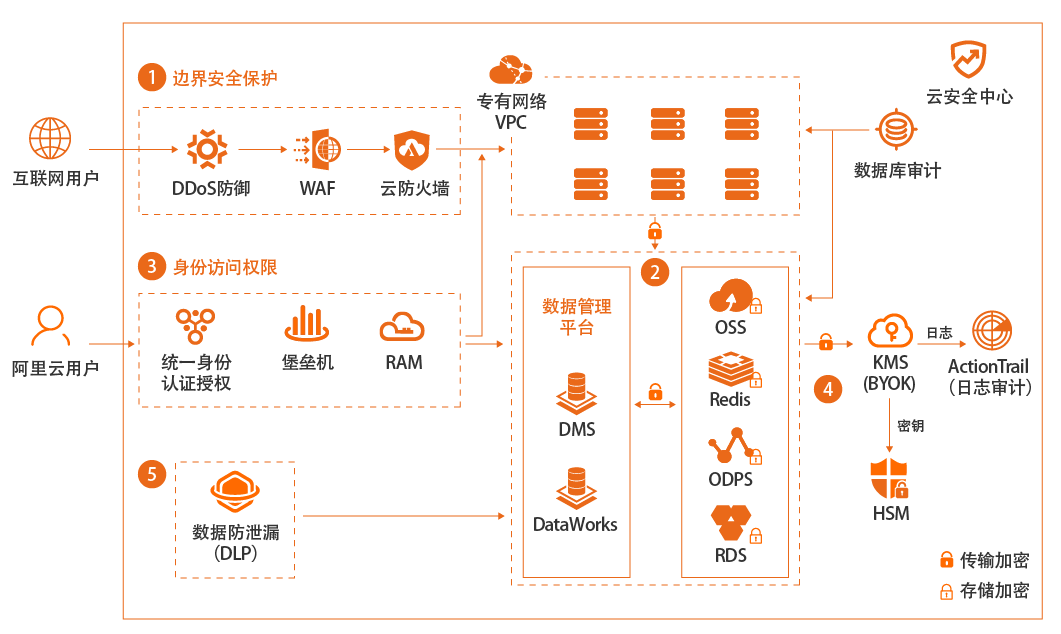

企业上云数据安全

场景描述 企业是否选择上公共云,或者哪些系统或数据上 公共云,对数据安全的关心是重要因素之一。本 最佳实践重点在于介绍狭义的数据加密存储安 全范畴,即首先使用SDDP产品进行敏感数据发 现和分级分类,然后对高级别敏感数据进行按 需、不同类型的全链路加密存储。 解决问题 1.帮助客户发现敏感数据 2.对敏感数据进行分类、分级 3.对不同级别的数据如何选择加密方式 4.具体如何进行加密 产品列表 敏感数据识别SDDP 密钥管理服务KMS 云数据库RDS 对象存储OSS

本最佳实践重点在于介绍狭义的数据加密 存储安全范畴,即首先使用 SDDP产品进行敏 感数据发现和分级分类,然后对高级别敏感数 据进行按需、不同类型的全链路加密存储。解决问题 1.帮助客户发现敏感数据 2.对敏感数据进行分类、分级 3.对不同级别的数据如何选择加密方式 4.具体如何进行加密 产品列表 敏感数据识别 SDDP 密钥...

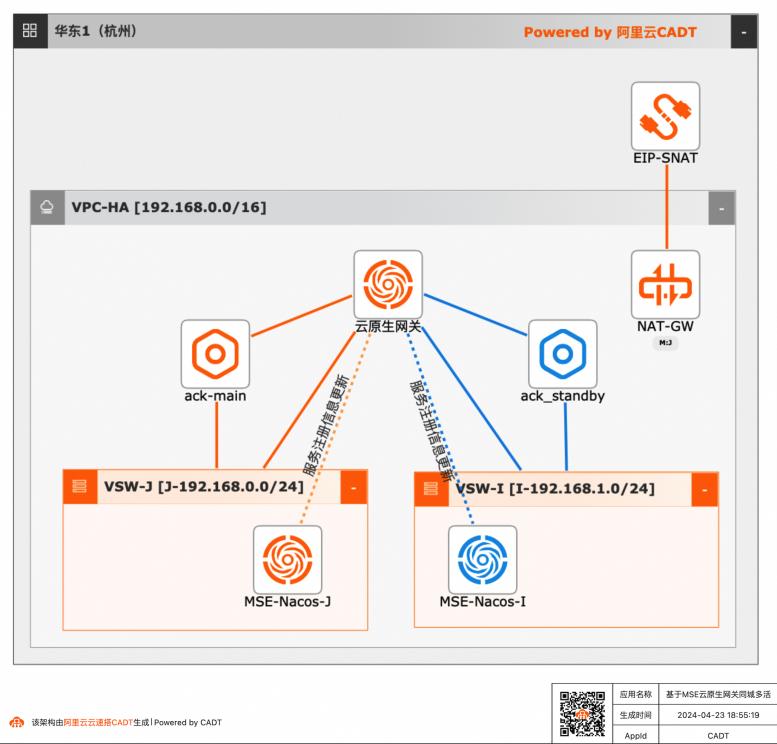

基于MSE云原生网关同城多活

借助云原生微服务MSE网关,MSE配置注册中心的同城容灾多活微服务应用。构建一个经典的微服务场景,实现同城容灾的步骤,体现云原生相关产品在用户上云,高可用同城容灾多活场景下的能力。

文档版本:20240423 40 基于MSE云原生网关同城多活最佳实践 场景验证 步骤4 等待压测任务生成 步骤5 查看压测数据 步骤6 通过在 ack-main中删除资源方式模拟机房故障,有损秒级切换,查看 PTS压测曲线 文档版本:20240423 41 基于MSE云原生网关同城多活最佳实践 场景验证 服务删除时,压测曲线会出现毛刺,请记录删除操作...

数据迁移上云

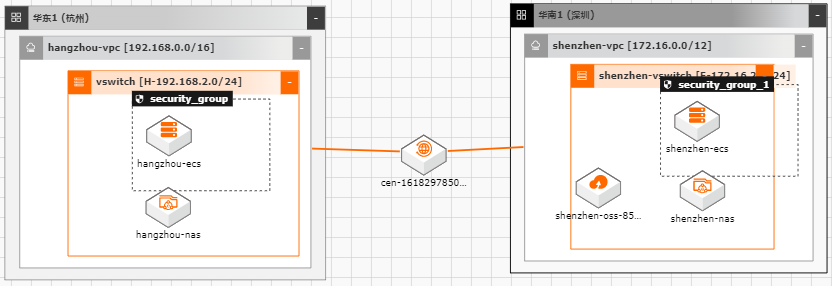

随着越来越多的企业选择将业务系统上云,各种类型的数据如何便捷、平滑的迁移上 云,成了用户上云较为关注的点;业务上云后,因为业务或者其他方面调整等因素, 也存在如跨区域,跨账号等数据迁移的场景。针对以上需求,阿里云上提供了较为丰 富的工具(如ossimport)、服务(在线迁移服务),旨在能够帮助客户便捷进行数据迁 移。 本文通过云架构设计工具CADT来快速创建云上基础资源,并以杭州区域来模拟线 下IDC(或友商),深圳区域模拟阿里云云上资源。通过云上的工具命令、服务来提 供常见数据迁移场景的最佳实践。

云企业网可帮助您在不同地域 VPC间,VPC与本地数据中心间搭建私网通信通道,通过自动路由分发及学习,提高网络 的快速收敛和跨网络通信的质量和安全性,实现全网资源的互通,帮助您打造一 文档版本:20201013 II 数据迁移上云最佳实践 前言 张 具 有 企 业 级 规 模 和 通 信 能 力 的 互 联 网 络。详见:...

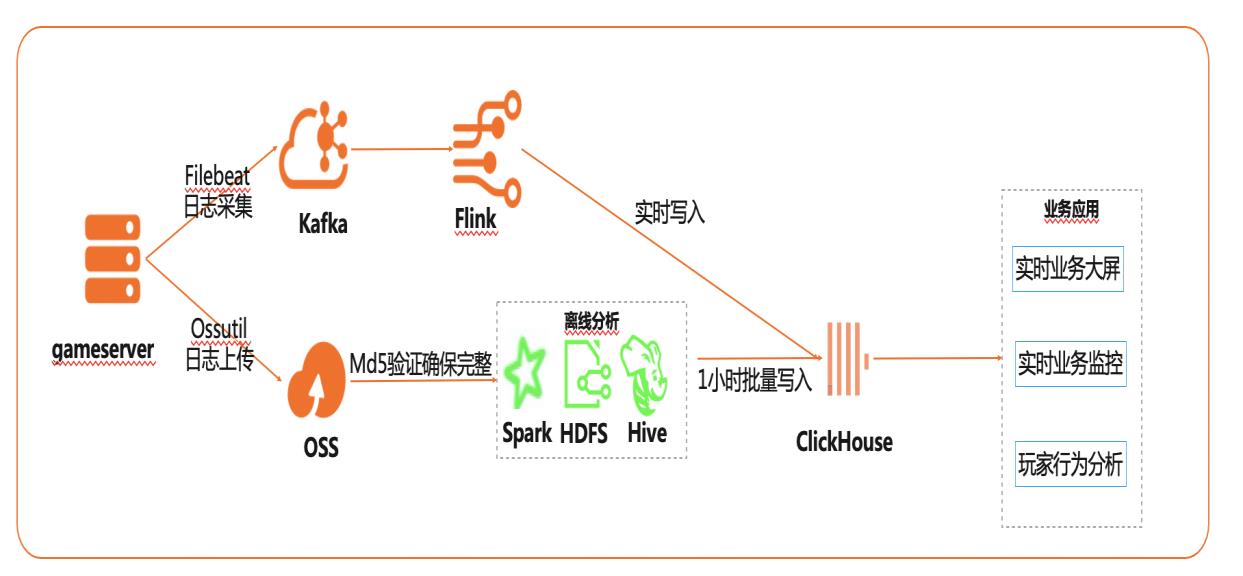

基于Flink+ClickHouse构建实时游戏数据分析

在互联网、游戏行业中,常常需要对用户行为日志进行分析,通过数据挖掘,来更好地支持业务运营,比如用户轨迹,热力图,登录行为分析,实时业务大屏等。当业务数据量达到千亿规模时,常常导致分析不实时,平均响应时间长达10分钟,影响业务的正常运营和发展。 本实践介绍如何快速收集海量用户行为数据,实现秒级响应的实时用户行为分析,并通过实时流计算Flink/Blink、云数据库ClickHouse等技术进行深入挖掘和分析,得到用户特征和画像,实现个性化系统推荐服务。 通过云数据库ClickHouse替换原有Presto数仓,对比开源Presto性能提升20倍。 利用云数据库ClickHouse极致分析性能,千亿级数据分析从10分钟缩短到30秒。 云数据库ClickHouse批量写入效率高,支持业务高峰每小时230亿的用户数据写入。 云数据库ClickHouse开箱即用,免运维,全球多Region部署,快速支持新游戏开服。 Flink+ClickHouse+QuickBI

结论:云数据库 ClickHouse更加适合海量数据分析型业务、大宽表聚合查询分析、数 据 Hash对齐 Join场景、实时日志分析场景等等 文档版本:20201224 6 基于 Flink+ClickHouse构建实时游戏数据分析 架构设计 2.架构设计 2.1.架构图 本实践主要以流处理为主线,搭建实验环境,构建在线用户行为分析平台:2.2.核心模块 游戏服...

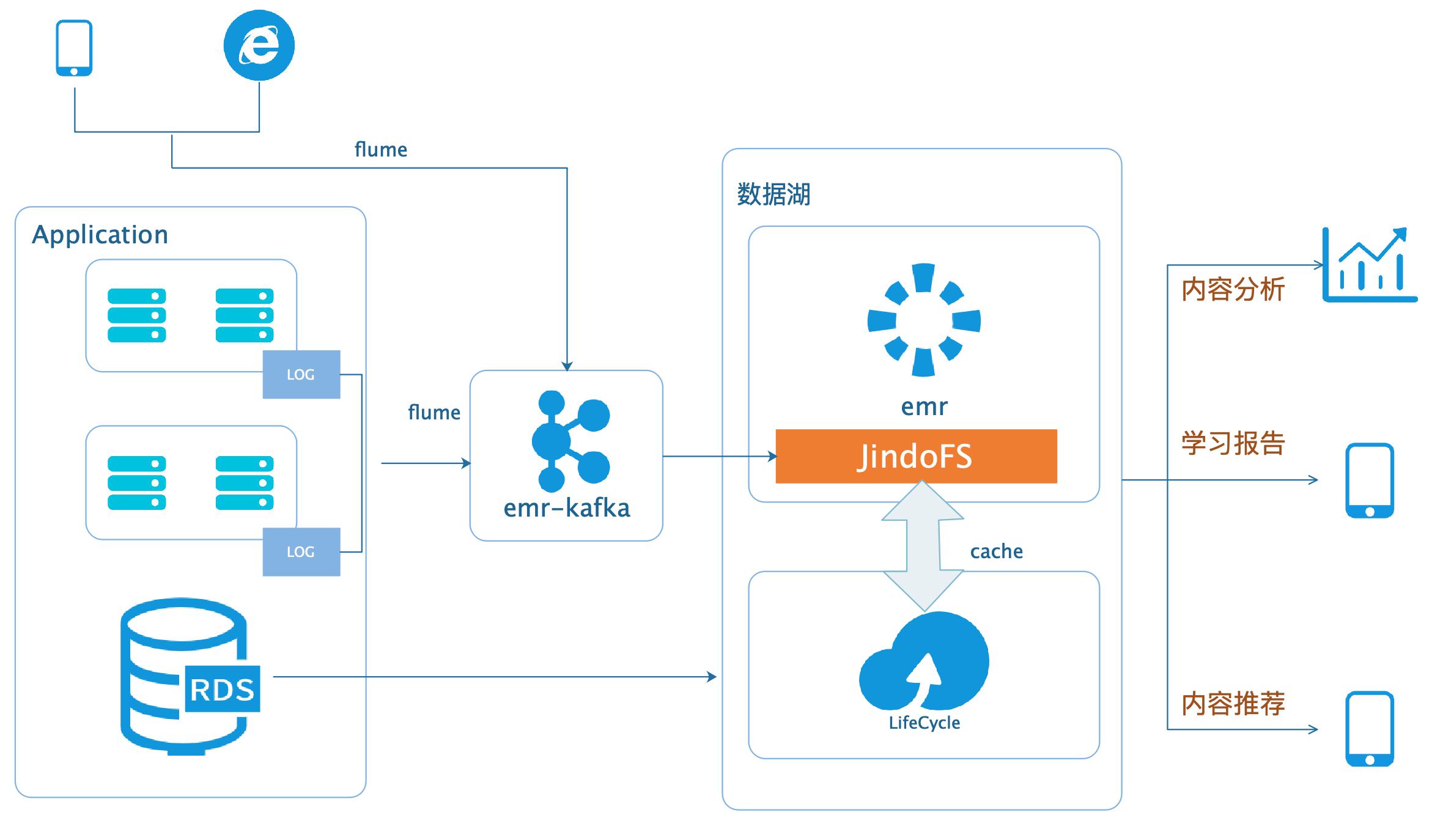

数据湖-在线学习场景数据分析

场景描述 本场景以在线教育中一个答题闯关类的应用为 例,使用WebServer来模拟演示这类日志数据 的分析处理。通过Nginx和Pythonflask搭建 WebServer,模拟应用中的关键页面,比如登 录、课程内容等,之后构造若干用户使用的模拟 日志数据,投递到数据湖进行分析后获取应用 PV、UV、课程内容访问排行、平均得分等等。 解决问题 基于数据湖(EMR+OSS)搭建大数据平台。 EMR和OSS使用和配置。 数据统一存储到OSS。 产品列表 E-MapReduce 对象存储OSS 云服务器ECS 访问控制RAM 专有网络VPC

通过Nginx和Pythonflask搭建WebServer,模拟应用中的关 键页面,比如登录、课程内容等,之后构造若干用户使用的模拟日志数据,投递到数 据湖进行分析后获取应用PV、UV、课程内容访问排行、平均得分等等。方案优势 支持超过10亿条元数据规模的数据管理,同时支持高可靠和高可用。 支持元数据实时备份和重建集群快速恢复...

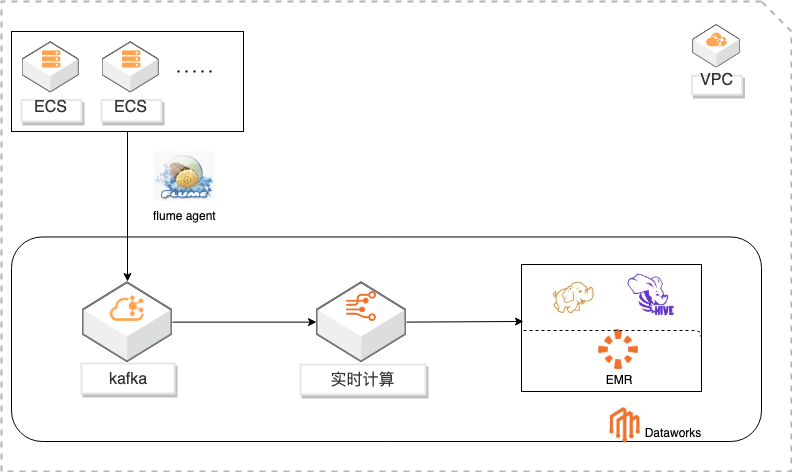

基于DataWorks的大数据一站式开发及数据治理

概述 基于Dataworks做大数据一站式开发,包含数据实时采集到kafka通过实时计算对数据进行ETL写入HDFS,使用Hive进行数据分析。通过Dataworks进行数据治理,数据地图查看数据信息和血缘关系,数据质量监控异常和报警。 适用场景 日志采集、处理及分析 日志使用Flink实时写入HDFS 日志数据实时ETL 日志HIVE分析 基于dataworks一站式开发 数据治理 方案优势 大数据一站式开发,完善的数据治理能力。 性能优越:高吞吐,高扩展性。 安全稳定:Exactly-Once,故障自动恢复,资源隔离。 简单易用:SQL语言,在线开发,全面支持UDX。 功能强大:支持SQL进行实时及离线数据清洗、数据分析、数据同步、异构数据源计算等Data Lake相关功能 ,以及各种流式及静态数据源关联查询。

文档版本:20201020 43 基于 Dataworks的大数据一站式开发及数据治理 数据治理 步骤4 添加规格,比如本例监控错误数的波动情况,如果波动上升进行报警,即错误率飙升 的时候给我们报警,进一步查询错误原因。步骤5 可以先试跑测试数据规则。步骤6 关联调度,每次调度后都会检测数据规则。步骤7 添加 hive_log节点进行关联,...

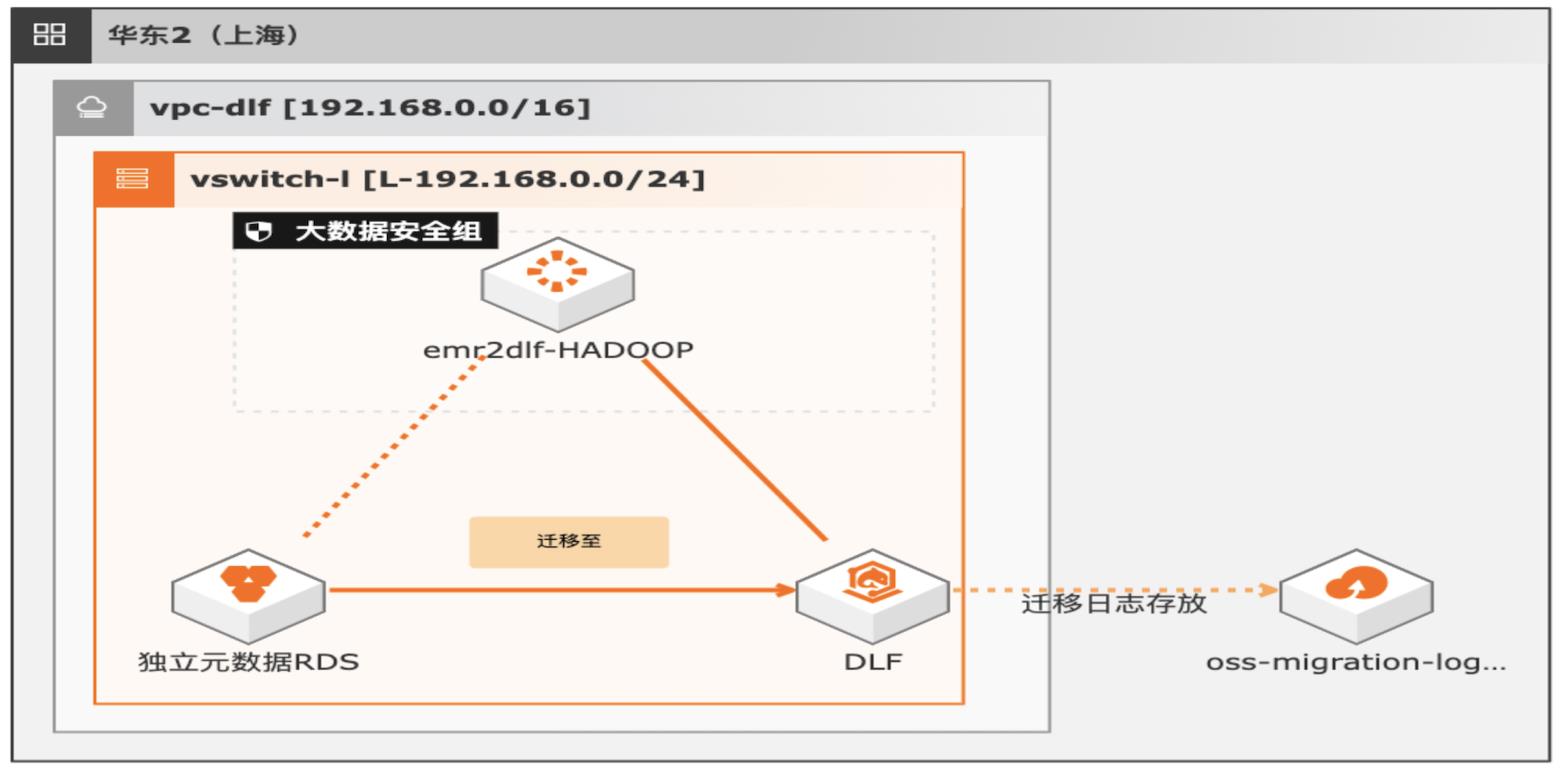

湖仓一体架构EMR元数据迁移DLF

通过EMR+DLF数据湖方案,可以为企业提供数据湖内的统一的元数据管理,统一的权限管理,支持多源数据入湖以及一站式数据探索的能力。本方案支持已有EMR集群元数据库使用RDS或内置MySQL数据库迁移DLF,通过统一的元数据管理,多种数据源入湖,搭建高效的数据湖解决方案。

湖仓一体架构 EMR元数据迁移 DLF最佳实践 业务架构 场景描述 解决的问题 通过 EMR+DLF数据湖方案,可以为企业提供数据 EMR元数据迁移至 DLF 湖内的统一的元数据管理,统一的权限管理,支持多 元数据迁移验证 源数据入湖以及一站式数据探索的能力。本方案支 数据一致性校验 持已有 EMR集群元数据库使用 RDS或内置 MySQL ...

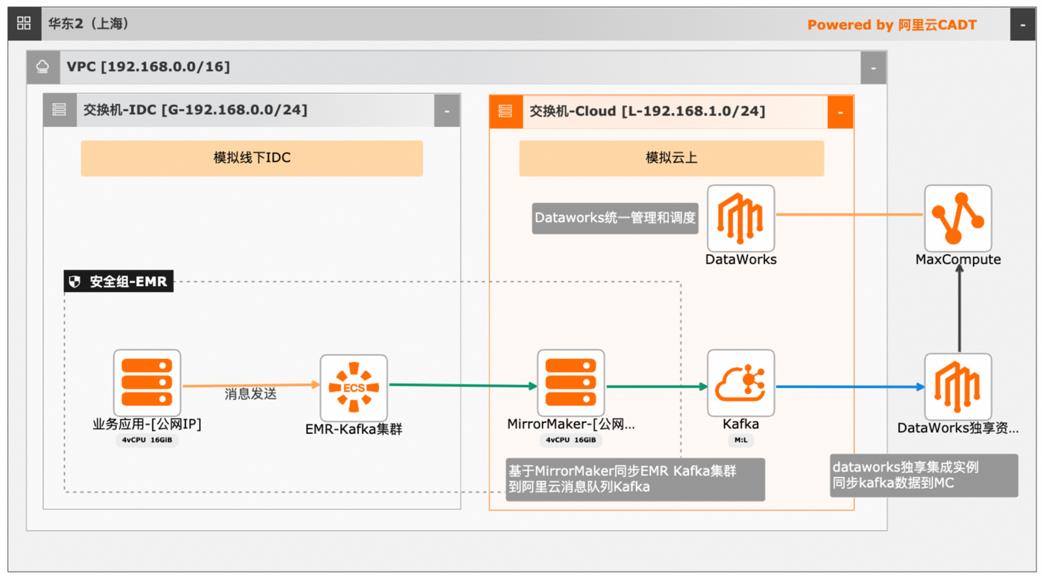

大数据近实时数据投递MaxCompute

本文介绍离线大数据场景使MaxCompute构建云 上近实时数仓,打通云下数据上云链路,解决数据复杂类型支持和动态分区问题,满足高级数据处理需求的最佳实践。 l混合云环境下,现有业务系统零改造,打通数据上云链路。 l使用UDF实现复杂数据类型转换和数据动态分区。 l使用DataWorks配置周期调度业务流程,数据自动入仓。 l借助MaxCompute优化计算引擎,实现降本增效。 产品列表 云服务器ECS 专有网络VPC 访问控制RAM 数据总线DataHub E-MapReduceEMR DataWorks 大数据计算服务MaxCompute

上近实时数仓,打通云下数据上云链路,解决数据复 使用 UDF实现复杂数据类型转换和数据动态分 杂类型支持和动态分区问题,满足高级数据处理需求 区。的最佳实践。使用 DataWorks配置周期调度业务流程,数据自 产品列表 动入仓。借助 MaxCompute优化计算引擎,实现降本增 云服务器 ECS 效。云消息队列 Kafka 最佳实践频道 ...

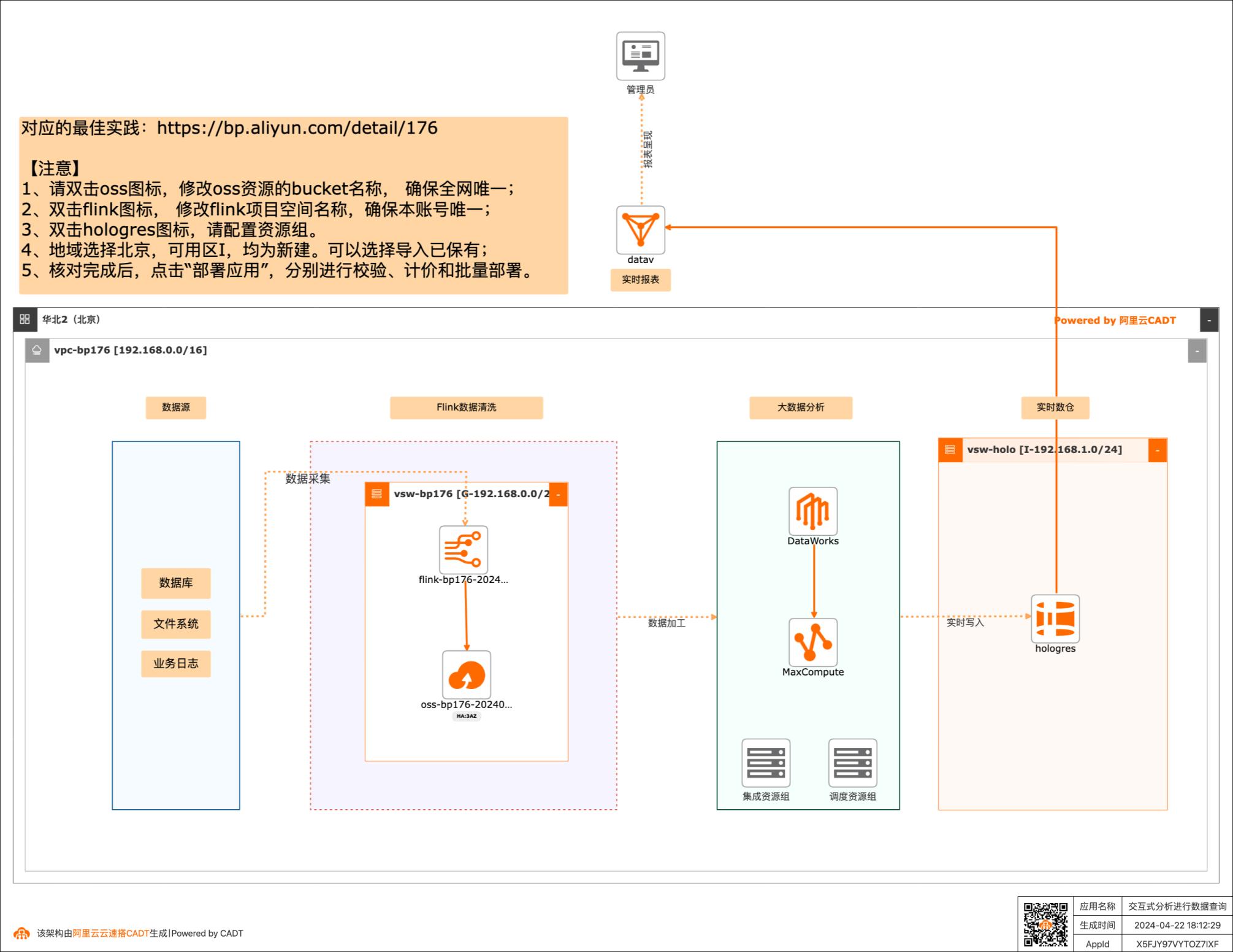

利用交互式分析(Hologres)进行数据查询

场景描述:随着收集数据的方式不断丰富,企业信息化 程度越来越高,企业掌握的数据量呈TB、 PB或EB级别增长。同时,数据中台的快 速推进,使数据应用主要为数据支撑、用户 画像、实时圈人及广告精准投放等核心业务 服务。高可靠和低延时地数据服务成为企业 数字化转型的关键。 Hologres致力于低成本和高性能地大规模 计算型存储和强大的查询能力,为您提供海 量数据的实时数据仓库解决方案和实时交 互式查询服务。 解决问题 1.加速查询MaxCompute数据 2.快速搭建实时数据仓库 3.无缝对接主流BI工具 产品列表 MaxCompute Hologres 实时计算Flink 专有网络VPC DataWorks DataV

Hologres常见使用场景 联邦分析实时数据和离线数据 业务数据分为冷数据和热数据,冷数据存储在离线数据仓库MaxCompute中,热数 据存储在Hologres中。Hologres可以联邦分析实时数据和离线数据,对接BI分析 工具,快速响应简单查询与复杂查询的业务需求。图1.联邦分析架构图 实时数据仓库 实时写入业务数据至实时计算,使用...

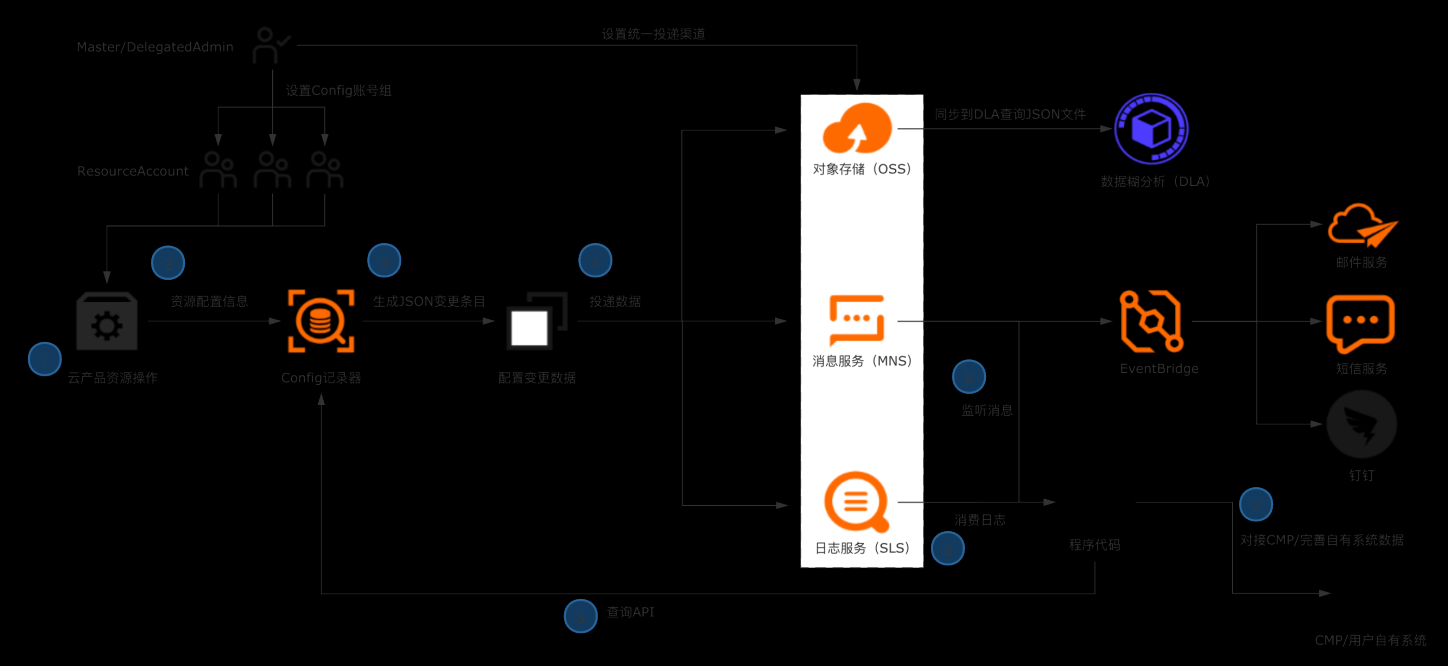

企业构建统一CMDB数据源

典型场景 l 企业/ISV构建多云CMDB平台,对接数十款产品的API,拉取、清洗、格式化、存储配置数据是复杂且高成本的工作。 l 企业日常的资源管理,需依赖资源配置历史、资源关系数据进行故障溯源和影响评估。 解决方案 l 企业管理账号设置Config配置数据投递,将所有账号的资源配置快照和历史归集到统一地址留存。 l 使用OSS做长期归档,使用SLS做实时分析和监听。获取全量资源数据并及时感知云上资源的变更。 l 将数据集成到自有CMDB平台 客户价值 l 基于配置审计简单便捷的持续收集云上资源配置数据,在自建CMDB过程中节省大量人力和时间成本。 l 跨账号统一收集数据,实现中心化的资源配置管理。 l 实现资源配置数据的持续收集和监听,及时感知云上资源的增删改,洞察异常变更。

获取ECS网络信息 本章节,我们以ECS资源的网络配置数据为例,使用 python脚本模拟将资源配置数 据导入企业自有系统。用到了配置审计的 API,在使用前需要导入阿里云 SDK 核心库:aliyun-python-sdk-core:在多账号情况下,列出主账号下指定账号 组的所有资源数据:在多账号情况下,查询指定资源的详细数据 注意:上述两个...

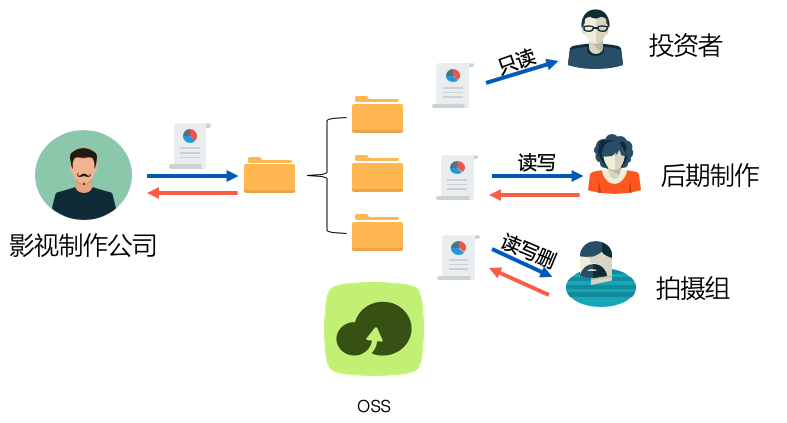

影视数据分发汇集与传输加速

场景描述 使用阿里云对象存储服务OSS及OSSBrowser 工具,实现影视数据多用户多地域分发、汇集, 以及传输加速的最佳实践。 解决问题 1.跨地域、多角色、分权限文件上传、下载。 2.基于OSS及其客户端实现Serverless文件 分发服务(可替换传统FTP服务)。 3.OSS文件传输全球加速。 产品列表 lOSS lRAM

文档版本:20220507 18 影视数据分发汇集与传输加速 子用户创建及目录权限分配 步骤3 创建子用户 b并分配读写权限 文档版本:20220507 19 影视数据分发汇集与传输加速 子用户创建及目录权限分配 步骤4 确认操作成功 步骤5 以子用户 b登录并验证读写权限,具体操作可参考 3.1节中的步骤 5~步骤 7。验证权限部分正常情况:...

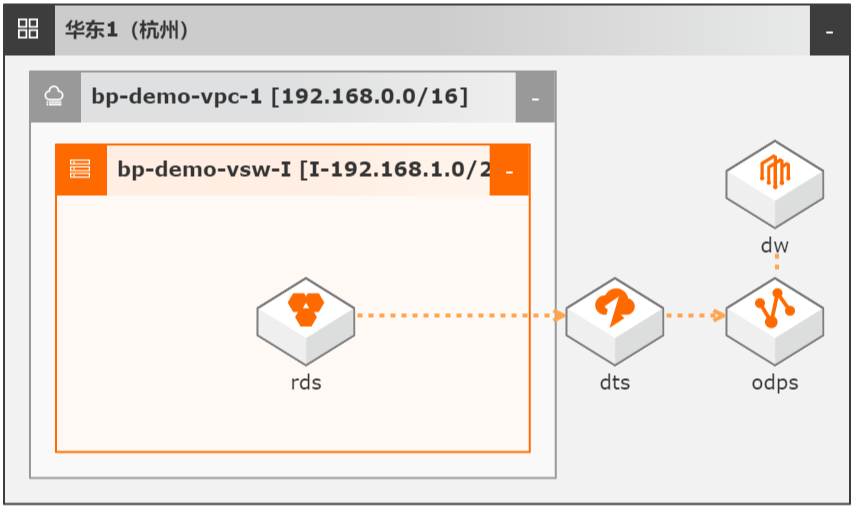

DTS数据同步集成MaxCompute数仓

场景描述 本文Step by Step介绍了通过数据传输服务 DTS实现从云数据库RDS到MaxCompute的 数据同步集成,并介绍如何使用DTS和 MaxCompute数仓联合实现数据ETL幂等和数 据生命周期快速回溯。 解决问题 1.实现大数据实时同步集成。 2.实现数据ETL幂等。 3.实现数据生命周期快速回溯。 产品列表 MaxCompute 数据传输服务DTS DataWorks 云数据库RDS MySQL 版

数据抽取不幂等或容错率低,如凌晨 0:00启动的 ETL任务因为各种原因(数据库 HA切换、网络抖动或 MAXC写入失败等)失败后,再次抽取无法获取 0:00时的数 据状态。2.针对不规范设计表,如没有 create_time/update_time的历史遗留表,传统 ETL需 全量抽取。3.实时性差,抽取数据+重试任务往往需要 1-3小时。另外数据库的数据...

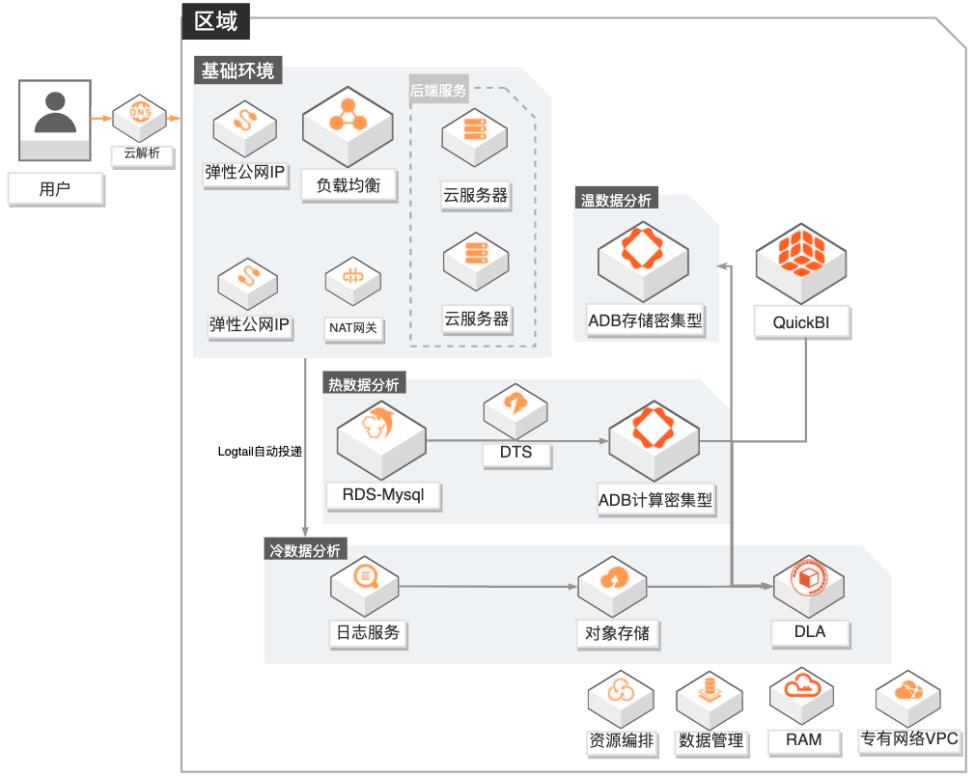

游戏数据运营融合分析

场景描述 1.游戏行业有结构化和非结构化数据融合分 析需求的客户。 2.游戏行业有数据实时分析需求的客户,无法 接受T+1延迟。 3.对数据成本有一定诉求的客户,希望物尽其 用尽量优化成本。 4.其他行业有类似需求的客户。 方案优势/解决问题 1.秒级实时分析:依托ADB计算密集型实例, 秒级监控DAU等数据,为广告投放效果提 供有力的在线决策支撑。 2.高效数据融合分析:打通结构化和非结构化 数据,支撑产品体验分析;广告买量投放效 果实时(分钟级)分析,渠道的评估更准确。 3.低成本:DLA融合冷数据分析+ADB存储密 集型温数据分析+ADB计算密集型热数据分 析,在满足各种分析场景需求的同时,有效 地降低的客户的总体使用成本。 4.学习成本低:DLA和ADB兼容标准SQL语 法,无需额外学习其他技术。 产品列表 专有网络VPC、负载均衡SLB、NAT网关、弹性公网IP 云服务器ECS、日志服务SLS、对象存储OSS 数据库RDSMySQL、数据传输服务DTS、数据管理DMS 分析型数据库MySQL版ADS 数据湖分析DLA、QuickBI

它底层的数据流基础设施为 文档版本:20210224 IV 游戏数据运营融合分析 前言 阿里双 11异地多活基础架构,为数千下游应用提供实时数据流,已在线上稳 定运行 5年之久。您可以使用数据传输轻松构建安全、可扩展、高可用的数据 架构。更多信息,请参见:help.aliyun.com/document_detail/26592.html RDS:云数据库 RDS MySQL...

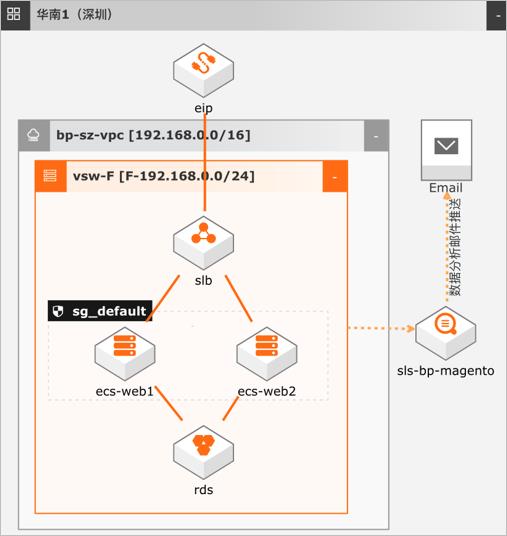

电商网站数据埋点及分析

场景描述 数据埋点是数据产品经理、数据运营以及数据分 析师,基于业务需求(例如:CPC点击付费广 告中统计每一个广告位的点击次数),产品需求 (例如:推荐系统中推荐商品的曝光次数以及点 击的人数)对用户行为的每一个事件对应的位置 进行开发埋点,并通过SDK上报埋点的数据结 果,记录数据汇总后进行分析,推动产品优化或 指导运营。 解决问题 1.电商网站广告位效果统计分析 2.电网网站推荐商品曝光、点击、购买等行为统 计分析 3.电商网站用户分布分析 4.电商网站页面热点图分析等 产品列表 日志服务SLS Dataworks 云服务器ECS 云数据库RDS版 负载均衡SLB 专有网络VPC

email=admin@admin.com \ # 管理员电子邮箱-admin-user=admin \#管理员用户名-admin-password=admin123 \#管理员密码-language=en_US \#语言-currency=USD \#货币-timezone=America/Chicago \#时区-use-rewrites=1#使用伪静态 步骤2 浏览器访问 eip地址,即可访问 magento搭建的电商网站(该镜像已经内置了演示数 据)。...

利用低成本链路完成业务数据迁移上云

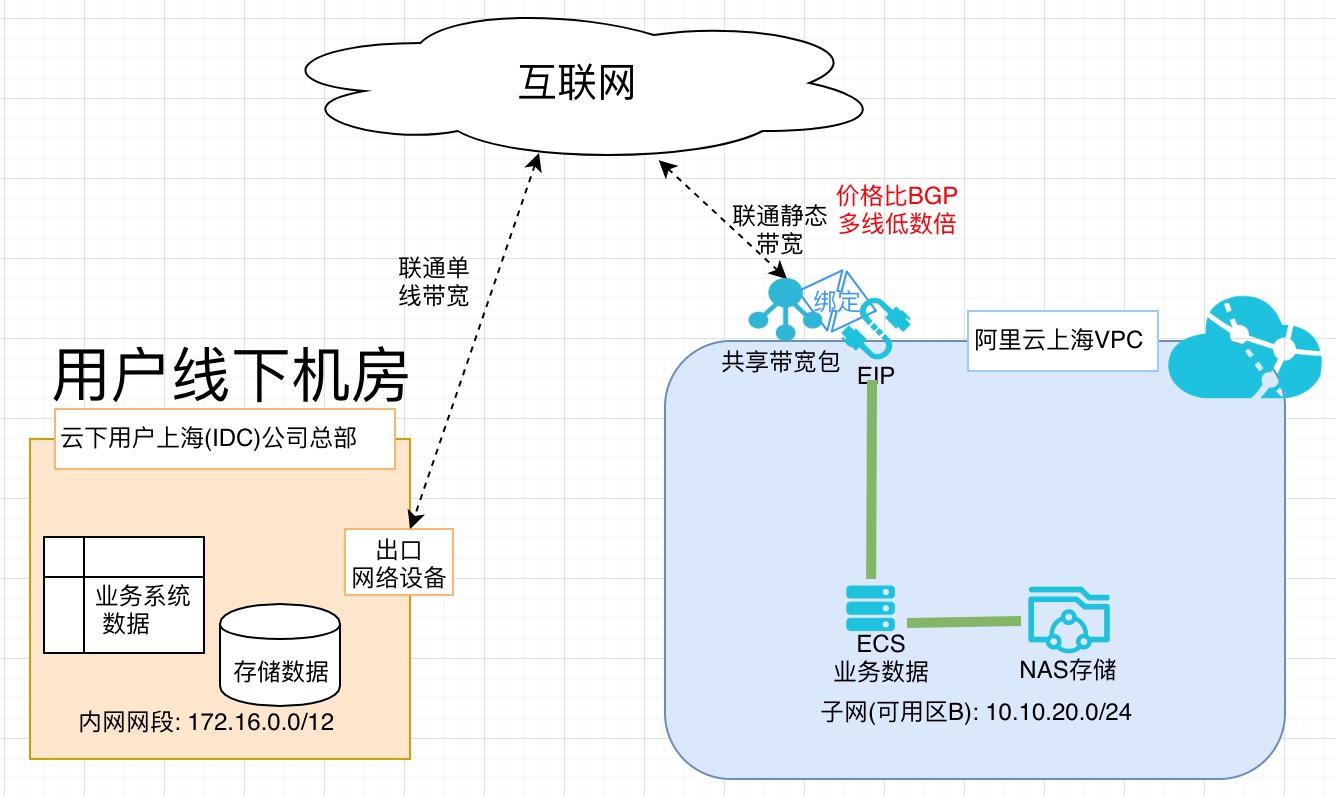

场景描述 随着云计算被越来越多的客户所接受,除业务系 统上云外,很多客户已经把业务数据搬迁上云。 业务数据量一般都比较大,迁移上云需要大量的 网络带宽,BGP费用比较高。阿里云对用户开 放所需地域购买静态单线共享带宽包的权限(移 动/联通/电信均可),可用为迁移数据有效降低 成本。 解决问题 1.业务数据上云网络成本高 产品列表 专有网络VPC 云服务器ECS 网络存储NAS 共享带宽包

利用低成本链路完成业务数据上云 最佳实践 部署架构图 场景描述 随着云计算被越来越多的客户所接受,除业务系 统上云外,很多客户已经把业务数据搬迁上云。业务数据量一般都比较大,迁移上云需要大量的 网络带宽,BGP费用比较高。阿里云对用户开 放所需地域购买静态单线共享带宽包的权限(移 动/联通/电信均可),可用为...

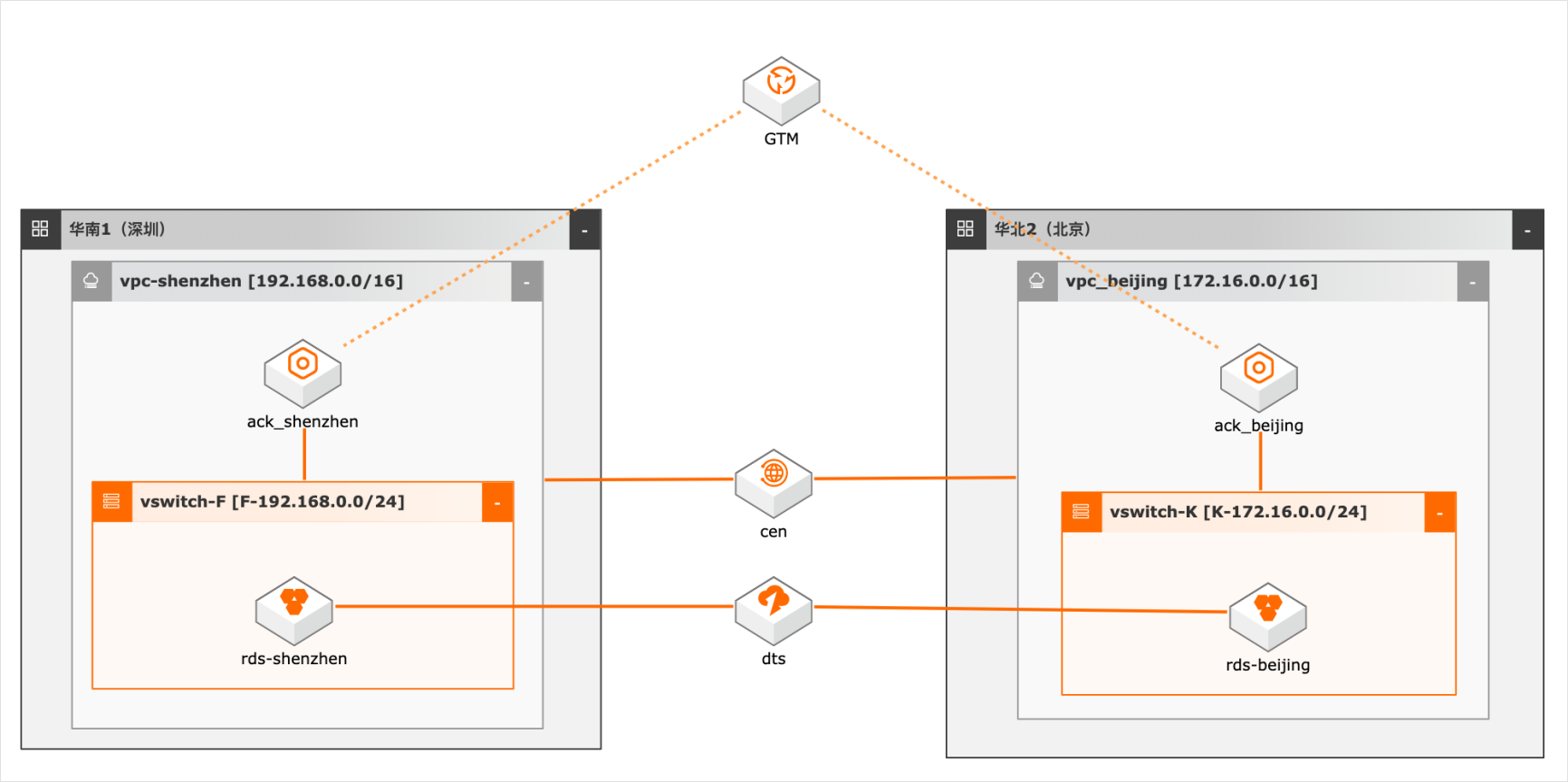

异地双活场景下的数据双向同步

概述 随着客户业务规模的扩大,对系统高可用性要求越来越高,越来越多用户采用异地双活/多活架构,多活架构往往涉及业务侧做单元化改造,本方案仅模拟用户已做单元化改造后的数据双向同步,数据库采用双主架构,本地写本地读,同时又保证双库的数据一致性,为业务增加可用性和灵活性。 适用场景 数据库双向同步 数据库全局ID不冲突 双活架构的数据库建设问题 技术架构 本实践方案基于如下图所示的技术架构和主要流程编写操作步骤: 方案优势 DTS双向同步,采用独立模块避免数据同步占用系统资源。 奇偶ID涉及,避免数据冲突。 DTS多种处理冲突的方式供业务选择。 安全:原生的多租户系统,以项目进行隔离,所有计算任务在安全沙箱中运行。

随着客户业务规模的扩大,对系统高可用性要求越 数据库双向同步 来越高,越来越多用户采用异地双活/多活架构,多 数据库全局 ID不冲突 活架构往往涉及业务侧做单元化改造,本方案仅模 双活架构的数据库建设问题 拟用户已做单元化改造后的数据双向同步,数据库 采用双主架构,本地写本地读,同时又保证双库的数 据一致性,为...

EMR本地盘实例大规模数据集测试

场景描述 阿里云为了满足大数据场景下的存储需求,在云 上推出了本地盘D1机型,这个系列提供了本地 盘而非云盘作为存储,提高了磁盘的吞吐能力, 发挥Hadoop的就近计算优势。阿里云EMR 产品针对本地盘机型,推出了一整套的自动化运 维方案,帮助用户方便可靠地使用本地盘机型, 不需要关注整个运维过程同时数据的高可靠和 服务的高可用。 解决问题 1.云盘多份冗余数据导致成本高 2.磁盘吞吐量不高 3.节点的高可靠分布问题 4.本地盘与节点的故障监控问题 5.数据迁移时自动决策问题 6.自动故障节点迁移与数据平衡问题 产品列表 EMR(E-MapReduce) 本地盘 VPC

Master节点 通常可以生成 1TB的数据进行基准性能测试,首先进入 hive-testbench目录下执行如 下脚本并加载测试数据 参数说明:数据集规模参数单位为 GB,1000表示生成的数据量为 1TB/tpcdata/tpcds 为表数据生成的目录,目录不存在就自动生成,如果不指定目录,数 据目录就默认生成到/tmp/tpcds目录下 cd hive-testbench#如果...

- 产品推荐

- 这些文档可能帮助您