一键训练大模型及部署GPU共享推理服务

通过创建ACK集群Pro版,使用云原生AI套件提交模型微调训练任务与部署GPU共享推理服务。支持快速创建Kubernetes集群,白屏配置任务数据共享存储和下载,并通过命令行工具Arena快速提交模型训练任务、部署推理服务。使用云原生AI套件可以让模型训练和推理提效,提高GPU资源利用率。

通过创建ACK集群Pro版,使用云原生AI套件提交模型微调训练任务与部署GPU共享推理服务。支持快速创建Kubernetes集群,白屏配置任务数据共享存储和下载,并通过命令行工具Arena...优惠购买 阿里云为你推荐优惠购买云产品 优惠购买 10000004177 10000012067 10000001809 免费试用 960313 966411 960308 推荐解决方案 推荐解决方案

来自:

技术解决方案

日志服务 SLS 产品概述

阿里云日志服务SLS为 Log/Metric/Trace 等可观测数据提供一站式提供数据采集、加工、分析、告警可视化与投递、存储功能,兼容开源ELK,满足运维监控与分析,业务分析,安全审计等场景需求。

产品解决方案文档与社区权益中心定价云市场合作...了解更多立即体验,在阿里云创造未来立即领用云产品,开启云上实践之旅,提供80多款免费云产品,帮你创造未来免费试用想体验更多产品功能?立即购买日志服务 SLS产品了解更多阿里云产品介绍?探索阿里云产品了解更多产品介绍遇到了困难需要帮助?联系我们咨询阿里云服务团队

来自:

云产品

实时可观测,即时应对风险

本方案使用日志服务,基于采集的日志数据实现对业务与 IT 系统的监控告警与问题排查,解决性能优化、安全威胁、业务数据分析等问题,从而保障业务稳定性,同时提升客户满意度。

本方案使用日志服务,基于采集的日志数据实现对业务与 IT 系统的监控告警与问题排查,解决性能优化、安全威胁、业务数据分析等问题,从而保障业务稳定性,同时提升客户满意度。...优惠购买 阿里云为你推荐优惠购买云产品 优惠购买 10000011758 10000007185 免费试用 10000011871 10000007666 推荐解决方案 推荐解决方案

来自:

技术解决方案

企业多账号配置统一合规审计

面向企业的各中心管理团队提供一种面向多账号的合规管理方案。从上而下的实施统一的合规基线并强制管理,可中心化的持续监测所有业务的合规状态。提升中心管理团队工作的可见性可控性,切实起到监管效力,规避潜在风险。

立即部署 55分钟 免费(资源目录、配置审计均为免费产品)资源管理 配置审计 云服务器 ECS 云企业网 Web应用防火墙 对象存储 应用场景 技术方案的广泛应用场景 高效实施企业内控基线 企业为保证经营活动的有序运行,保障IT服务的稳定性和合规性,通常会对IT服务制定相关管控措施,来进行监督和审计。法规及行业标准预检 ...

来自:

技术解决方案

开源大数据平台 E-MapReduce 产品概述

开源大数据平台 E-MapReduce是阿里云提供的云原生开源大数据平台,支持多种主流开源大数据组件,具备灵活弹性的资源调度和控制能力。适用于PB 级数据处理、交互分析和机器学习,帮助客户高效构建云端企业级数据湖技术架构。

猿辅导大数据平台团队负责人申阳E-MapReduce Serverless StarRocks 版了解更多立即体验,在阿里云创造未来立即领用云产品,开启云上实践之旅,提供80多款免费云产品,帮你创造未来免费试用想体验更多产品功能?立即购买开源大数据平台 E-MapReduce产品了解更多阿里云产品介绍?探索阿里云产品了解更多产品介绍遇到了困难...

来自:

云产品

卓越效能,极简运维,Serverless高可用架构

本文推荐采用Serverless高可用架构方案,支持服务托管、弹性伸缩和按量付费,减少企业资源管理和性能成本优化的工作,通过高可用的配置,避免可能遇到的单点故障风险。

本文推荐采用Serverless高可用架构方案,支持服务托管、弹性伸缩和按量付费,减少企业资源管理和性能成本优化的工作,通过高可用的配置,避免可能遇到的单点故障风险。...优惠购买 阿里云为你推荐优惠购买云产品 优惠购买 10000008233 10000009724 10000007441 免费试用 970893 10000007243 986754 推荐解决方案 推荐解决方案

来自:

技术解决方案

开源大数据平台 E-MapReduce 相关资源

阿里云大数据平台 E-MapReduce 提供详细的产品文档,面向开发者提供全方位的服务,有免费的实验课程和解决方案体验馆,帮助您快速上手。在阿里云 E-MapReduce 开发者社区,您可以和更多开发者交流。

前往 E-MapReduce 社区下载 E-MapReduce 电子书立即体验,在阿里云创造未来立即领用云产品,开启云上实践之旅,提供80多款免费云产品,帮你创造未来免费试用想体验更多产品功能?立即购买开源大数据平台 E-MapReduce产品了解更多阿里云产品介绍?探索阿里云产品了解更多产品介绍遇到了困难需要帮助?联系我们咨询阿里云服务...

来自:

云产品

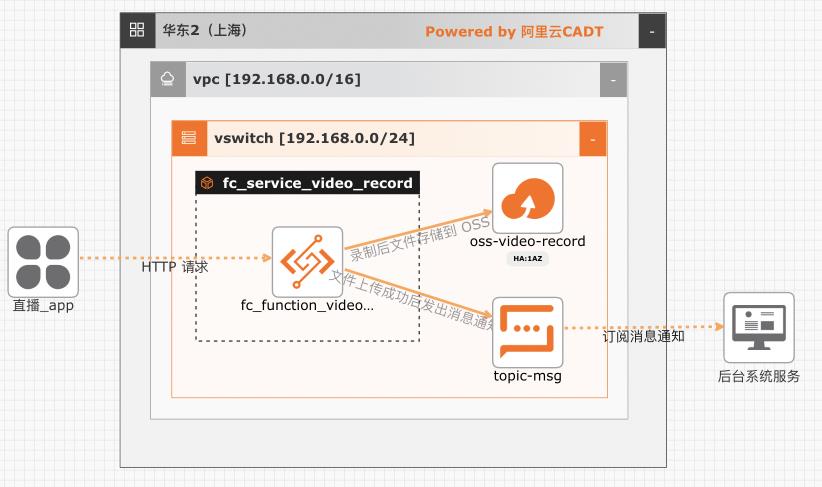

基于函数计算实现直播流录制-存储-通知

在互娱、教育、电商等行业都会有直播相关的业务,大部分场合都需要对直播相关的业务做安全审核,或者对直播的课程进行录制和转码。该方案实现了一种完全按需拉起、按量弹性、按实际使用付费的录制方案。基于本方案还可以扩展实现直播流截帧、自动化安全审核等能力

阿里云对象存储 OSS(Object Storage Service):是一款海量、安全、低成本、高可靠的 云存储服务,可提供 99.9999999999%(12个 9)的数据持久性,99.995%的数据可用性。多种存储类型供选择,全面优化存储成本。阿里云消息服务 MNS(Message Service):是一种高效、可靠、安全、便捷、可弹性扩展 文档版本:20240422 5 ...

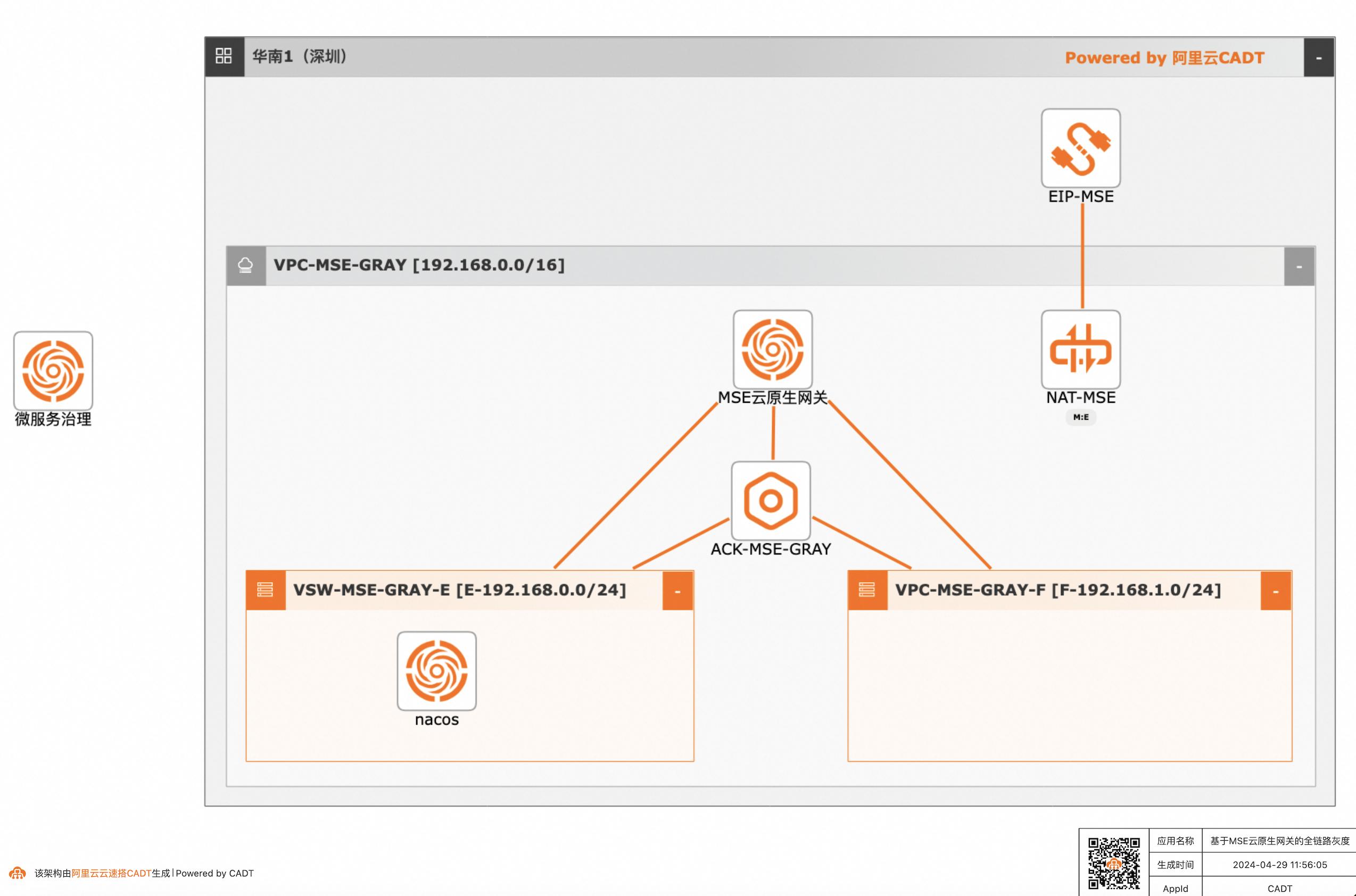

基于MSE云原生网关实现全链路灰度

在微服务场景中,应用间的调用是随机的。当您部署的Spring Cloud应用或Dubbo应用存在升级版本时,可能会导致无法将具有一定特征的流量路由到应用的目标版本。通过MSE提供的全链路灰度能力,您无需修改业务代码,就可以实现端到端的全链路流量控制。泳道可以将应用的相关版本隔离成一个独立的运行环境。通过设置泳道规则,可以将满足规则的请求流量路由到目标版本的应用。

ACK 整合了阿里云的虚拟化、存储、网络和安全能力,助力企业高效运行云端Kubernetes容器化应用。文档版本:20240429 7基于MSE云原生网关实现全链路灰度最佳实践 前置条件 在进行本文操作之前,您需要完成以下准备工作: 注册阿里云账号,并完成实名认证。您可以登录阿里云控制台,并前往实名认证 页面...

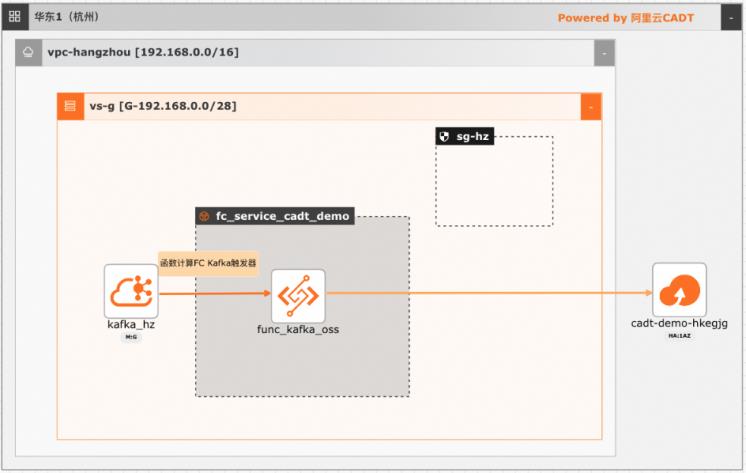

基于函数计算FC实现阿里云Kafka消息轻量级ETL处理

在大数据ETL场景,Kafka是数据的流转中心,Kafka中的数据一般是原始数据,可能存在多种数据混杂的情况,需要进一步做数据清洗后才能进行下一步的处理或者保存。利用函数计算FC,可以快速高效的搭建数据处理链路,用户只需要关注数据处理的逻辑,数据的触发,弹性伸缩,运维监控等阿里云函数计算都已经做了集成,函数计算FC也支持多种下游,OSS/数据库/消息队列/ES等都可以自定义的对接

对象存储 OSS:对象存储 OSS 是一款具有行业领先的安全、稳定、高性价比、高性能的 云存储服务,可以帮助各行业的客户在互联网应用、大数据分析、机器学习、数据归档等 各种使用场景存储任意数量的数据,以及进行任意位置的访问,同时通过丰富的数据处理 能力更便捷地使用数据。云速搭 CADT(Cloud Architect Design Tools...

开源大数据平台 E-MapReduce 产品功能

阿里云开源大数据平台 E-MapReduce 为客户提供简单易集成的Hadoop、Hive、Spark、StarRocks、Flink、Presto、ClickHouse等开源大数据计算和存储引擎。EMR计算资源支持灵活的弹性控制。EMR支持on ECS、on ACK以及Serverless多种部署形态。

开通EMR Doctor智能诊断服务助您高效地运维大数据集群和服务,持续优化集群的资源使用率立即体验,在阿里云创造未来立即领用云产品,开启云上实践之旅,提供80多款免费云产品,帮你创造未来免费试用想体验更多产品功能?立即购买开源大数据平台 E-MapReduce产品了解更多阿里云产品介绍?探索阿里云产品了解更多产品介绍遇到...

来自:

云产品

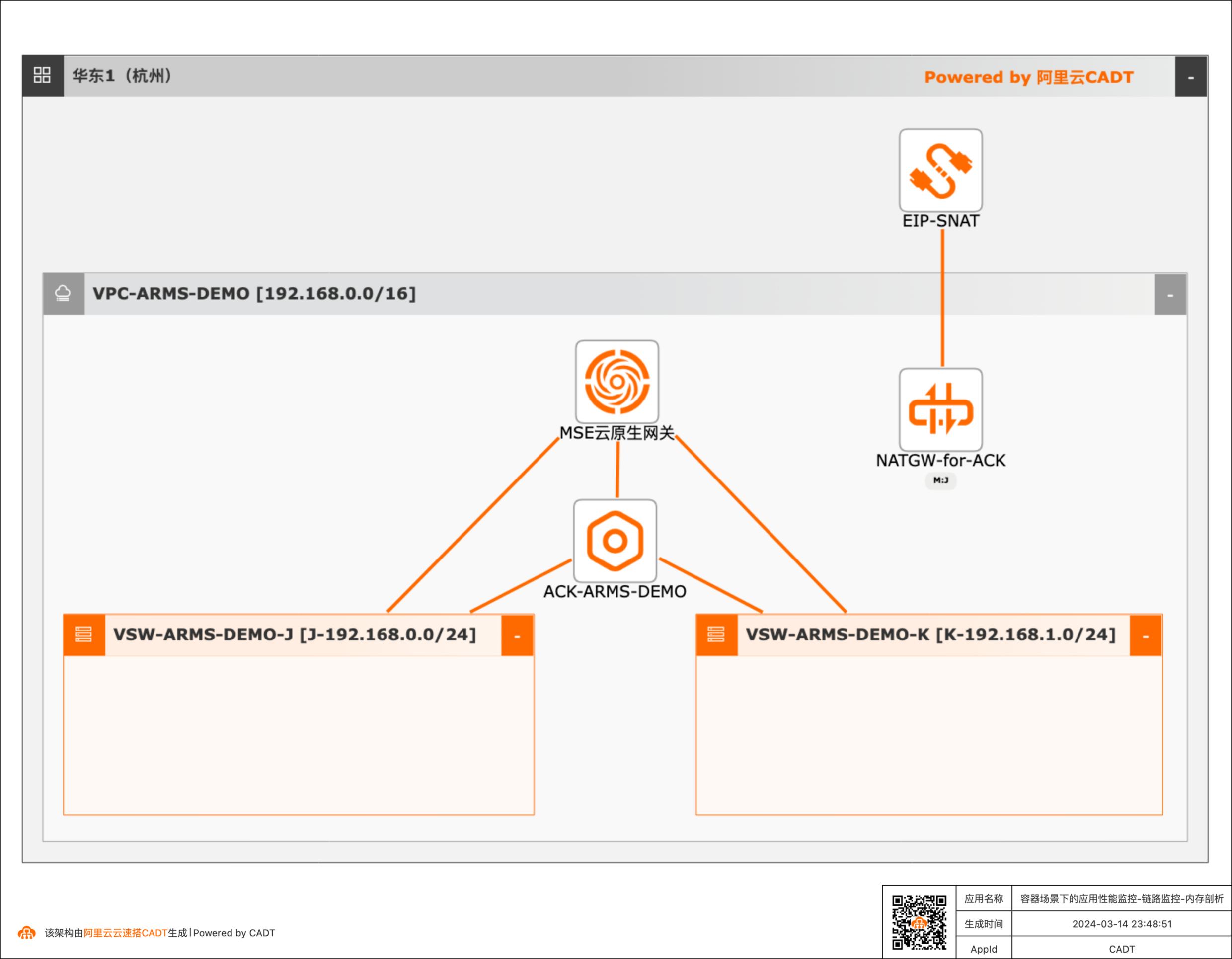

容器场景下的应用性能监控、调用链拓扑、内存剖析

场景描述 随着云原生及微服务技术的普及,越来越多的系统已经通过云原生和微服务技术实现企业的降本增效,同时因微服务及云原生的复杂性给系统运维带来非常大的挑战,云原生应用监控arms通过全链路应用监控,从端到端及代码级别的链路下钻能力、CPU、内存持续剖析及诊断能力,帮助客户降低系统故障定位难度,此demo,您将体验arms的链路监控、内存剖析等能力 应用场景 微服务+容器场景下链路调用拓扑,调用链可以显示出服务之间的调用顺序和层次关系,帮助开发人员理解和追踪代码的执行流程 在分布式系统中,一个请求往往需要通过多个服务来完成。当出现问题时,如请求超时、错误或异常,很难快速定位问题所在。 解决问题 调用链可以帮助运维人员解决以下问题: · 故障排查:当请求失败或出现错误时,调用链可以显示整个请求的路径和每个服务的执行情况,从而帮助运维人员快速定位问题所在。 · 性能优化:通过调用链,运维人员可以了解请求在系统中的执行时间和瓶颈所在,从而进行优化。 · 系统监测:调用链可以提供实时的系统监测和分析,帮助运维人员了解系统的健康状况和资源利用情况。

容器场景下的应用性能监控、调用链拓扑、内存剖析 最佳实践 场景描述 业务架构 随着云原生及微服务技术的普及,越来越多的系 统已经通过云原生和微服务技术实现企业的降 本增效,同时因微服务及云原生的复杂性给系统 运维带来非常大的挑战,云原生应用监控arms 通过全链路应用监控,从端到端及代码级别的链 路下钻能力、CPU...

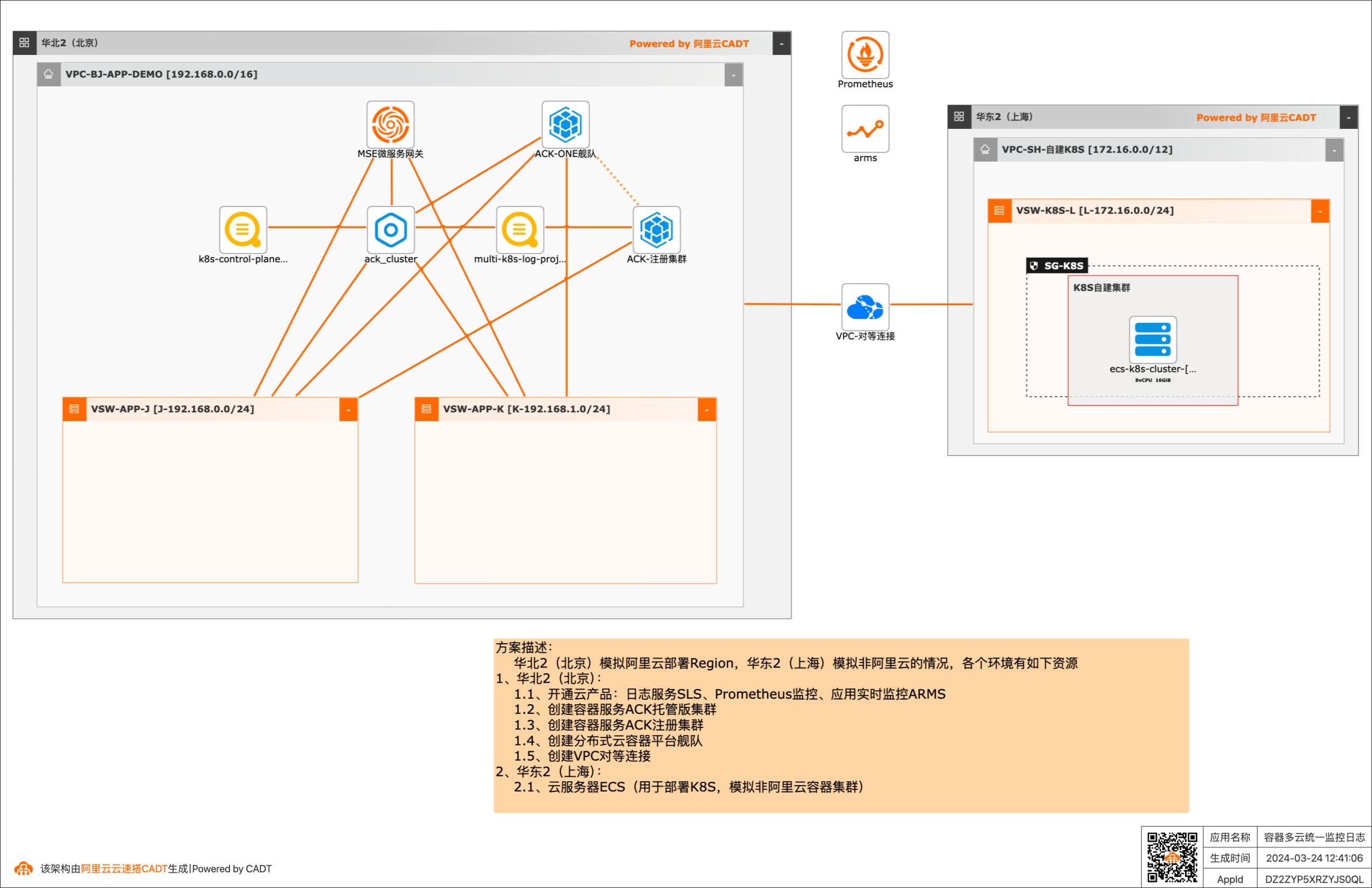

容器多云统一监控日志

多云、混合云成为常态,Forrester 报告中指出,未来 89% 的企业至少使用两个云,74% 的企业至少使用三个甚至更多公有云,在面对多云/混合云这样大的趋势下,Gartner报告指出,安全、运维复杂性、财务复杂性是多云架构的主要挑战,本方案给出了在多云/混合云场景下,构建基于容器环境下的统一管理、统一监控和统一日志方案,解决多云、混合云场景下,运维复杂性问题。 应用场景 客户在阿里云以外的其他云服务商(AWS、Azure、GCP、TencentCloud、HuaweiCloud等)或者IDC基于容器(Kubernetes)运行业务系统,希望构建容器场景下的统一监控日志系统,方便做不同大屏和问题分析定位。 解决问题 •构建容器多云统一监控和日志系统,在一个平台可以看到不同环境系统的运行情况。

分布式云容器平台ACKOne:是阿里云面向混合云、多集群、分布式计算、容 灾等场景推出的企业级云原生平台,ACKOne可以连接并管理您任何地域、任 何基础设施上的Kubernetes集群,并提供一致的管理和社区兼容的API,支持 对计算、网络、存储、安全、监控、日志、作业、应用、流量等进行统一运维管 控。 日志服务SLS:是云...

云存储解决方案

云存储解决方案面向大数据存储、多媒体存储(视频存储)、视频监控、基因生命科学、数据迁移、自动驾驶、在线教育、混合云存储、数据迁移、数据容灾备份等多个行业用户的多元化场景,提供更安全稳定、更优化、无缝上云的智能数据存储服务,为企业上云、实现数字化转型奠定数据基础。

以阿里云混合云存储阵列为基石,结合云存储能力,为传统安防视频监控行业提供了可扩展性的安防监控视频存储解决方案。该解决方案不仅极大程度地释放了用户本地机房的存储空间,更为用户提供了可承载海量视图的云上存储空间.能耗大:每日存储大量数据,用电功耗压力大.弹性差:特殊情况导致存储压力问题.成本高:需要投入大...

来自:

解决方案

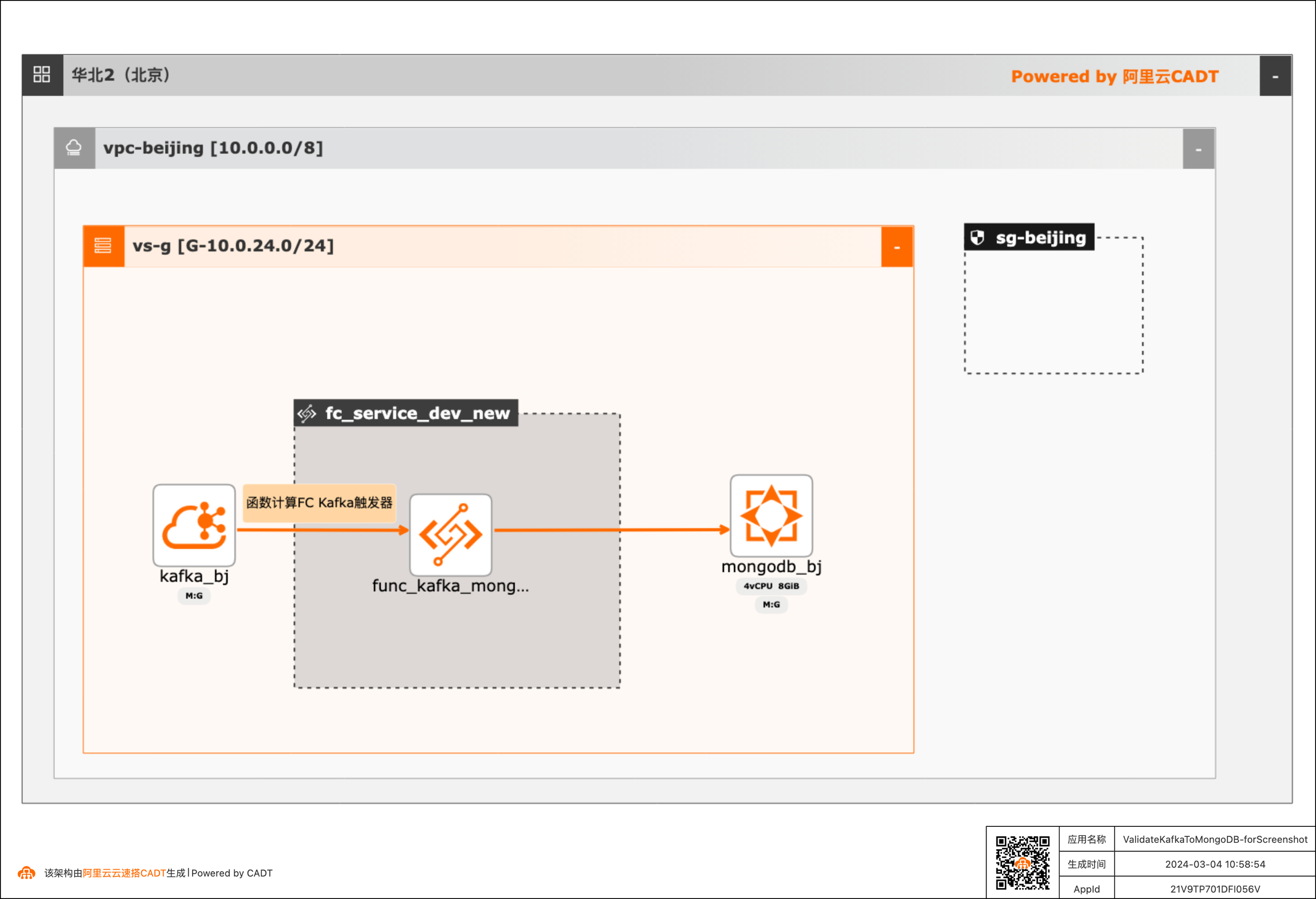

基于函数计算FC实现阿里云Kafka消息内容控制MongoDB DML操作

在大数据ETL场景,将Kafka中的消息流转到其他下游服务是很常见的场景,除了常规的消息流转外,很多场景还需要基于消息体内容做判断,然后决定下游服务做何种操作。 该方案实现了通过Kafka中消息Key的内容来判断应该对MongoDB做增、删、改的哪种DML操作。 当Kafka收到消息后,会自动触发函数计算中的函数,接收到消息,对消息内容做判断,然后再操作MongoDB。用户可以对提供的默认函数代码做修改,来满足更复杂的逻辑。 整体方案通过CADT可以一键拉起依赖的产品,并完成了大多数的配置,用户只需要到函数计算和MongoDB控制台做少量配置即可。

u 存储引擎:阿里云 Kafka 架构,有云存储和 Local 存储。(详细对比参见文档:https://help.aliyun.com/zh/apsaramq-for-kafka/cloud-message-queue-for- kafka/product-overview/comparison-between-storage-engines )u 消息类型:普通消息。创建 Group:u Group 名称:根据实际业务自行填写。u Group 描述:根据实际...

向量检索服务 Milvus 版

阿里云向量检索服务Milvus版是一款云原生开源向量检索引擎,为用户提供多模态检索服务和高效稳定的向量数据检索能力,与云计算等产品集成对接,为AI应用场景的数据工程提供便利。

产品解决方案文档与社区权益中心定价云市场...来了解更多常见问题,找到您的答案立即体验,在阿里云创造未来立即领用云产品,开启云上实践之旅,提供80多款免费云产品,帮你创造未来免费试用想体验更多产品功能?产品了解更多阿里云产品介绍?探索阿里云产品了解更多产品介绍遇到了困难需要帮助?联系我们咨询阿里云服务团队

来自:

云产品

云监控

云监控(CloudMonitor)是阿里云提供的一站式、全链路、开箱即用的云资源监控产品。涵盖云上云下统一的主机监控、百余款的云产品监控、覆盖全球的网络监控、面向应用和业务的日志监控和自定义监控,提供丰富的指标数据和强大开放的平台能力,第一时间发现和定位问题构建完善的监控运维体系。

不限于阿里云产品指标数据,所有存储在企业云监控指标仓库中的数据均可通过PromQL语法以更丰富和灵活的图表组件创建各种复杂的仪表盘.基于机器学习算法动态识别历史数据模式特征(如指标的周期性、整体趋势和波动大小等),自动为每个资源计算出监控指标的上下阈值边界,从而弥补恒定阈值的缺陷.支持用户自定义报警内容,...

来自:

云产品

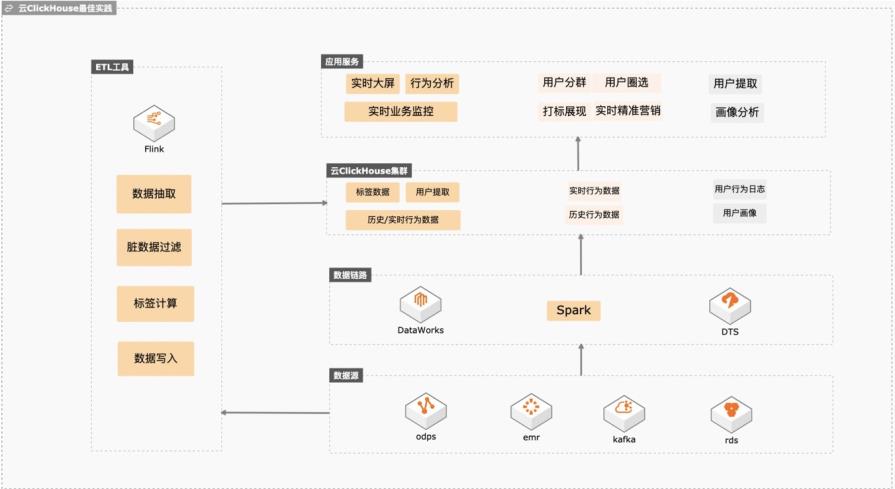

云Clickhouse冷热数据分层存储

基于云ClickHouse可以给电商、游戏、互联网以及其他行业提供高性能、高稳定性、低维护成本、高性价比的实时数据分析、精准营销、业务运营、业务分析、业务预警、业务营销、数仓加速等场景化方案,本实践会向客户提供数据库低维护成本、数据库链路构建、冷热分层存储、快熟分析等操作实践。 解决问题 1. 维护成本低不用建设维护体系,稳定性高,数据倾斜自动均衡。 2. 完善的数据同步链路,可以平滑将业务库、大数据、日志服务的数据同步到Clickhouse,降低研发成本。 3. 平滑升级版本,业务中断小。 冷热分层后透明读取,帮客户节约整体数据存储成本。

广泛应用于流量分析、广告营销 分析、行为分析、人群划分、客户画像、敏捷 BI、数据集市、网络监控、分布 式 服 务 和 链 路 监 控 等 业 务 场 景。更 多 信 息,请 参 见 www.aliyun.com/product/clickhouse 数据传输服务 DTS:数据传输服务(Data Transmission Service)DTS支持关系 型数据库、NoSQL、大数据(OLAP)等数据...

- 产品推荐

- 这些文档可能帮助您