EMR集群安全认证和授权管理

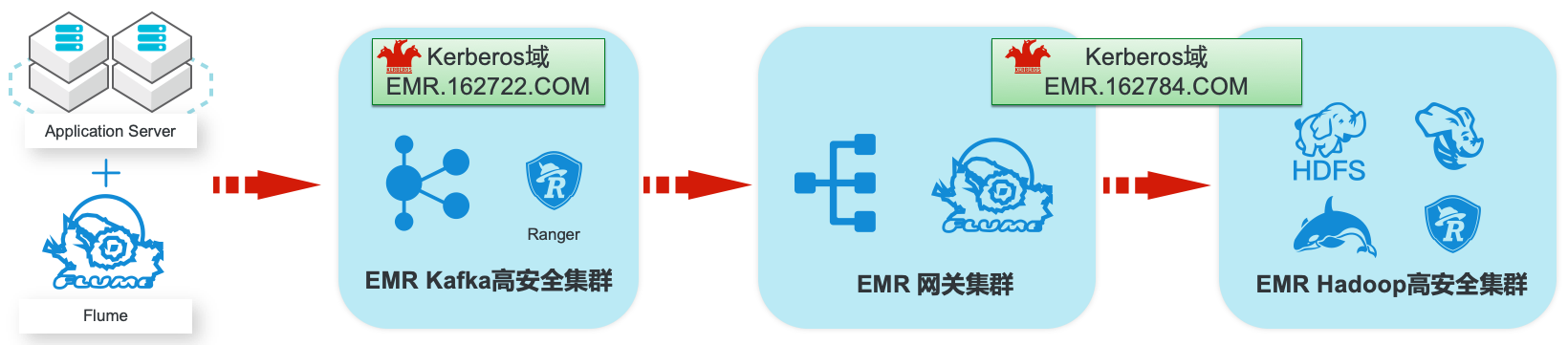

场景描述 阿里云EMR服务Kafka和Hadoop安全集群使 用Kerberos进行用户安全认证,通过Apache Ranger服务进行访问授权管理。本最佳实践中以 Apache Web服务器日志为例,演示基于Kafka 和Hadoop的生态组件构建日志大数据仓库,并 介绍在整个数据流程中,如何通过Kerberos和 Ranger进行认证和授权的相关配置。 解决问题 1.创建基于Kerberos的EMR Kafka和 Hadoop集群。 2.EMR服务的Kafka和Hadoop集群中 Kerberos相关配置和使用方法。 3.Ranger中添加Kafka、HDFS、Hive和 Hbase服务和访问策略。 4.Flume中和Kafka、HDFS相关的安全配 置。 产品列表:E-MapReduce、专有网络VPC、云服务器ECS、云数据库RDS版

理想情况下,授权机制可以利用身份认证机制,以便当用户登录系统(例如集 文档版本:20200330 3 EMR集群安全认证和授权管理 阿里云 EMR集群的用户认证和访问授权 群)时,将根据其在整个系统中对应用程序,数据和其他资源的授权,对他们进行透 明授权。授权有多种方式,从访问控制列表(ACL)到 HDFS 扩展 ACL,再到使用 ...

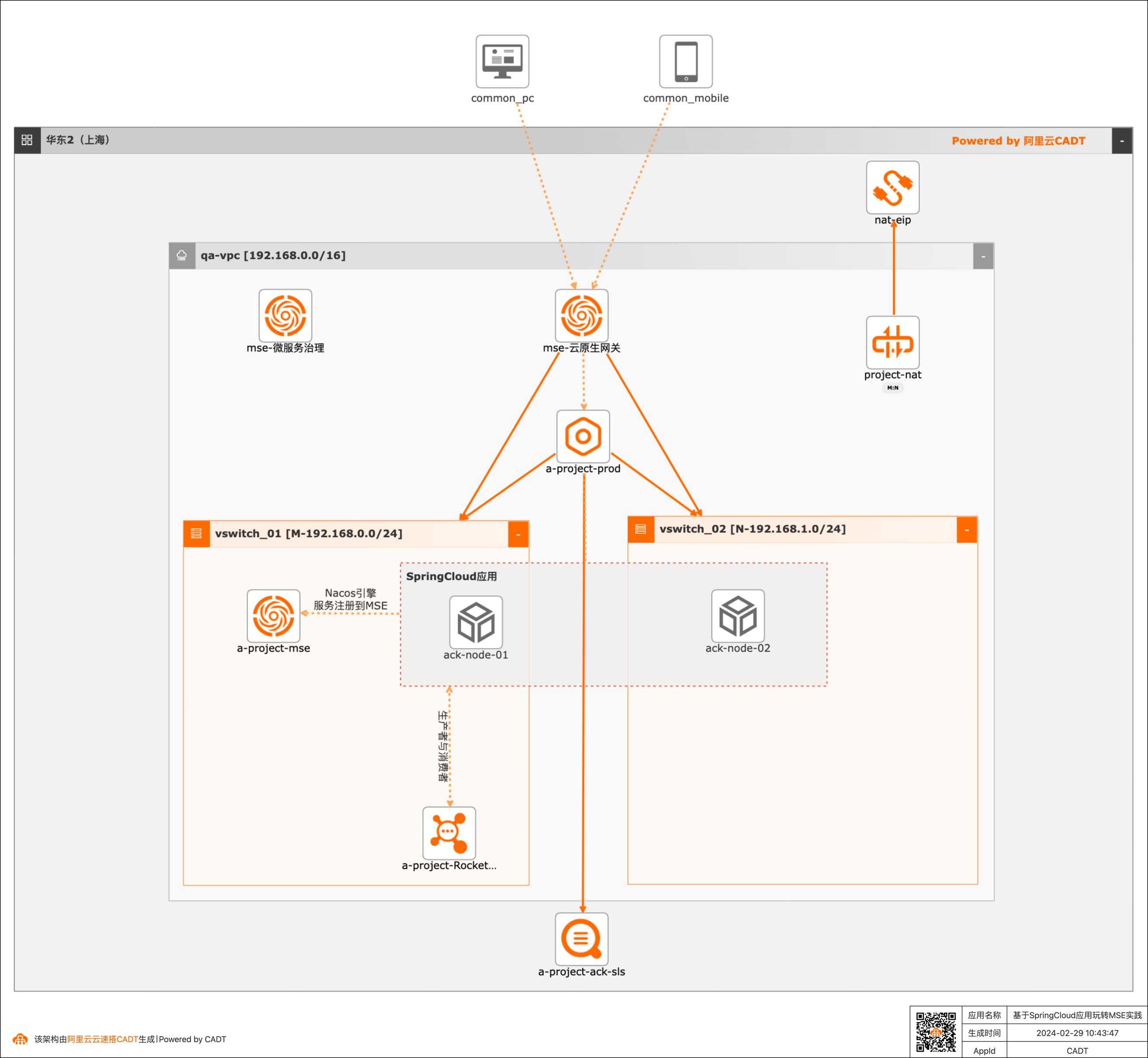

基于SpringCloud应用玩转MSE实践

随着业务不断创新,大型的单个应用和服务会被拆分为数个甚至数十个微服务,微服务架构已经被广泛应用。 微服务的好处在于快速迭代,如何在迭代过程中保障线上流量不受损。依赖开源产品缺少无运维工具,常常需要投入较大的运维人力和成本。 本实践提供基于云原生应用产品提供微服务注册配置中心、微服务治理和云原生网关等一系列高性能和高可用的企业级云服务能力。

5.1.ACK集群部署应用 步骤1登录ACK集群,新建命名空间project-qa(如果修改了命名空间名称,需要对应修改后续yaml文 件的namespace参数)文档版本:20240229基于SpringCloud玩转MSE 步骤2:在命名空间中,通过YAML分别创建4个应用:基线版应用:mseconsumer、mseprovider 灰度版应用:mseconsumer-gray、mseprovider-gray ...

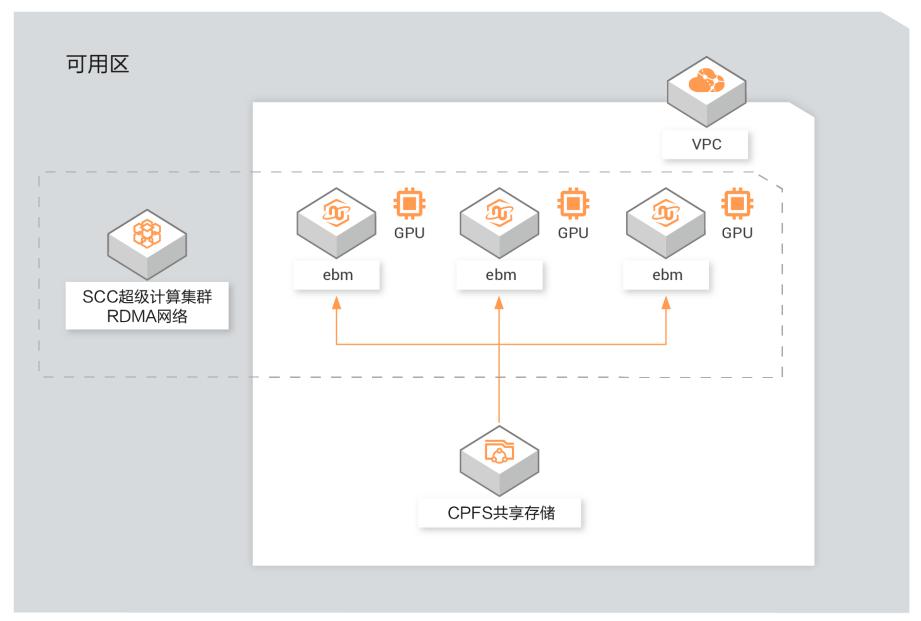

超级计算集群实现自然语言处理训练

场景描述 本方案适用于自然语言训练场景,使用神龙 GPU云服务器(SCCGN6)+CPFS进行NLP的 训练,采用Bert模型。这里不使用容器,直接 使用裸机进行NLP的Bert训练,使用飞天AI加 速训练工具可以有效提升多机多卡的训练效率。 解决问题 使用神龙GPU云服务器搭建NLP训练环 境 使用SCC的RDMA网络 使用CPFS存储训练数据 使用飞天AI加速训练工具加速训练 产品列表 神龙GPU云服务器(SCCGN6) SCC超级计算集群 CPFS共享存储

如本例中,如下:14企业上云实践 基于超级计算集群的自然语言处理AI训练 CPFS文件系统处于运行状态时,禁止对管理节点ECS做删除、停机或修改等操作,禁止对管理节点 上的软件、配置进行修改、删除等操作,否则会影响CPFS的IO业务。 创建挂载点成功后,CPFS文件系统会在您的阿里云账号下自动创建管理节点安全组。在CPFS...

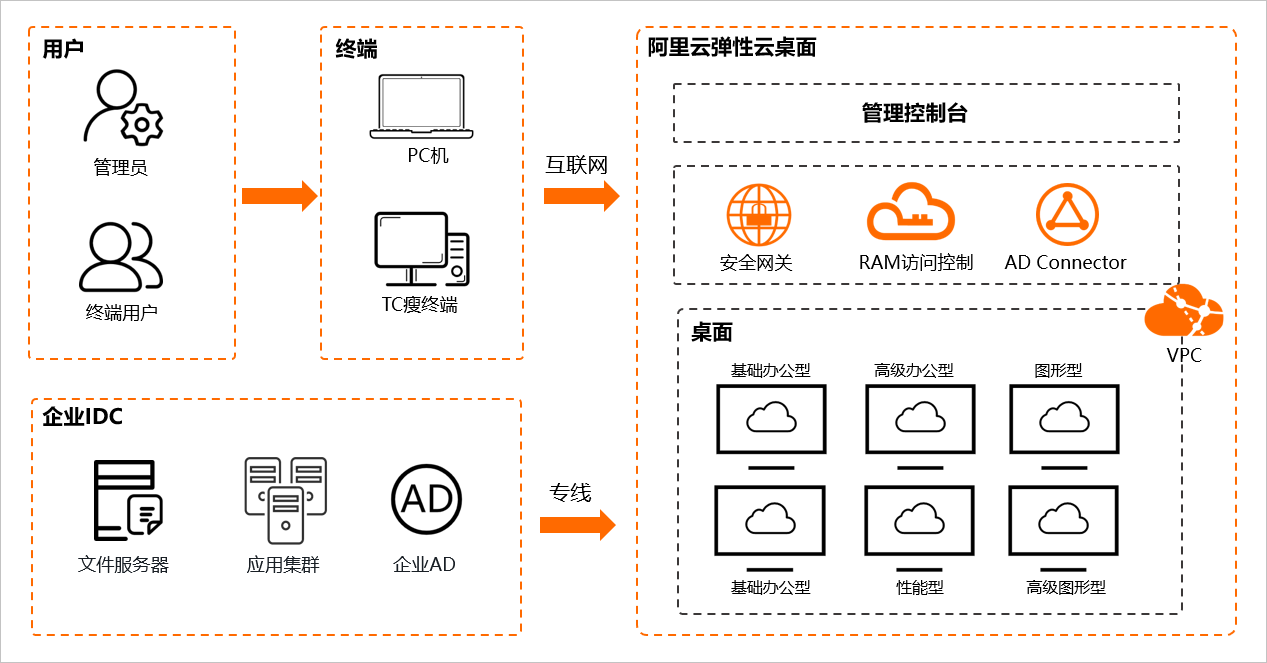

远程办公-AD管控下的弹性云桌面

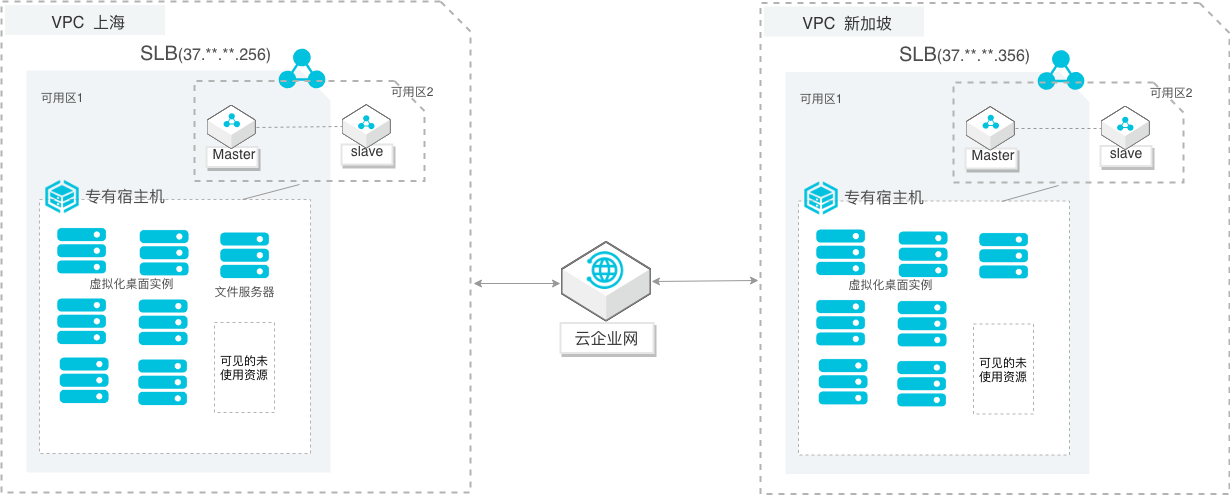

在弹性云桌面中部署企业基础办公环境时,IT人员通常会面临以下问题,本文希望通过场景实践的方式,示范如何结合使用不同阿里云产品,来解决这些问题:用户如何管理?企业已有AD用户如何上云?云上共享文件服务权限怎么管?数据安全问题有保障吗?该如何设置?云桌面能使用本地机房或IDC中的服务吗? 本文使用的应用场景: 场景1:客户A在云上新建Windows ActiveDirectory(以下简称AD);弹性云桌面,和NAS文件存储服务部署在AD所在的VPC内。场景2:客户B在阿里云上已有AD和NAS。弹性云桌面创建在与AD不同的VPC中。AD与云桌面的VPC通过CEN连接。场景3:客户C在云下IDC有自建AD和文件服务。弹性云桌面创建在阿里云上。云下机房与阿里云弹性云桌面所在VPC通过IPsec VPN连接。 方案优势: 易部署:弹性云桌面支持快速便捷的桌面环境创建、部署、统一管控与运维。 CEN和VPN网关服务开通即用,配置实时生效,快速完成部署。 低成本:弹性云桌面无需前期传统硬件投资,帮您快速构建安全、高性能、低成本的桌面办公体系。可广泛应用于具有高数据安全管控、高性能计算等要求的金融、设计、视频、教育等领域。VPN网关基于Internet建立加密通道,比建立专线更便宜,快速实现混合云。 安全性:VPN网关使用IKE(秘钥交换协议)和IPSec对传输数据或进行加密,保证数据安全可靠。云桌面自带的安全策略保证数据不落地。 集中管控:通过Windows AD对云桌面用户和共享文件服务进行统一权限管控。可实现AD用户自动同步上云,和文件级别的权限管控。

注意:在用 Windows文件资源管理器访问和使用文件系统模式下,阿里云 SMB文 件系统并没有实际加入用户的 AD域。如果不是通过本地磁盘路径 C:\myshare访问 文件系统,而是通过普通网络路径\ as-mount-point.nas.aliyuncs.com\myshare访 问,在设置 ACL时,会遇到因 RPC服务器不可用而无法确定 NAS挂载点是否已加 入域的情况...

云基础产品与基础设施

云基础产品与基础设施作为阿里云产品六大版块之一,主要包含弹性计算、存储、网络、安全、云原生应用平台以及无影和基础设施类产品,向客户提供高度自动化的标准化产品对网络功能、计算机(虚拟或专用硬件)和数据存储空间进行访问,同时支持灵活扩展,可以直接使用自助服务界面。

阿里云提供高度自动化的标准化产品对网络功能、计算机(虚拟或专用硬件)和数据存储空间进行访问,同时可支持灵活扩展,客户可以直接使用自助服务界面,包括基于网页的用户界面和API接口,对 IT 资源进行轻松的管理控制。云基础产品与基础设施主要包含弹性计算、存储、网络、安全、云原生应用平台以及无影和基础设施类产品....

来自:

云产品

虚拟桌面架构的高性能体验云上部署

场景描述 针对自建虚拟化桌面架构迁移阿里云,以及有虚拟化桌面 架构需求上云。包括但不限于: 1.有许可证合规要求,利用自带license快速上云的客户。 2.对数据安全较高要求,需要快速构建虚拟化桌面的客 户。 解决问题 利用云上灵活性和规模化优势,构建云上更加高效、高性 能体验的服务,为客户解决: 1.客户VDI部署的需求,能够更及时的得到满足。 2.解决硬件资源限制,根据业务规模化部署并集中管 控。 3.利用公共云的网络、计算、备份容灾方案、安全防护 等,提供高可靠、高性能、高体验的远程桌面服务。 产品列表 VPC(专有网络) SLB(负载均衡) CEN(云企业网) 专有宿主机 OpenAPI

35 企业上云实践 虚拟化远程桌面架构的云上部署|创建并部署文件服务器 搭建 FTP站点 服务器管理器中添加用户 路径选择开始>所有程序>管理工具>服务器管理器。单击配置>本地用户和组>用户,单击右键,再选择新用户。在新用户对话框中,参考下表,配置相关信息。配置项 说明 用户名 本实践设置为 ftptest。密码 设置密码,...

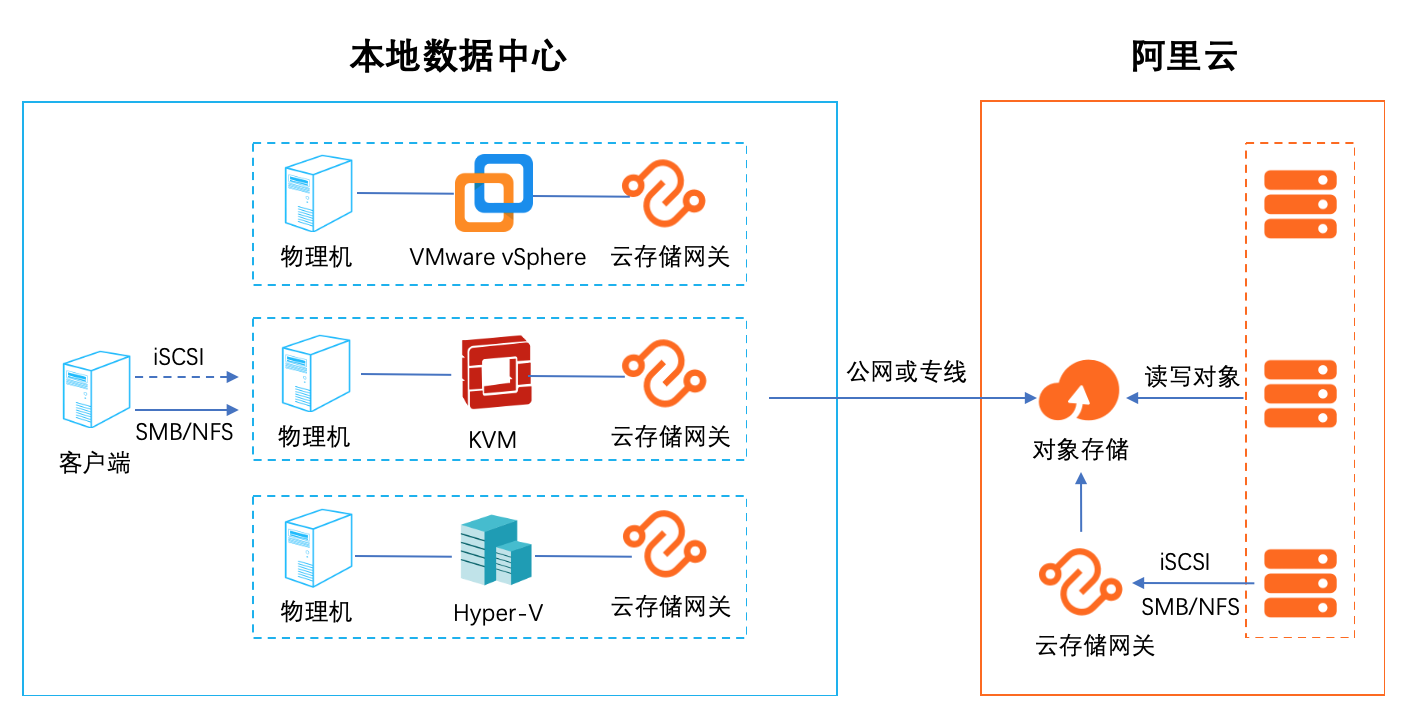

本地数据中心基于SMB/NFS协议访问对象存储最佳实践

1. 云存储扩容和迁移 集成智能缓存算法,自动识别冷热数据,将热数据保留在本地缓存,保证数据访问体验,无感知的将海量云存储数据接入本地数据中心,拓展存储空间。同时在云端 保留全量数据(冷+热)保证数据的一致性 2.云容灾 随着云计算的普及,越来越多的用户把自己的业务放到了云上。但是随着业务的发展,如何提高业务的可靠性和连续性,跨云容灾是一个比较热门的话题。借助云存 储网关对虚拟化的全面支持,可以轻松应对各种第三方云厂商对接阿里云的数据容灾。 3. 多地数据共享和分发 通过多个异地部署的文件网关实例,对接同一个阿里云OSS Bucket,可以实现快速的异地文件共享和分发,非常适合多个分支机构之间互相同步和共享数据。 4. 适配传统应用 有很多用户在云上的业务是新老业务的结合,老业务是从数据中心迁移过来的使用的是标准的存储协议,例如: NFS/SMB/iSCSI。新的应用往往采用比较新的技 术,支持对象访问的协议。如何沟通两种业务之间的数据是一个比较麻烦的事情,云存储网关正好起到一个桥梁的作用,可以便捷的沟通新旧业务,进行数据交换。 5. 替代 ossfs 和 ossftp ossfs 和 ossftp 都是基于文件协议的开源工具,用户可以通过它们直接上传文件到OSS。但是这两个开源文件都不建议在生产环境使用(POSIX 兼容度低),同时挂 载在用户的客户端需要额外的配置和缓存资源,对于多个客户端的情况安装配置繁琐。通过文件网关的服务可以完美替代 ossfs 和 ossftp。通过创建文件网关,用 户只需要执行简单的挂载(NFS)和映射(Windows SMB)就可以像使用本地文件系统一样使用 OSS。

通过创建文件网关,用 户只需要执行简单的挂载(NFS)和映射(Windows SMB)就可以像使用本地文 件系统一样使用 OSS。文档版本:20210525 3 本地数据中心基于 SMB/NFS协议访问对象存储 云存储网关配置 1.云存储网关配置 1.1.开通云存储网关 步骤1 访问云存储网关控制台(https://sgwnew.console.aliyun.com/),开通云存储...

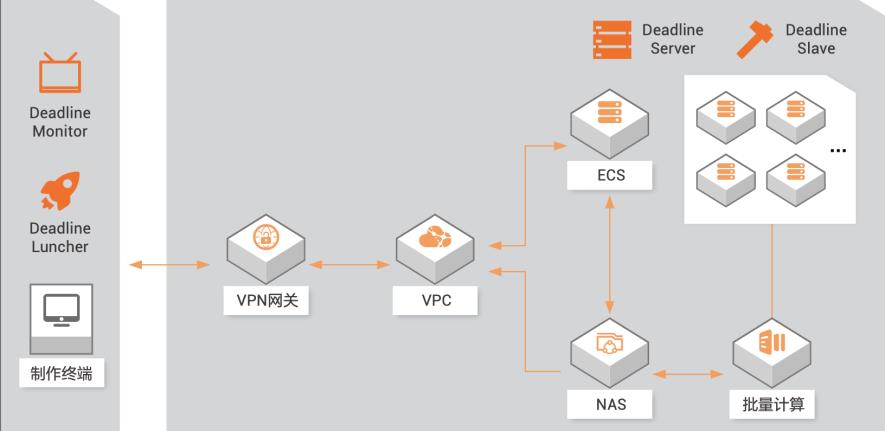

云端影视渲染

场景描述 本文介绍如何搭建一个完整的混合云渲染服务架构,本地与云端的网络以SSL-VPN方式进行互联。 解决问题 1、使用SSL-VPN构建本地网络与云上VPC环境的安全互联。 2、使用批量计算服务管理渲染计算集群,集群计算节点自动加入Deadline资源池。 3、使用Deadline做渲染任务管理。 4、批量计算集群计算节点根据Deadline渲染任务自动扩容和收缩,资源管理自动化。 产品列表 1、云服务器ECS 2、GPU云服务器GPU 3、批量计算BCS 4、专有网络VPC 5、弹性公网IP 6、文件存储NAS

文档版本:20200220 30 云端影视渲染 基于 ECS部署Deadline Server 步骤5 通过复制本地文件,在远程桌面窗口内粘贴,即可将 Deadline 渲染管理软件上传至 deadline-server。4.3.为 ECS实例挂载 NAS及 NFS client配置优化 为 deadline-server挂载 NAS 步骤1 安装 NFS客户端:打开服务器管理器。文档版本:20200220 31 云端...

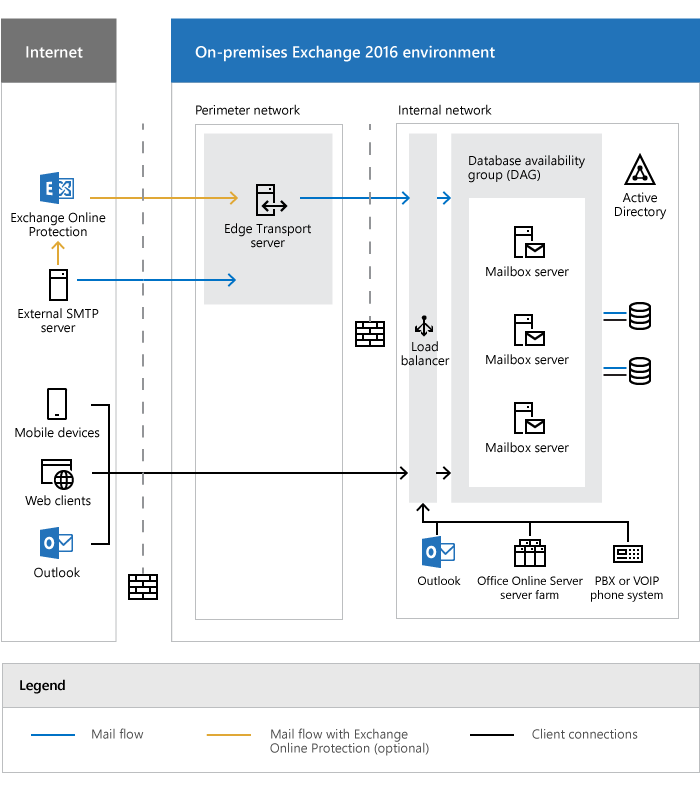

Exchange Server云上部署最佳实践

阿里云提供基础设施服务,能够以高可用、高容错且经济实惠的方式将Exchange Server部署在云上。通过在 阿里云上部署,可以获得Exchange Server的功能以及阿里云天然灵活性和安全性。

可以被用来构架应用 于企业、学校的邮件系统,同时还是一个 协作平台,可以在此基础上开发工作流,知识管理系统,Web系统或者是其他消息 系统。阿里云 阿里云提供基础设施服务,能够以高可 用、高容错且经济实惠的方式将 Exchange Server部署在云上。通过在 阿 里云上部署,可以获得 Exchange Server 的功能以及阿里云天然...

高性能数据库ECS测试及选型

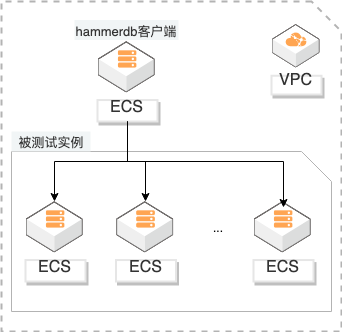

概述 客户自建高性能数据库(如电商大促)在做ECS选型时,对磁盘的IO、网络的吞吐都有很大要求,为了跟接近真实业务场景,使用HammerDB选定真实业务模型测试其TPM。通过对比TPM对比ECS性价比进行选型。同时使用FIO测试磁盘性能作为参考。 适用场景 自建数据库性能测试 磁盘性能测试 ECS选型建议 技术架构 本实践方案基于如下图所示的技术架构和主要流程编写操作步骤: 方案优势 基于标准的TPC-C测试,接近真实业务场景。 提供多规格实例测试,快速选择最优性价比实例。

几乎所有在 OLTP市场提供软 硬平台的国外主流厂商都发布了相应的 TPC-C测试结果,随着计算机技术的不断 发展,这些测试结果也在不断刷新。TPM:按照 TPC组织的定义,流量指标描述了系统在执行支付操作、订单状态查 询、发货和库存状态查询这 4种交易的同时,每分钟可以处理多少个新订单交易。所有交易的响应时间必须满足 TPC...

混合云使用Ali-Perseus

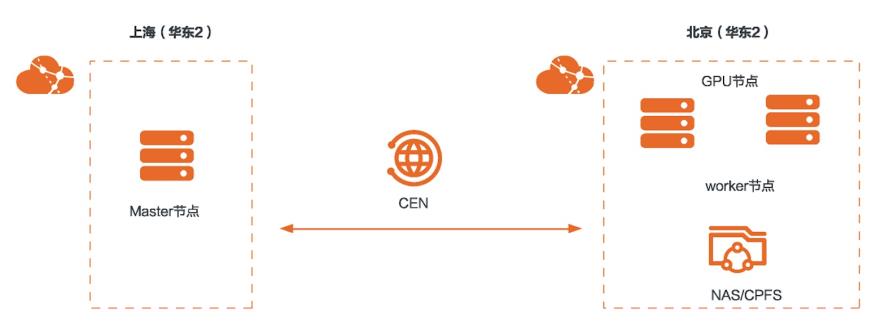

场景描述 本文介绍了混合云场景中,自建 Kubernetes服务,线下集群+云上弹性扩 展阿里云GPU服务实例+飞天AI加速工 具,并采用阿里云CPFS存储,运行AI训 练+AI推理作业的操作步骤。 解决问题 1.利用云企业网打通两个地域的VPC, 自建Kubernetes集群 2.使用飞天AI加速工具运行训练和推理 作业 3.使用CPFS存储共享数据 产品列表 云企业网CEN GPU云服务器 并行文件存储CPFS 文件存储NAS

Perseus Inference Client提供客户端 API接 口,应用程序调用这些接口去请求 Perseus Model Server的推理服务。Perseus Inference目前提供容器的部署方式,它依赖于 CUDA10、CUDNN7 和 TensorRT5,用户需要在 NVIDIA GPU机器上安装 docker和 nvidia-docker 运行环境以满足 Perseus Inference容器的运行需求。阿里云提供 ...

企业办公安全访问一体化

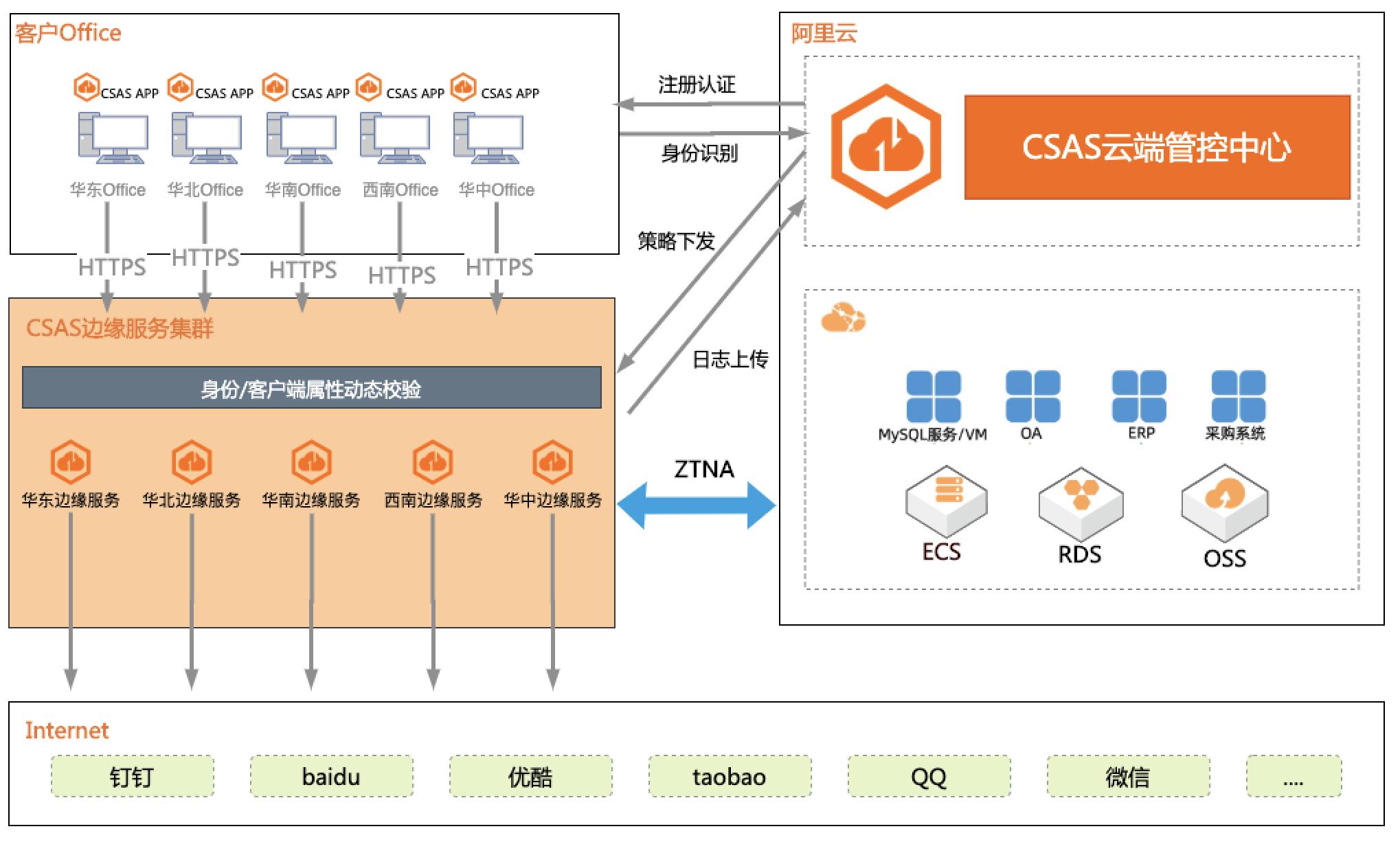

本场景模拟企业办公环境,基于 CSAS 服务构 建企业办公安全一体化方案,将“安全 + 网络” 能力无缝融合,实现了对云下办公终端安全的统 一管理,企业无需在投资复杂且昂贵的传统硬件 安全设备,即可快速构建安全、可靠、低成本的 办公安全防护体系。 1. 企业办公环境访问互联网的安全管理 2. 企业办公环境访问内网服务的安全管理 3. 企业办公网络、安全一体化管理

企业办公安全访问一体化最佳实践 业务架构 场景描述 本场景模拟企业办公环境,基于CSAS服务构建 企业办公安全一体化方案,将“安全+网络”能力 无缝融合,实现了对云下办公终端安全的统一管 理,企业无需在投资复杂且昂贵的传统硬件安全 设备,即可快速构建安全、可靠、低成本的办公 安全防护体系。解决问题 1.企业办公环境...

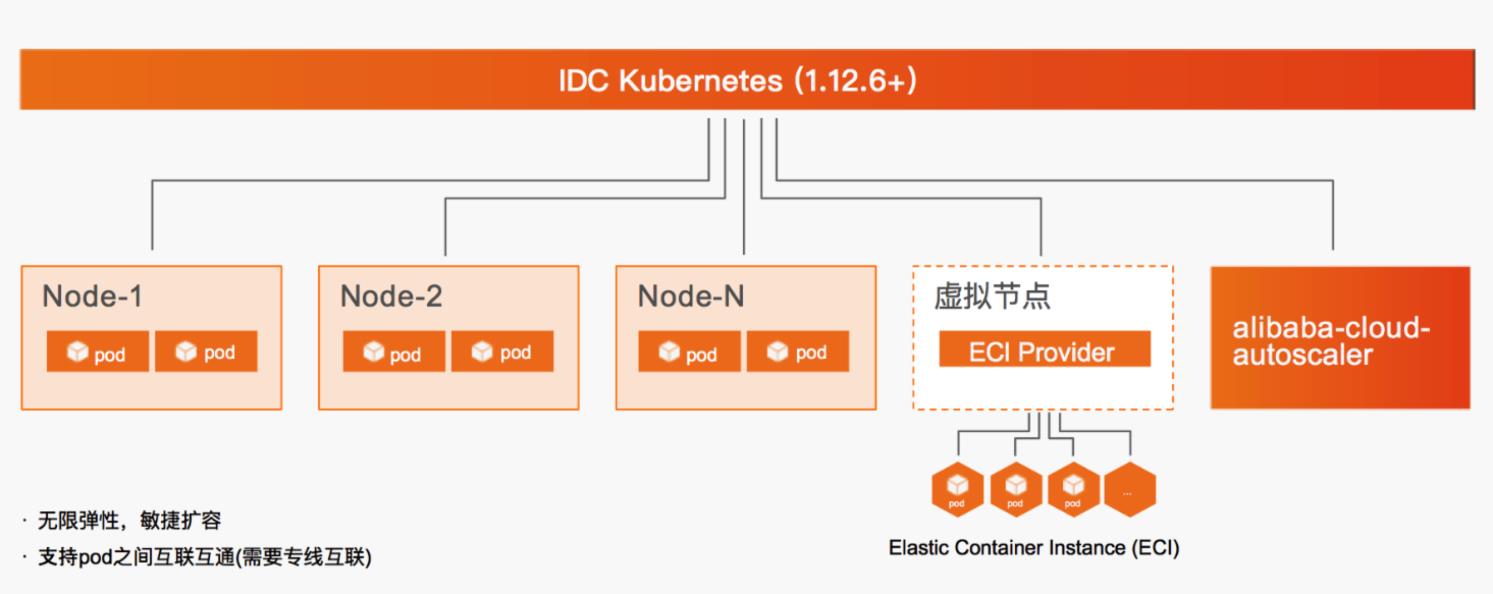

混合云自有K8S弹性使用ECI

场景描述 本文介绍线下IDC与云端通过专线构建混合云架构,自有K8S利用虚拟节点弹性调用ECI承载业务高峰期资源需求的最佳实践。 解决问题 混合云环境下,自有K8S集群注册至ACK,实现云端纳管。纳管K8S集群部署Virtual Node,使集群具备ECI资源调度能力。在以上环境中部署Web及离线作业应用,并使用ECI资源作为弹性资源池满足业务波峰需求。 产品列表 云服务器ECS 云架构设计工具CADT 专有网络VPC 访问控制RAM 云企业网CEN 弹性容器实例ECI Nat网关NAT 容器镜像服务ACR 负载均衡SLB 容器服务Kubernetes版ACK 弹性公网IPEIP

在线业务的波峰波谷弹性伸缩:如在线教育、电商等行业有着明显的波峰波谷计 算特征。使用虚拟节点可以显著减少固定资源池的维护,降低计算成本。数据计算:使用虚拟节点承载 Spark、Presto等计算场景,有效降低计算成本。CI/CD Pipeline:Jenkins、Gitlab-Runner Job任务:定时任务、AI 除了直接在阿里云容器服务 ...

计算机软件著作权登记

全新支持APP/小程序全程在线电子化登记,无纸化线上极速办理,助力APP便捷上架,最快3个工作日拿证。在线填写,系统纠错,全流程可视化,申请进度实时掌控,阿里云开启知识产权一站式专业服务。

阿里云计算机软件著作权登记,全新支持APP/小程序全程在线电子化登记,无纸化线上极速办理,助力APP便捷上架,最快3个工作日拿证。在线填写,系统纠错,全流程可视化,申请进度实时掌控,阿里云开启知识产权一站式专业服务。

资源管理

阿里云资源管理,企业级资源管理服务,使用目录、资源夹、账号、资源组分层次组织与管理您的全部资源。资源管理(Resource Management)包括资源组(Resource Group)和资源目录(Resource Directory)。资源组是在阿里云账号下进行资源分组管理的一种机制,资源组能够帮助您解决单个云账号内的资源分组和授权管理的复杂性问题。资源目录(Resource Directory)是阿里云面向企业客户提供的一套多级资源(账号)关系管理服务。

阿里云资源管理服务包含一系列支持企业IT治理的资源管理产品集合。其中主要产品为资源组和资源目录。资源管理服务支持您按照业务需要搭建适合的资源组织关系,使用目录、资源夹、账号、资源组分层次组织与管理您的全部资源。

- 产品推荐

- 这些文档可能帮助您