区块链分布式身份服务解决方案

区块链分布式身份服务解决方案提供基于区块链技术的实体身份标识及可信数据交换服务,具有分布式、多中心等特性。该服务符合 W3C DID 以及 W3C VC 规范,实体可以对数字身份进行便捷的创建、验证、管理。此外,实体之间能够进行可验证声明的颁发,用以满足复杂的场景需求。

大规模商用的溯源营销服务平台,利用区块链和物联网技术,解决了溯源信息的真实性问题.区块链溯源服务.高效、司法可信、轻量便捷的电子合同存证解决方案,保证合同真实不可篡改、具备司法效力、提高维权效率.结合区块链资产化、数字积分化的特性,对现有营销服务场景进行提升改造,结合现有热点提升营销效率.区块链积分营销...

来自:

解决方案

一站式快速开发多平台小程序

本方案使用阿里云多端低代码开发平台魔笔低代码快速搭建适配于多平台的小程序,帮助您提升开发效率、降低维护成本。

产品解决方案文档与社区权益中心定价云市场合作伙伴支持与服务了解阿里云备案控制台方案导读通过小程序开发企业移动端入口小程序搭建方案对比方案介绍方案优势方案部署方案权益一站式快速开发多平台小程序本方案使用阿里云多端低代码开发平台魔笔低代码快速搭建适配于微信、支付宝等多平台的小程序,帮助您提升开发效率、...

来自:

解决方案

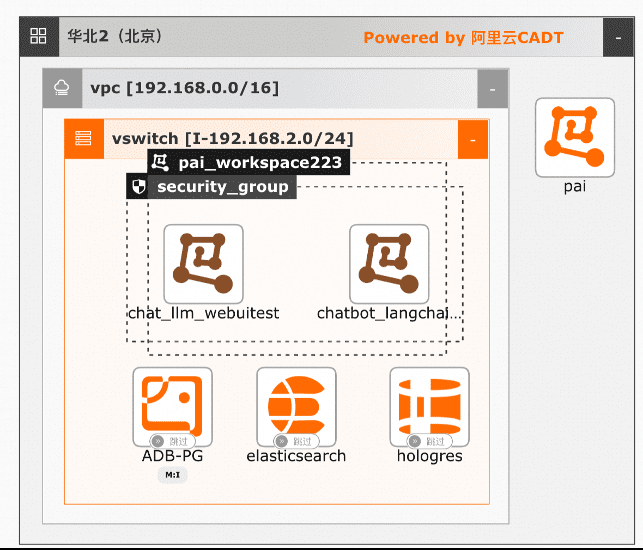

大模型RAG对话系统部署

大模型RAG对话系统最佳实践,旨在指引AI开发人员如何有效地结合LLM大语言模型的推理能力和外部知识库检索增强技术,从而显著提升对话系统的性能,使其能更加灵活地返回用户查询的内容。适用于问答、摘要生成和其他依赖外部知识的自然语言处理任务。通过该实践,您可以掌握构建一个大模型RAG对话系统的完整开发链路。

包括数据清洗(文本提取、超链替换等)和语义切块(chunk),可以通过设置 rank label参数,来控制语义切块的粒度大小,默认为 h2。本文准备了一个知识库文 档进行 mock测试,下载地址可以从前置条件中获取。步骤8 在 RAG服务的 WebUI页面的 Chat选项卡中,选择 Vector Store问答策略,即为直 接从向量数据库中召回 Top-K条...

物联网平台设备数据上云

物联网平台设备数据上云方案为企业提供海量物联网设备的数据接入与处理。提供了多种类型设备的稳定接入、安全防护、实时监控,满足企业一站式管理设备、处理数据的需求。具有高可用、高并发、低成本的优势。

产品解决方案文档与社区权益中心定价云市场合作伙伴支持与服务了解阿里云备案控制台物联网平台设备数据上云方案介绍方案优势应用场景方案部署物联网平台设备数据上云物联网平台设备数据上云方案为企业提供海量物联网设备的数据接入与处理。提供了多种类型设备的稳定接入、安全防护、实时监控,满足企业一站式管理设备、处理...

来自:

解决方案

Node.js性能平台

Node.js 性能平台(Node.js Performance Platform)是阿里云面向中大型 Node.js 应用提供性能监控、安全提醒、故障排查、性能优化等服务的整体性解决方案。凭借对 Node.js 内核深入的理解,我们提供完善的工具链和服务,协助客户主动、快速发现和定位线上问题。

凭借对 Node.js 内核深入的理解,我们提供完善的工具链和服务,协助客户主动、快速发现和定位线上问题.Node.js 性能平台.查看全部日志.查看Node.js性能平台所有相关文档.了解如何快速使用Node.js性能平台.更多问题交流讨论FAQ.来自阿里内部或客户的最佳实践.通过以应用为视角,以提供更贴合开发者和运维的使用习惯.应用视角...

来自:

云产品

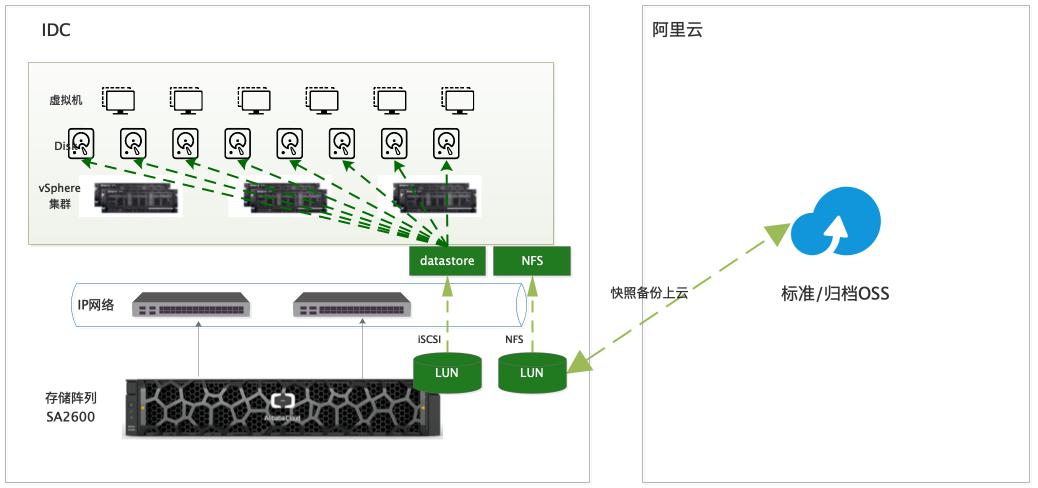

混合云存储构建VMware虚拟化平台

场景描述 本文以混合云存储阵列SA2600系统为例,介绍如 何在混合云存储环境下部署VMware虚拟化平台, 以及混合云环境下虚拟机的部署、扩容、云备份等功 能演示。 解决问题 1.如何使用混合云存储部署VMware虚拟化平台。 2.存储阵列在混合云环境下的使用,比如虚拟机部 署、扩容、云备份等。 产品列表 1.混合云存储阵列 2.对象存储OSS

混合云存储构建VMware虚拟化平台 最佳实践 业务架构图 场景描述 本文以混合云存储阵列SA2600系统为例,介绍如 何在混合云存储环境下部署VMware虚拟化平台,以及混合云环境下虚拟机的部署、扩容、云备份等功 能演示。解决问题 如有问题请使用钉钉扫码联系文档作者:1.如何使用混合云存储部署VMware虚拟化平台。2.存储阵列在...

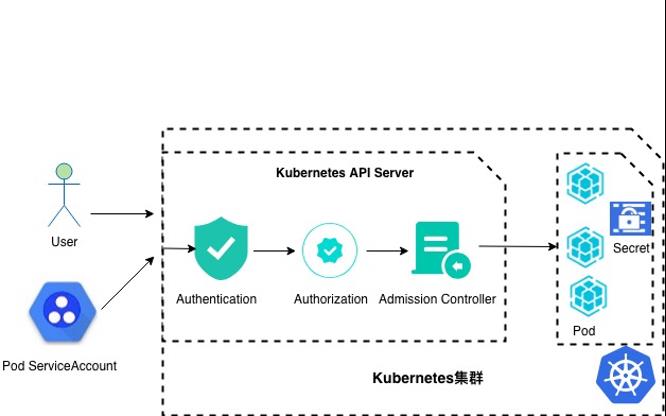

ACK容器平台集群安全控制

场景描述 本方案实践主要是通过一些实践示例来介绍 用户对于在阿里云上使用Kubernetes集群服 务的容器平台安全管控的实践验证与使用建 议。 方案优势 容器集群部署快捷 授权与安全策略配置方便 丰富的安全控制实践介绍 解决问题 容器集群API Server的安全访问控 制 容器服务多租户场景下的授权管理 容器中的敏感信息数据的存储 容器服务集群安全策略配置管理 产品列表 容器服务Kubernetes版 负载均衡SLB 专有网络VPC 访问控制RAM

ACK容器平台集群安全控制 最佳实践 部署架构 场景描述 本方案实践主要是通过一些实践示例来介 绍用户对于在阿里云上使用 Kubernetes 集群服务的容器平台安全管控的实践验证 与使用建议。方案优势 容器集群部署快捷 授权与安全策略配置方便 丰富的安全控制实践介绍 解决问题 产品列表 容器集群 API Server的安全访问控制 ...

- 产品推荐

- 这些文档可能帮助您