自建数据库迁移到云数据库

本方案介绍如何将网站的自建数据库迁移至云数据库 RDS,解决您随着业务增长可能会面临的数据库运维难题。数据库采用高可用架构,支持跨可用区容灾,给业务带来数据安全、可用性、性能和成本方面收益。方案提供了快速体验教程,模拟了数据库迁移所需的工作,帮助您快速上手。

产品解决方案文档与社区权益中心定价云市场合作伙伴支持与服务了解阿里云备案控制台方案导读背景RDS 解决的问题如何迁移到 RDS迁移前后对比优惠购买自建数据库迁移到云数据库本方案介绍如何将网站的自建数据库迁移至云数据库 RDS,解决您随着业务增长可能会面临的数据库运维难题。数据库采用高可用架构,支持跨可用区容灾,...

来自:

解决方案

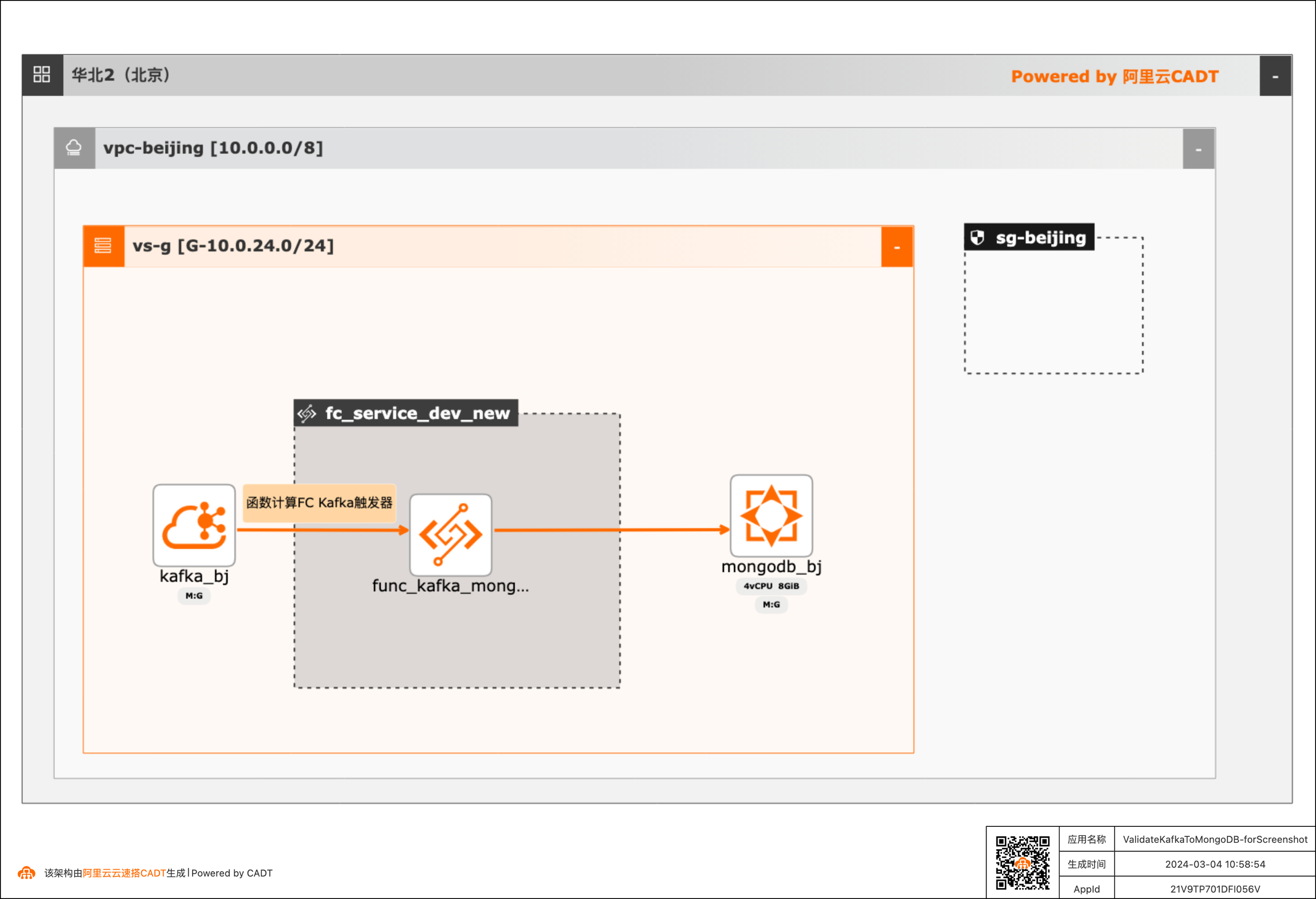

基于函数计算FC实现阿里云Kafka消息内容控制MongoDB DML操作

在大数据ETL场景,将Kafka中的消息流转到其他下游服务是很常见的场景,除了常规的消息流转外,很多场景还需要基于消息体内容做判断,然后决定下游服务做何种操作。 该方案实现了通过Kafka中消息Key的内容来判断应该对MongoDB做增、删、改的哪种DML操作。 当Kafka收到消息后,会自动触发函数计算中的函数,接收到消息,对消息内容做判断,然后再操作MongoDB。用户可以对提供的默认函数代码做修改,来满足更复杂的逻辑。 整体方案通过CADT可以一键拉起依赖的产品,并完成了大多数的配置,用户只需要到函数计算和MongoDB控制台做少量配置即可。

分区数:每个规格有默认免费赠送的分区,最少赠送 1000 分区,这里是当赠送的分区 数不够时,额外购买的设置项,根据实际情况填写。部署实例-版本:开源 Kafka 的版本,阿里云 Kafka 目前支持 2.2.0,2.6.2,这里选择 2.6.2。创建 Topic:u Topic 名称:根据实际业务自行填写。u Topic 描述:根据实际业务自行填写。u 分区...

云数据库 RDS MySQL 版

阿里云云数据库RDS MySQL是一种稳定可靠、可弹性伸缩的在线MySQL数据库服务, 提供了高可用、高可靠、高安全、易运维等一站式的数据库解决方案,帮助您免除MySQL运维的烦恼。

产品解决方案文档与社区权益中心定价云市场合作伙伴支持与服务了解阿里云备案控制台云数据库 RDS MySQL 版产品简介产品优势产品功能产品选型入门与试用技术解决方案产品定价安全合规客户案例常见问题社区云数据库 RDS MySQL 版稳定可靠、可弹性伸缩的在线 MySQL 数据库服务,帮助您免除 MySQL 运维的烦恼。立即购买免费试用...

来自:

云产品

云数据库 SelectDB 版

阿里云数据库 SelectDB 是现代化实时数据仓库 SelectDB 在阿里云上的全托管服务,内核基于业界领先的开源分析型数据库 Apache Doris 研发,由阿里云和飞轮科技联合打造。阿里云数据库 SelectDB 聚焦于满足企业级大数据分析需求,广泛应用于实时报表分析、即席多维分析、日志检索分析、数据联邦与查询加速等场景,致力于为客户提供极致性能、简单易用的数据分析服务。

产品解决方案文档与社区权益中心定价云市场合作伙伴支持与服务了解阿里云备案控制台云数据库 SelectDB 版产品简介产品优势产品功能产品选型入门与试用技术解决方案产品定价安全合规常见问题社区云数据库 SelectDB 版基于 Apache Doris 的云原生实时数据仓库,致力于为客户提供极致性能、简单易用的数据分析服务。...

来自:

云产品

数据库自动扩缩容和自动SQL优化

方案使用数据库自治服务DAS实现RDS MySQL数据库的自动扩缩容和自动SQL优化,将基于人工的手动式运维转变为基于智能的主动式持续优化,具有数据库运维成本低,服务稳定性高的优势。

产品解决方案文档与社区权益中心定价云市场合作伙伴支持与服务了解阿里云备案控制台数据库自动扩缩容和自动SQL优化方案介绍方案优势应用场景方案部署方案权益数据库自动扩缩容和自动SQL优化方案使用数据库自治服务DAS实现RDS MySQL数据库的自动扩缩容和自动SQL优化,将基于人工的手动式运维转变为基于智能的主动式持续优化...

来自:

解决方案

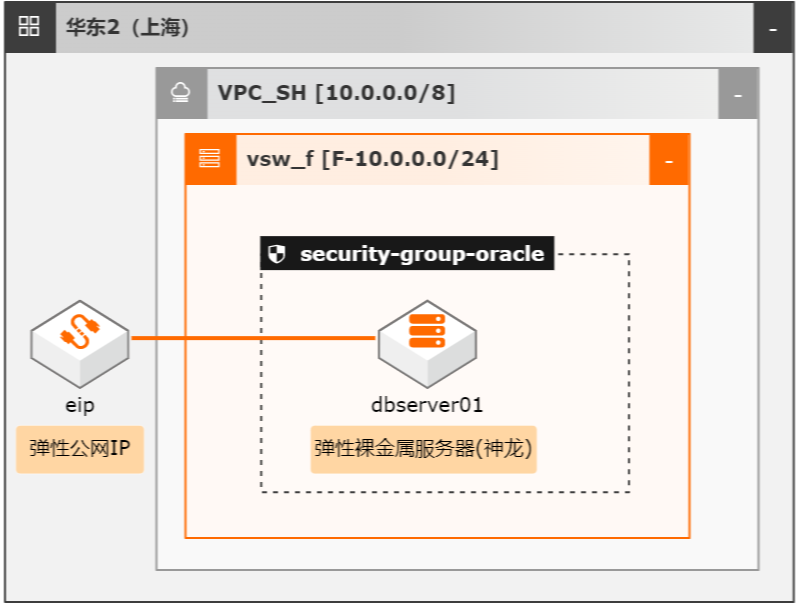

弹性裸金属自建ORACLE数据库单机版

场景描述 1.客户业务系统选型ORACLE数据库且不愿 做业务改造:由于历史原因,客户业务系统 只支持ORACLE数据库。适配开源数据库 业务改造量大,客户没有技术/时间去做改 造。 2.高性能:客户希望拥有比虚拟机更高的性能 和稳定性,以保障数据库高性能,支撑高并 发的业务系统; 3.高可用:在单机条件下,极端情况下数据库 发生宕机时,客户希望能快速拉起数据库服 务,减少停机时间; 4.数据安全性:极端情况下能找回数据。数据 备份和恢复更方便。

2.如何利用云上资源和产品优势兼顾单机数 据库的可用性;3.如何快速备份和恢复数据库数据,保证云上 数据的安全性。产品列表 最佳实践频道 阿里云最佳实践分享群 专有网络 VPC 弹性公网 IP 弹性裸金属服务器 块存储 云速搭 CADT 云服务器 ECS(产品名称)文档模板(手册名称)/文档版本信息 阿里云 弹性裸金属(神龙)自建 ...

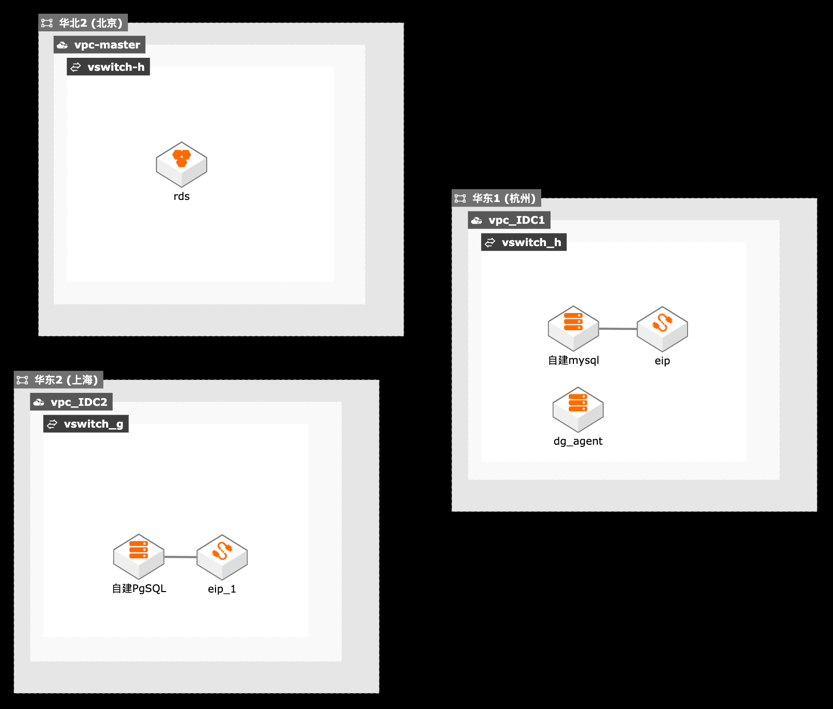

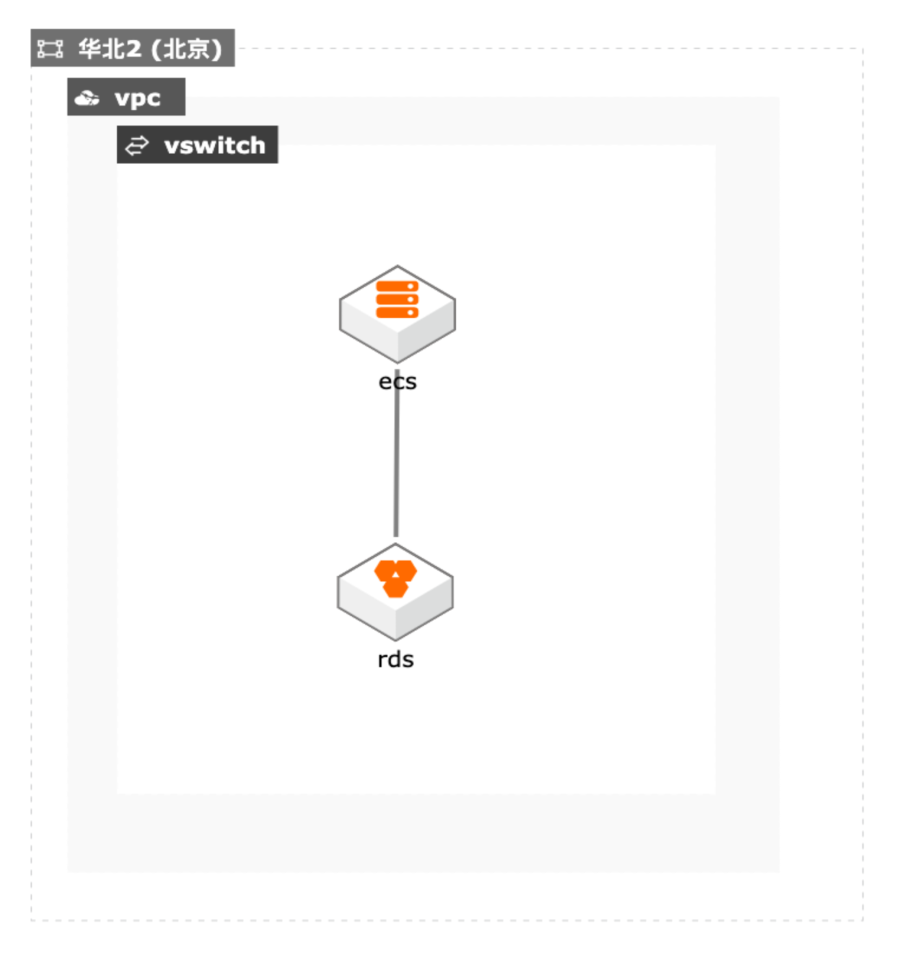

混合云数据库统一管理

本最佳实践描述在混合云场景下,用户利用数据库网关将IDC自建数据库和云上RDS实例统一管理。通过DMS管理云上RDS实例和IDC自建数据库,并通过DTS实现IDC数据库和云上RDS的数据同步, DBS将数据备份到云上

其中杭州部署 MySQL数据库和数据库网关,上海部署 PgSQL数 据库。注意:上述模板中“自建 MySQL”和“自建 PgSQL”已经和公网 IP绑定,在部署完 数据库软件后,可以解绑公网 IP。模拟仅有内网 IP的数据库服务器。步骤3 部署所有资源。单击部署资源,单击下一步,直到完成资源部署。文档版本:20201224(发布日期)8 混合云...

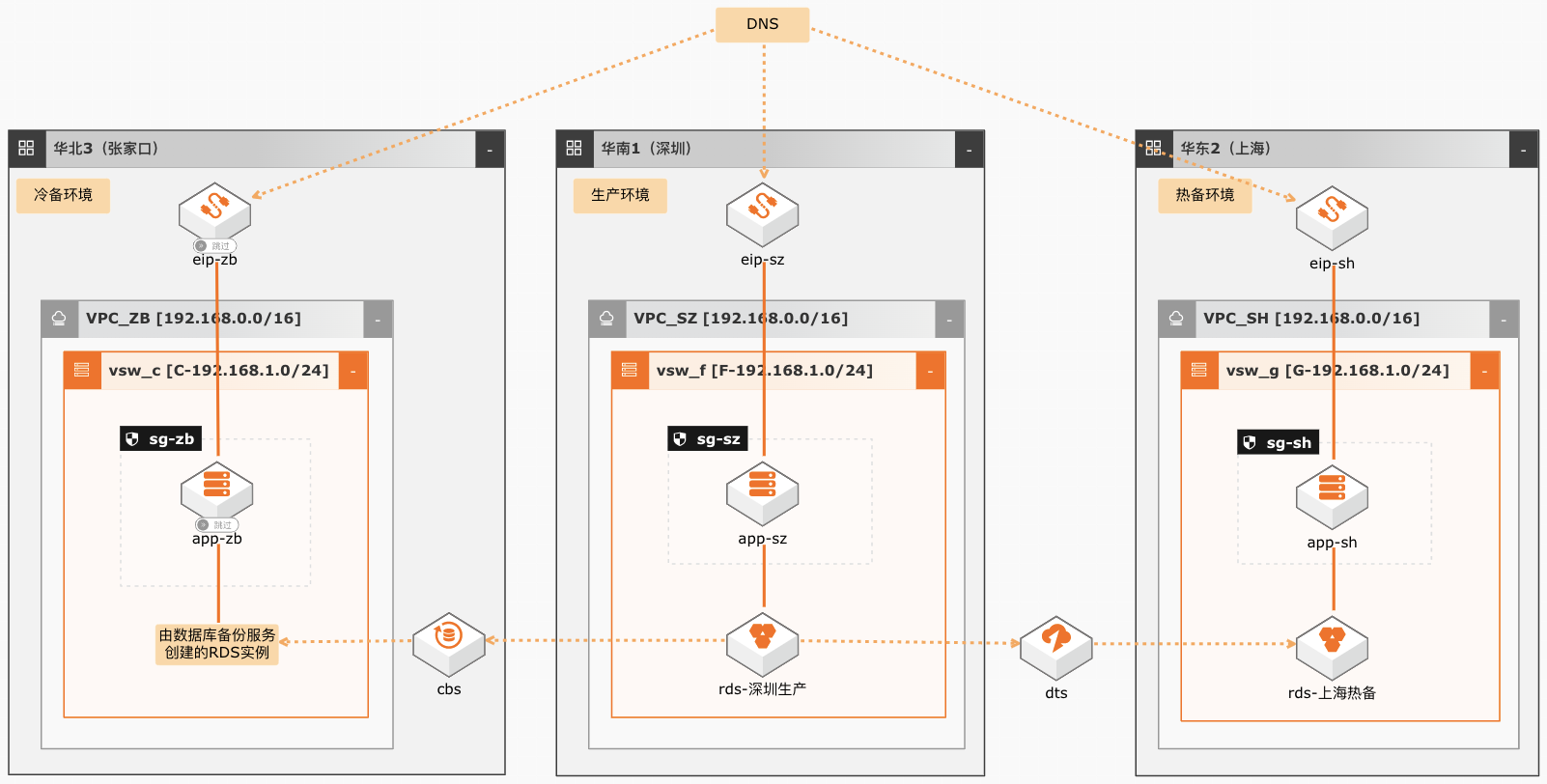

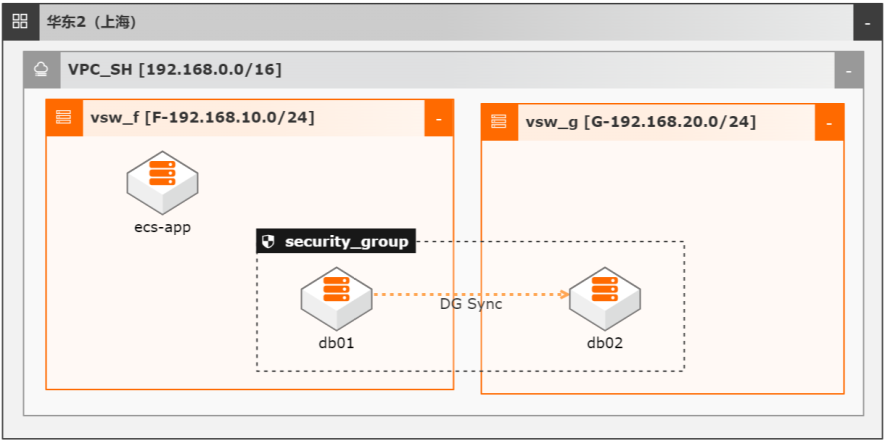

数据库异地灾备

场景描述 适用于不满足于单地域,对数据可靠性 (RPO)和服务可用性(RTO)要求更高 的,希望防范断电、断网等机房故障,抵 御地震、台风等自然灾害,具备异地容灾 备份恢复能力的客户业务场景。 解决问题 1.实时备份,RPO达到秒级 2.表级恢复,故障恢复时间大大缩短 3.长期归档,自动管理备份生命周期 4.异地灾备,构建数据库灾备中心 产品列表 专有网络VPC 云服务器ECS 弹性公网IP(EIP) 负载均衡SLB 云数据库RDSMySQL 数据库备份服务DBS 对象存储服务OSS 数据湖分析服务DLA 数据管理服务DMS 数据传输服务DTS

步骤7 完成数据库恢复配置之后,预检查将会检查所有前面的配置选项、数据库连通性、数 据库权限等内容。预检查完成后,单击立即启动。步骤8 在恢复任务列表,可以看到该恢复任务状态从初始化中,运行中,变到完成,单击管 理,可查看恢复任务详情。文档版本:20220207 84 数据库异地灾备 容灾演练 步骤9 恢复完成后,点击 ...

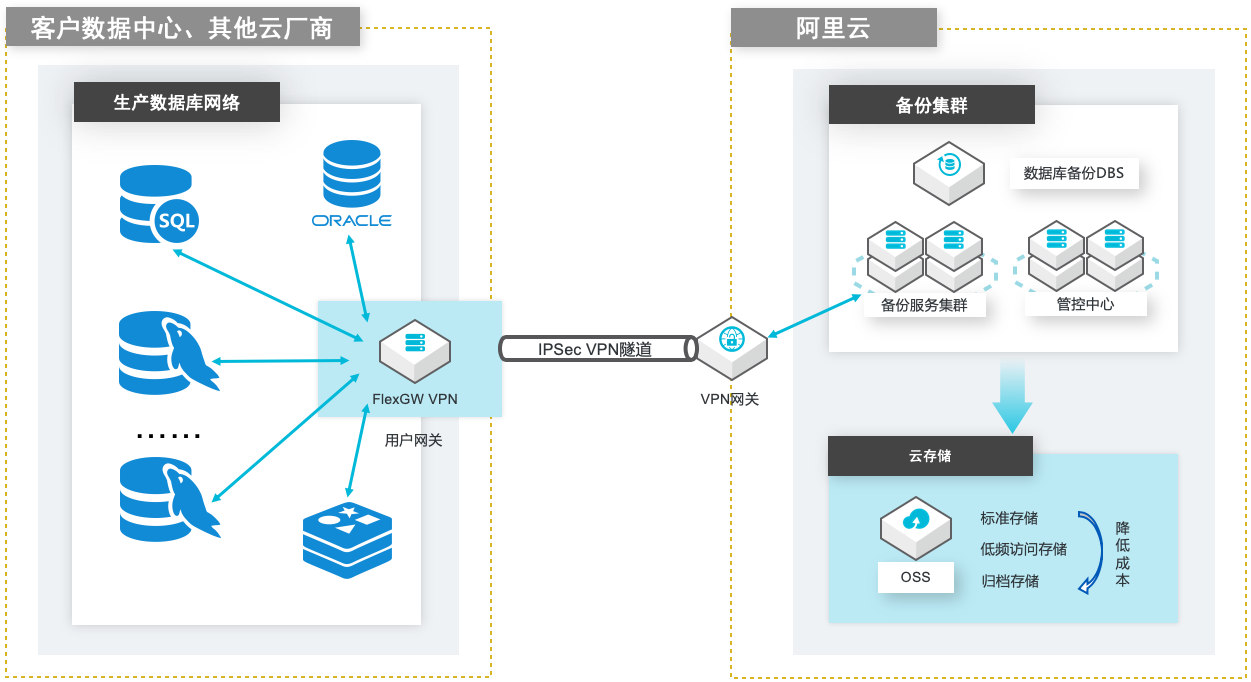

DBS通过IPSec VPN备份自建数据库

场景描述 客户业务系统部署在IDC或者公有云环境,对业 务数据有云上备份需求。在客户交流过程中,基 于数据高可用和灾备需求,要求将数据备份至阿 里云OSS的存储空间,同时备份数据流基于 IPSecVPN/专线进行安全传输。 解决的问题 自建数据库的云上/跨云备份需求 DBS提供了完善的备份机制和API OSS的分层存储机制降低备份集储存成本 基于IPSecVPN/专线进行安全传输。 产品列表 VPC,ECS,DBS,VPN网关,OSS

扩展性 除了支持备份阿里云数据库,DBS还支持将 ECS自建数据库、本地机房数 据库、其他云厂商数据库备份到阿里云上。除了支持恢复到原始数据库,DBS还支持恢复到其他环境,如本地数据库通 过 DBS备份,恢复到阿里云数据库上。文档版本:20210812 2 DBS通过 IPSec VPN备份自建数据库 前置条件 前置条件 在进行本文操作之前,...

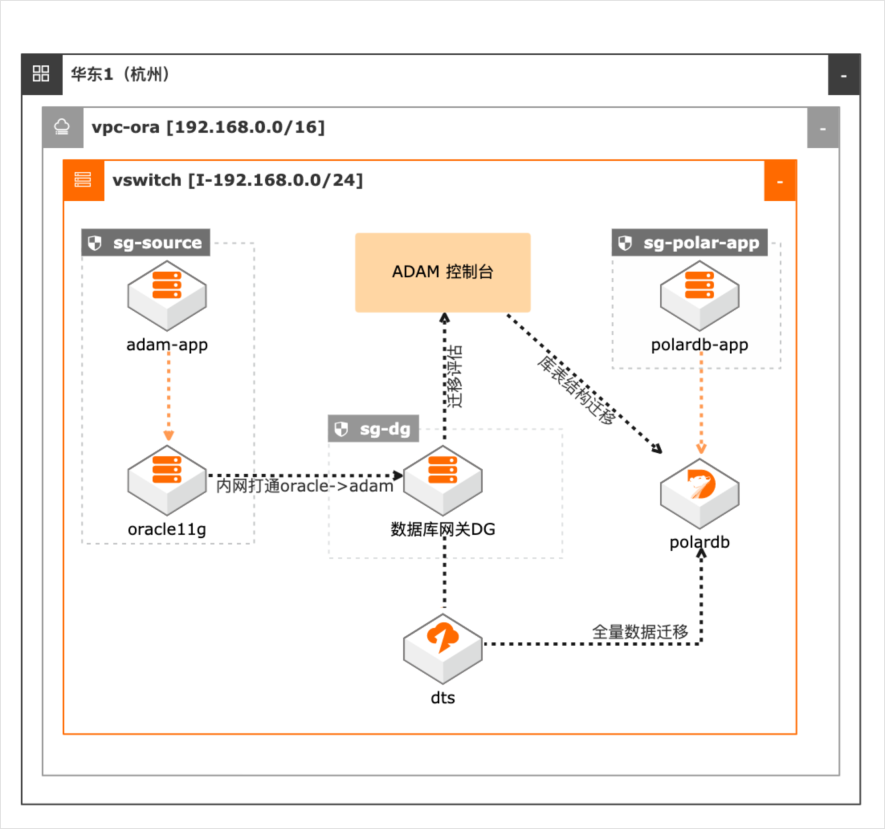

Oracle数据库与应用迁移PolarDB

场景描述 本最佳实践适用于Oracle数据库及应用迁 移到阿里云PolarDB数据库(Oracle兼容 版)。通过ADAM将Oracle数据库迁移到 PolarDB数据库,可以降低应用升级、运 维成本,同时提升系统弹性,实现数据库 及应用全栈上云。 解决问题 1.解决Oracle及其应用迁移上阿里云, 通过ADAM评估迁移工具,降低迁移 风险,提高迁移效率。 2.使用PolarDB(Oracle兼容版)数据 库,提升数据库并发读能力,降低运维 成本。 产品列表 数据库和应用迁移(ADAM) PolarDB(Oracle兼容版) 云服务器(ECS) 专有网络(VPC)

方案优势 将 Oracle数据库迁移到阿里云 PolarDB数据库降低运维成本,方便扩展,满足数 文档版本:20220210 1 Oracle数据库与应用迁移 PolarDB 最佳实践概述 据库弹性需求。迁移过程中采用 ADAM评估分析工具,在迁移前就对数据和应用改造的工作量和 风险完全掌握,便于决策并有效降低实施风险。迁移过程中通过专业工具,自动...

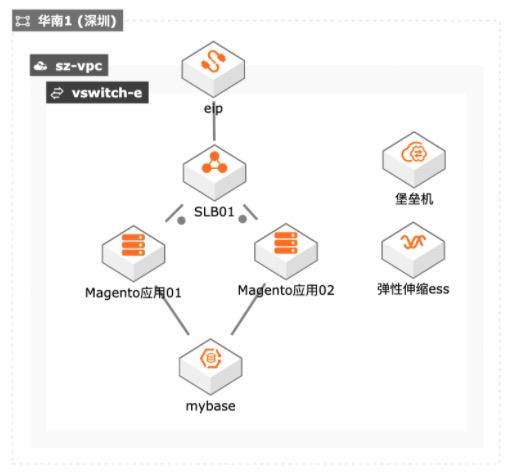

基于MyBase构建自主可控数据库和高弹性应用实践

一些企业级客户上云前,会重点关心数据库是否自主可控,包括云资源独享、自主可运维、获取OS 权限等特点,同时又要兼顾数据库合规性、安全性和高性能的要求;并力求在业务弹性下合理利用云产品降低数据和应用成本,弹性地支持业务。本实践为此类用户提供相关实践参考。

云数据库专属集群为 客户独享云资源更加安全,用户既享受到云数据库服务的便捷灵活,又满足企业 对 数 据 库 合 规 性、安 全 性 和 高 性 能 的 要 求。详见:https://www.aliyun.com/product/apsaradb/cddc 堡垒机:集中管理资产权限,全程记录操作数据,实时还原运维场景,助力企业用 户构建云上统一、安全、高效运维...

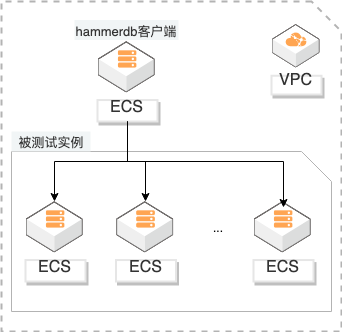

高性能数据库ECS测试及选型

概述 客户自建高性能数据库(如电商大促)在做ECS选型时,对磁盘的IO、网络的吞吐都有很大要求,为了跟接近真实业务场景,使用HammerDB选定真实业务模型测试其TPM。通过对比TPM对比ECS性价比进行选型。同时使用FIO测试磁盘性能作为参考。 适用场景 自建数据库性能测试 磁盘性能测试 ECS选型建议 技术架构 本实践方案基于如下图所示的技术架构和主要流程编写操作步骤: 方案优势 基于标准的TPC-C测试,接近真实业务场景。 提供多规格实例测试,快速选择最优性价比实例。

高性能数据库 ECS测试及选型 最佳实践 场景描述 业务架构 客户自建高性能数据库(如电商大促)在做 ECS选 型时,对磁盘的 IO、网络的吞吐都有很大要求,为 了跟接近真实业务场景,使用 HammerDB选定真 实业务模型测试其 TPM。通过对比 TPM对比 ECS 性价比进行选型。同时使用 FIO测试磁盘性能作为 参考。解决问题 自建数据库...

弹性裸金属自建ORACLE数据库双机

场景描述 1.客户业务系统选型ORACLE数据库且不愿做 业务改造:由于历史原因,客户业务系统只支持 ORACLE数据库,客户没有技术/时间去做技术栈 改造。 2.高性能:希望拥有比虚拟机更高的性能和稳定 性,以保障数据库高性能,支撑高并发的业务系 统。 3.高可用:追求数据库服务的高可用,在某一台数 据库服务器宕机时快速切换备机,实现对业务应 用的最小影响。 4.数据安全性:极端情况下能找回数据,数据备份 和恢复更方便。

验证文档内容 文档版本:20220207 I 弹性裸金属自建 ORACLE数据库双机 前言 前言 概述 本实践演示基于弹性裸金属的云上 ORACLE双机搭建最佳实践,通过 DG实现两个 可用区实例数据同步,配合 TAF技术,在主库宕机时将应用连接切换到备库,保障数 据库高可用性。应用范围 第三方云平台或线下 IDC需要使用阿里云日志服务生态。...

云数据库RDS MySQL版备份恢复

场景描述 用户数据库数据, 部分需要快速、 小颗粒度恢复、 部分需要异地备份、部分需求长期归档。 当前自建 MySQL 上建立完善的备份/恢复系统无法完美满足用户需求, 且建设/维护成本很高。 RDS 的完善的备份/恢复方案可以有效帮助到用户。 方案优势 1. 可以方便实现本地备份及库表级别快速恢复, 快速应对误操作误删除等逻辑错误, 降低业务损失。 2. 可以方便实现异地备份, 实现数据级容灾, 满足合规要求。 3. 可以方便将数据进行归档, 实现长期数据的高性价比保存方案。 4. 有效提升用户数据备份效率, 降低维护工作量。 解决问题 1. 自建数据库发生误操作时恢复复杂 2. 部分数据发生错误进行恢复时可能影响其他数据访问 3. 异地备份操作复杂 4. 长期数据保存成本较高 5. 备份恢复系统维护所需人力成本较高

数 据备份默认开启且无法关闭,您可以根据需要设置数据备份的周期、时间及保留天数。在需要恢复数据,比如需要使用真实数据进行业务测试时,可以使用数据备份恢复出 一个新的数据库实例来满足需求,同时避免污染线上数据库。2.1.备份设置 步骤1 实例页面左侧导航栏选择备份恢复,在备份设置中单击数据备份设置右边的编辑。...

云数据库RDS PostgreSQL

云数据库RDS PostgreSQL 版完全兼容开源PostgreSQL,基于云原生架构,软硬协同优化,提供稳定可靠、高性价比的数据库服务。通过丰富的插件拓展,支撑各领域场景化业务,如自研Ganos多维多模时空引擎及开源PostGIS地理信息引擎、向量引擎、时序引擎等百余款插件。

数据在用户侧加密后传入云数据库,数据库中存储的、网络中传输的、内存中缓存的的都是加密后的数据,数据拥有者以外的任何人无法接触到用户的明文数据,端到端全链路避免数据泄漏的发生.OSS云存储扩展.通过外部表的方式将OSS云存储中的CSV格式化文件当成本地数据表进行使用,支持与本地数据表进行JOIN、数据读写,借助OSS...

来自:

云产品

云原生数据库

PolarDB是阿里云自研的云原生数据库,在存储计算分离架构下,利用了软硬件结合的优势,为用户提供秒级弹性、高性能、海量存储、安全可靠的数据库服务。100%兼容MySQL和PostgreSQL生态,支持分布式扩展,高度兼容Oracle语法。

产品具有多主多写、多活容灾、HTAP特性,交易性能最高可达开源数据库的6倍,分析性能最高可达开源数据库的400倍,TCO 低于自建数据库50%.PolarDB MySQL 版.100%兼容 PostgreSQL,高度兼容Oracle语法。为用户提供快速弹性、高性能、海量存储、安全可靠的数据库服务,同时支持阿里云自研Ganos多维多模时空信息引擎及开源...

来自:

云产品

- 产品推荐

- 这些文档可能帮助您