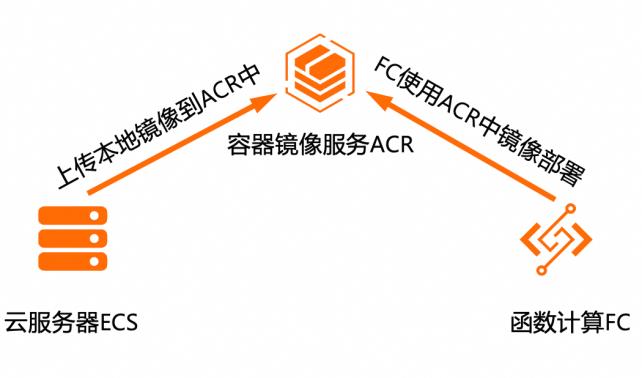

基于函数计算FC镜像部署Stable Diffusion大模型

在现代AI应用中, Stable Diffusion等模型因其强大的功能而受到关注。然而,这些模型对计算资源的高需求和复杂的运维管理成为部署时的挑战。基于函数计算FC的无服务器计算模式为这类模型的部署提供了全新的解决方案。用户只需关注模型的部署和调用逻辑,而无需关心底层的服务器配置、资源分配和扩展性等问题。函数计算FC能够自动处理函数的执行环境,包括冷启动、弹性伸缩等,确保模型能够在大规模的请求下稳定运行。

函数计算 FC能够自动处 理函数的执行环境,包括冷启动、弹性伸缩等,确 保模型能够在大规模的请求下稳定运行。应用场景 在图像生成、创意设计等领域,Stable Diffusion 等模型的部署至关重要。这些场景通常需要处理大 产品列表 量的数据,并实时生成准确的响应。通过将 SD等模 阿里云函数计算(FC)型部署在函数计算 FC上,...

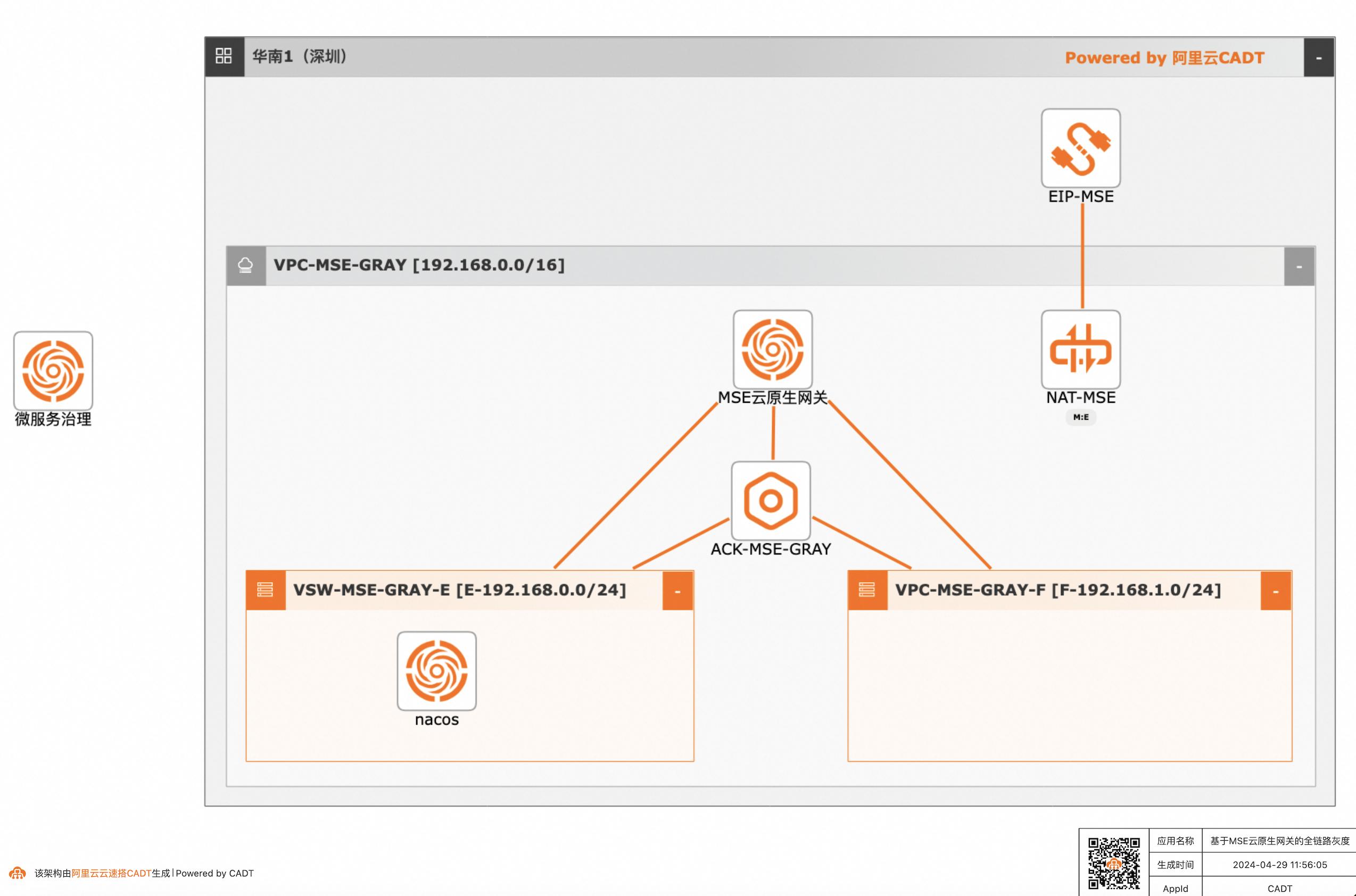

基于MSE云原生网关实现全链路灰度

在微服务场景中,应用间的调用是随机的。当您部署的Spring Cloud应用或Dubbo应用存在升级版本时,可能会导致无法将具有一定特征的流量路由到应用的目标版本。通过MSE提供的全链路灰度能力,您无需修改业务代码,就可以实现端到端的全链路流量控制。泳道可以将应用的相关版本隔离成一个独立的运行环境。通过设置泳道规则,可以将满足规则的请求流量路由到目标版本的应用。

20240429 20基于MSE云原生网关实现全链路灰度最佳实践 value:'nacos:/{nacosserveraddress}:8848' 步骤2选择创建,查看应用是否启动正常 查看容器组数量是否都是1/1。步骤3查看MSE注册中心是否正常注册 进入微服务引擎MSE>注册配置中心,点击nacos实例。文档版本:20240429 21基于MSE云原生网关实现全链路灰度最佳实践 查看...

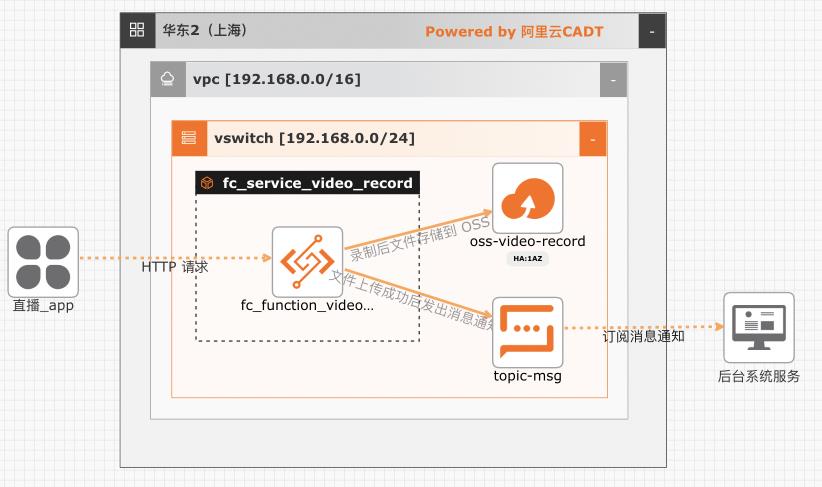

基于函数计算实现直播流录制-存储-通知

在互娱、教育、电商等行业都会有直播相关的业务,大部分场合都需要对直播相关的业务做安全审核,或者对直播的课程进行录制和转码。该方案实现了一种完全按需拉起、按量弹性、按实际使用付费的录制方案。基于本方案还可以扩展实现直播流截帧、自动化安全审核等能力

文档版本:20240422 19 基于函数计算实现自定义直播-拉流-录制-存储-通知 环境搭建 文档版本:20240422 20 基于函数计算实现自定义直播-拉流-录制-存储-通知 环境搭建 回到函数计算的服务配置页面,点刷新按钮,查看授权策略已经新增授权成功。在服务配置页面,下滑到页面下方,找到存储配置,点击展开存储配置:➢ 并点...

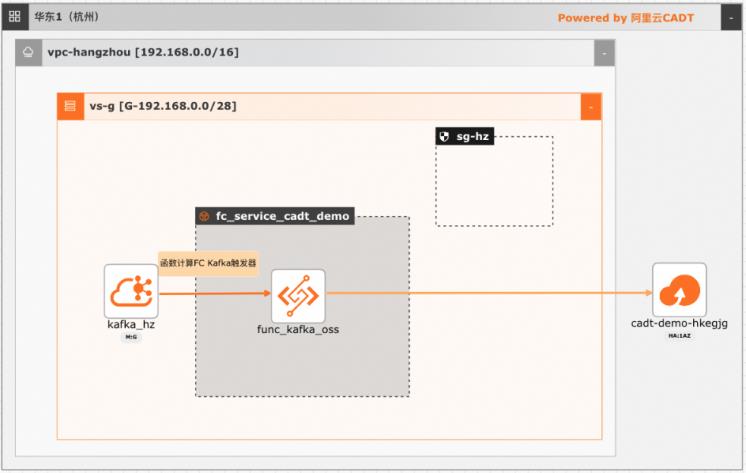

基于函数计算FC实现阿里云Kafka消息轻量级ETL处理

在大数据ETL场景,Kafka是数据的流转中心,Kafka中的数据一般是原始数据,可能存在多种数据混杂的情况,需要进一步做数据清洗后才能进行下一步的处理或者保存。利用函数计算FC,可以快速高效的搭建数据处理链路,用户只需要关注数据处理的逻辑,数据的触发,弹性伸缩,运维监控等阿里云函数计算都已经做了集成,函数计算FC也支持多种下游,OSS/数据库/消息队列/ES等都可以自定义的对接

keyword=os.environ.get('FILTER_KEYWORD')class OSSWriter:"""oss operation class"""def_init_(self,context):""":param context:fc input context,used for getting credential."""creds=context.credentials auth=oss2.StsAuth(creds.access_key_id,creds.access_key_secret,文档版本:20240408 20 基于函数计算 FC实现...

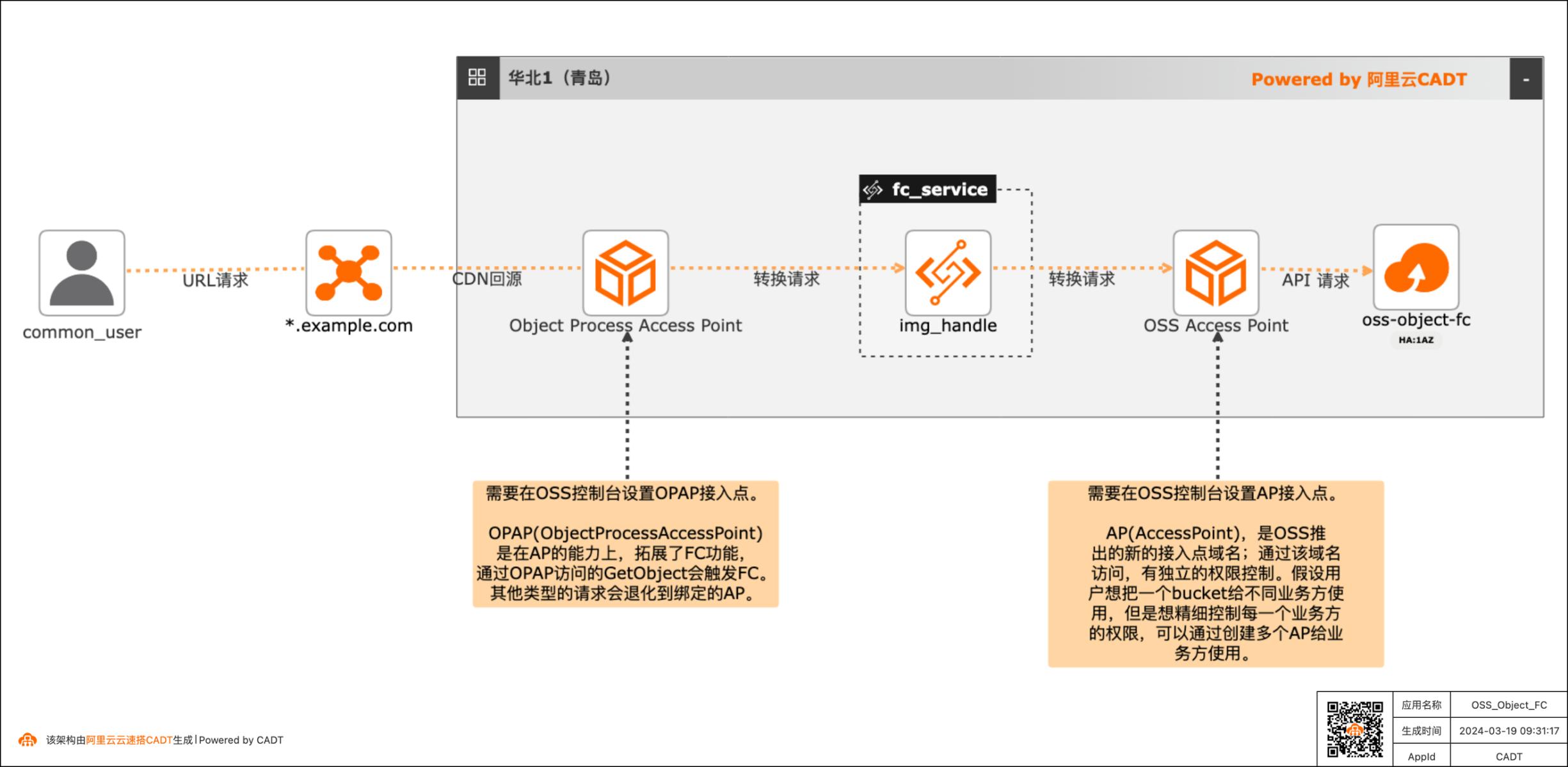

基于OSS Object FC实现非结构化文件实时处理最佳实践

现在绝大多数客户都有很多非结构化的数据存在OSS中,以图片,视频,音频居多。举一个图片处理的场景,现在各种终端种类繁多,不同的终端对图片的格式、分辨率要求也不同,所以一张图片往往会有很多张衍生图,那如果所有的衍生图都存在OSS中,那存储的成本会增加,所以就可以通过OSS Object FC的方案,在不同的终端请求时,对OSS中的原图基于终端的要求做实时处理,然后响应返回,这样OSS中只需要存储原图即可。音视频也有类似的场景。

文档版本:20240304 19基于OSSObjectFC实现非结构化文件实时处理最佳实践 场景验证 文档版本:20240304 20基于OSSObjectFC实现非结构化文件实时处理最佳实践 场景验证 4.配置函数计算FC 4.1.登录函数计算FC控制台 步骤1 CADT架构图中双击函数计算图标img_handle,点击前往控制台。4.2.部署修改图片扩展名代码 步骤1 删除Web...

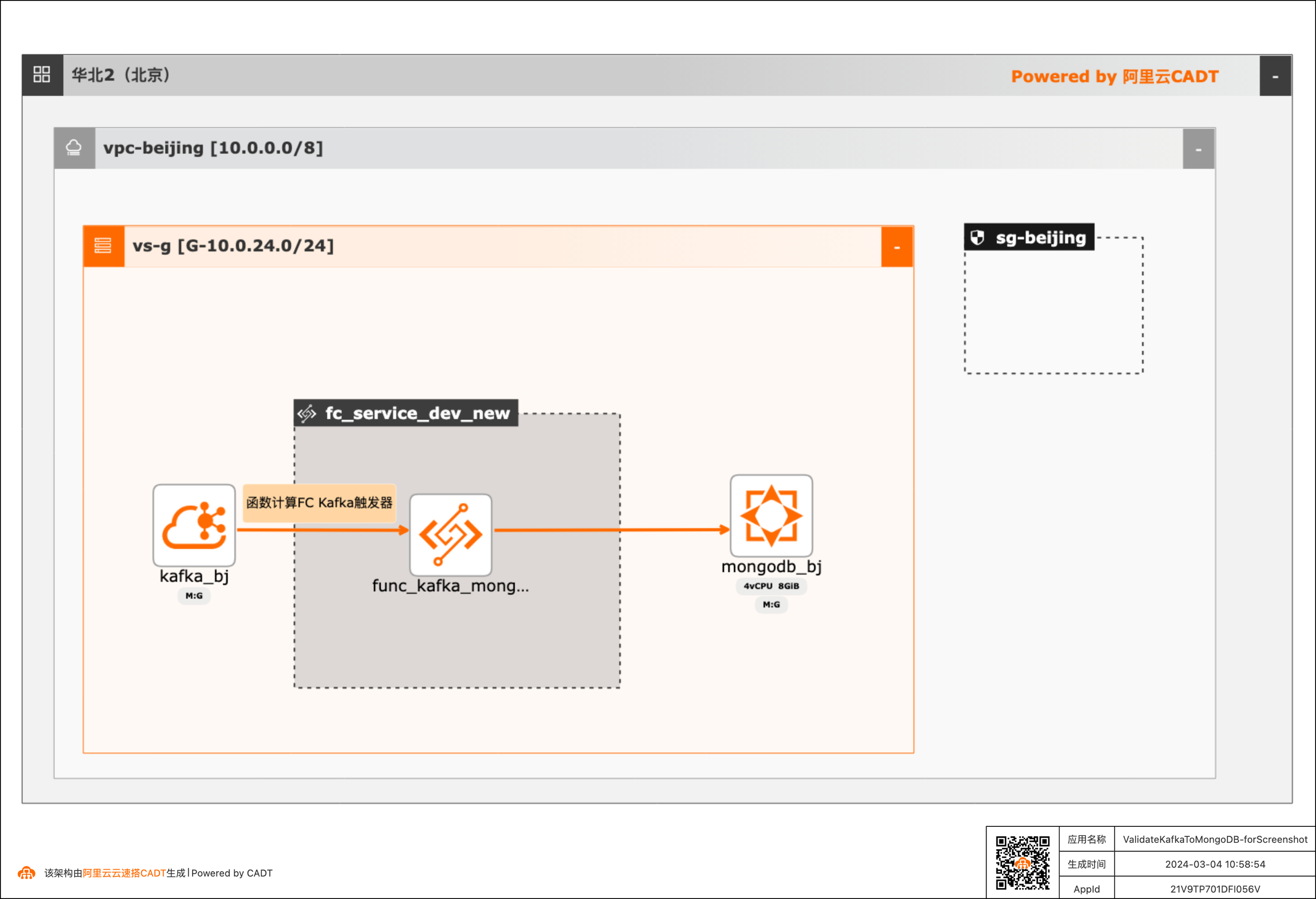

基于函数计算FC实现阿里云Kafka消息内容控制MongoDB DML操作

在大数据ETL场景,将Kafka中的消息流转到其他下游服务是很常见的场景,除了常规的消息流转外,很多场景还需要基于消息体内容做判断,然后决定下游服务做何种操作。 该方案实现了通过Kafka中消息Key的内容来判断应该对MongoDB做增、删、改的哪种DML操作。 当Kafka收到消息后,会自动触发函数计算中的函数,接收到消息,对消息内容做判断,然后再操作MongoDB。用户可以对提供的默认函数代码做修改,来满足更复杂的逻辑。 整体方案通过CADT可以一键拉起依赖的产品,并完成了大多数的配置,用户只需要到函数计算和MongoDB控制台做少量配置即可。

25 文档版本:20240304 基于函数计算 FC 实现阿里云 Kafka 消息内容控制 MongoDB DML 操作 场景验证 这里数据库名 kafkaToMongoDB 查询 中的数据 2.4.MongoDB 步骤1 双击新建的库,可以看到默认的 test 集合,通过 db.test.find().limit(20);命令可以查询 该集合的数据,可以看到目前该集合中是没有任何数据的。26 文档版本...

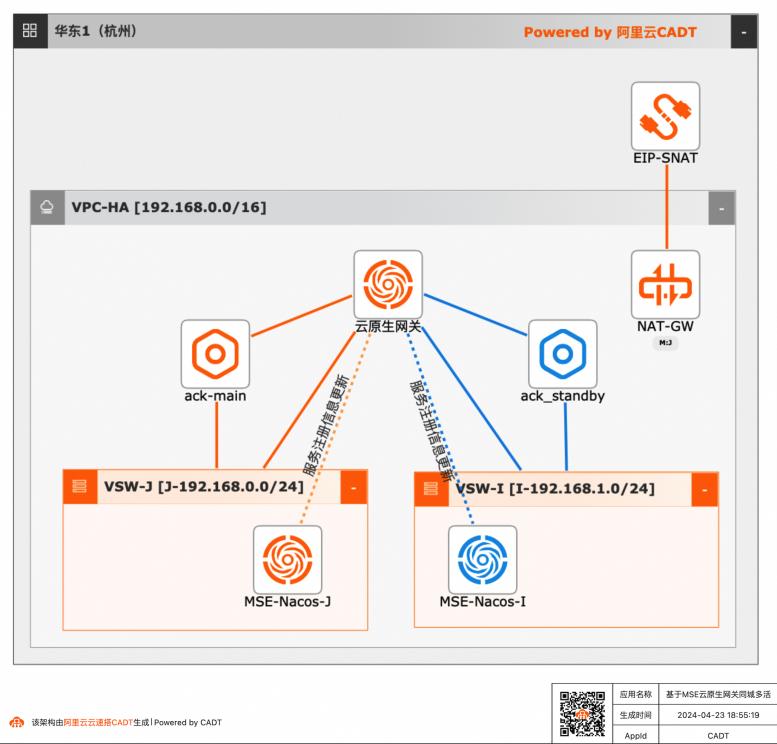

基于MSE云原生网关同城多活

借助云原生微服务MSE网关,MSE配置注册中心的同城容灾多活微服务应用。构建一个经典的微服务场景,实现同城容灾的步骤,体现云原生相关产品在用户上云,高可用同城容灾多活场景下的能力。

非对等部署状态下的全局流量负载均衡:云原生 网关对两个集群的同名服务进行合并,实现多种 负载均衡策略,可以很好的实现两个机房在非对 等部署状态下的负载均衡;流量的精细化管控:每个集群一套注册中心,保 证微服务调用在可用区内闭环。配合云原生网关 的多种流量路由能力实现蓝绿和灰度等发布策 略。产品列表 解决...

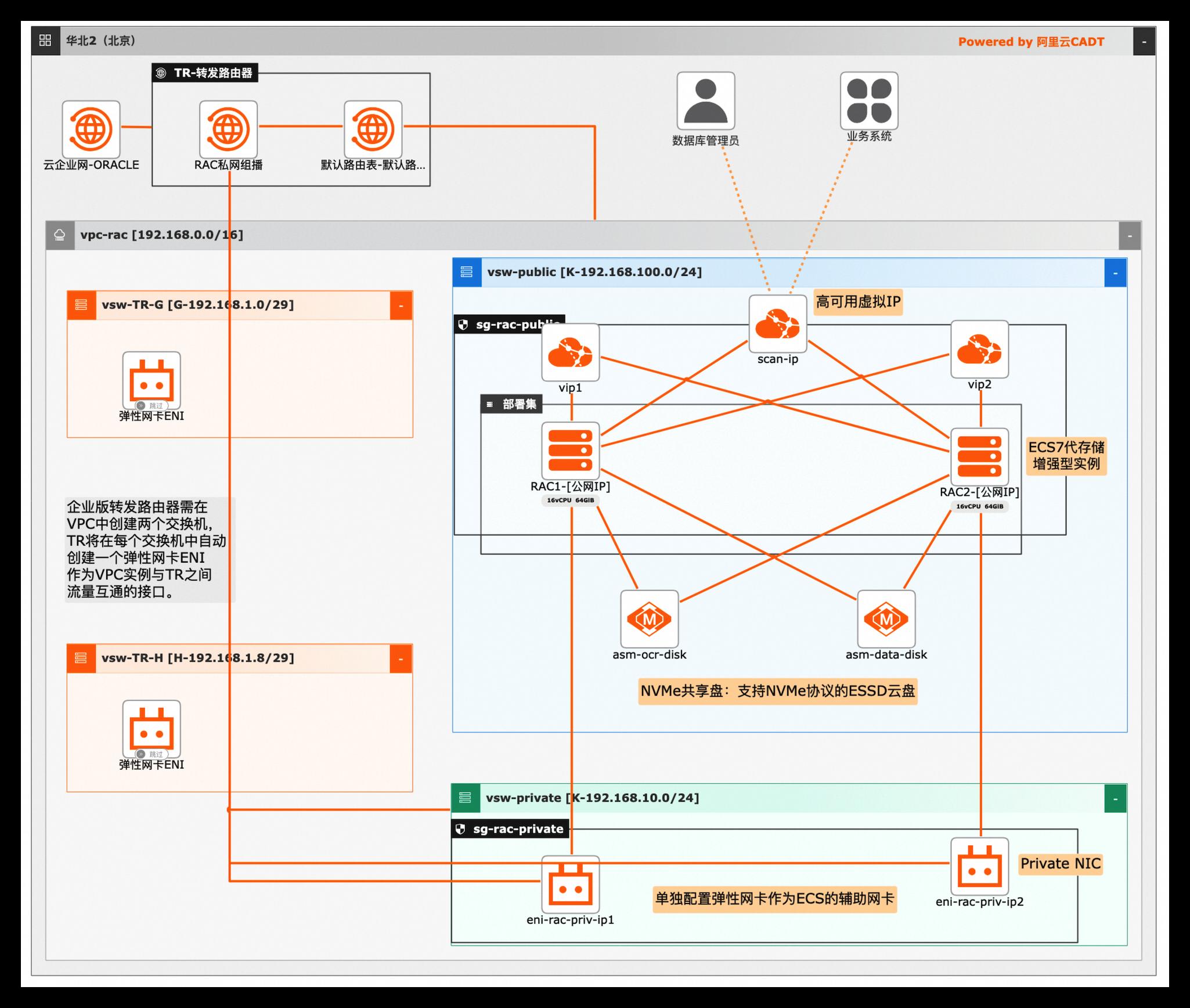

Oracle RAC 12C云上部署

Oracle RAC架构迁移上云,提供高并发,高吞吐,高安全等特性,适用于金融,电力,电信,制造业等传统客户的核心交易系统。

OracleRAC12C云上部署 最佳实践 业务架构 场景描述 OracleRAC架构迁移上云,提供高并发,高吞吐,高安全等特性,适用于金融,电力,电信,制造业等传统客户的核心交易系统。方案优势 1.基于ESSD存储NVMe协议提供的多实 例共享能力的双机集群OracleRAC架 构,为用户提供统一数据服务的同时提 供故障切换与恢复能力(FailOver...

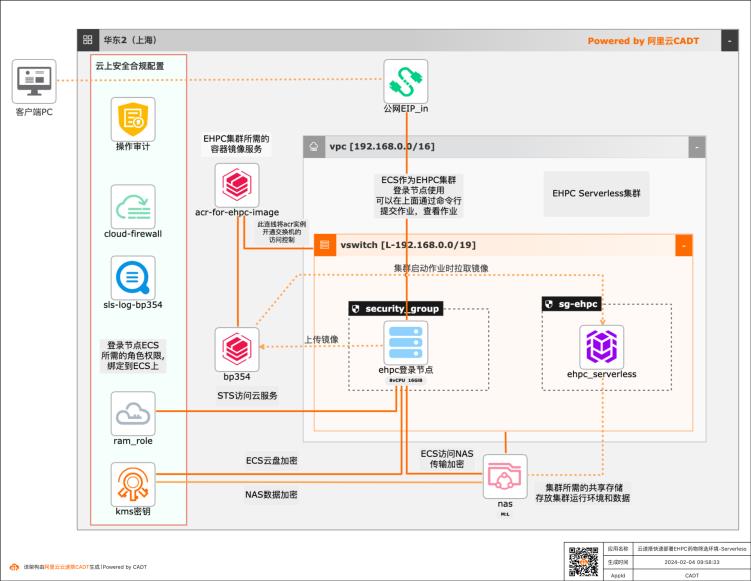

基于云速搭CADT快速构建药物筛选批量计算环境-serverless版

本方案基于云速搭 CADT提供一个快速构建云上Serverless版HPC批量计算环境的模板,针对生物制药领域的药物筛选场景,提供开箱即用的整套解决方案工具包,整个云上环境仅需1个小时即可完成自动化部署搭建。

docker 环境安装-anaconda 3环境安装以及相关软件包的安装-RFdiffusion 等开源工具所需运行环境的构建-提供ehpc命令行提交作业任务的 python脚本 总而言之,通过 CADT模板完成部署后,用户可以立即在 ehpc登录节点上运行一 个RFdiffusion的demo 作业。本文后面章节将介绍整个部署过程。产品介绍 弹性高性能计算(E-HPC):...

Alibaba Cloud Linux

Alibaba Cloud Linux 是阿里云打造的 Linux 服务器操作系统发行版。为云上应用程序提供 Linux 社区的增强功能,同时通过引入更完善的发行版质量体系,确保产品品质,提供云上最佳用户体验。

21分钟查看教程更多免费试用场景技术解决方案等保合规镜像弹性扩容方案神龙裸金属容器优化方案等保合规镜像提供等保2.0三级版的安全合规镜像满足等保 2.0 要求基于 ECS+Alibaba Cloud Linux 等保合规镜像的实例,满足国家网络安全等级保护制度 2.0 规定的要求。快速批量实现可快速实现批量机器上的操作系统等保合规。相关...

来自:

云产品

容器计算服务 ACS

容器计算服务 ACS 是以 K8s 为使用界面供给容器算力资源的云计算服务,提供符合容器规范的算力资源。

A:每个用户维度,限定最多免费创建 1 个集群,1 个集群最多可免费创建按需弹性及资源预留共计 20 vCPU,80 GiB 内存的资源总量。Q:公测是否都是免费的?A:ACS 公测期间,ACS 集群、ACS 按需弹性及资源预留免费。如果您在 ACS 集群及 Pod 创建中使用了阿里云的其他云产品资源,如 CLB 负载均衡、SLS 日志服务、NAT 网关...

来自:

云产品

云数据库 RDS MySQL 版

阿里云云数据库RDS MySQL是一种稳定可靠、可弹性伸缩的在线MySQL数据库服务, 提供了高可用、高可靠、高安全、易运维等一站式的数据库解决方案,帮助您免除MySQL运维的烦恼。

A:阿里云云计算服务(包含数据库服务)已经通过 ISO 20000、SOC、PCI-DSS、等保三级等十项安全合规认证。符合国际标准 ISO/IEC 27001。查看详情您的 RDS 问题得不到解答?来了解更多常见问题,找到您的答案社区实验与课程基于 RDS MySQLServerless 一键搭建照片管理平台MySQL 数据库 DTS 迁移上云使用 RDS MySQL 搭建个人...

来自:

云产品

RDS MySQL迁移至PolarDB MySQL版

RDS MySQL的数据可在线实时同步到PolarDB MySQL版,并且升级切换后的PolarDB集群包含源RDS实例的账号信息、数据库、IP白名单和必要的参数。

方案预估:体验本方案预计费用不超过20元(假设您选择下表中的相关规格资源,且运行时间不超过2小时,如果调整了资源规格,请以控制台显示的实际报价以及最终账单为准)方案部署一步步跟随方案教程,带你快速上手,进行方案部署。方案介绍RDS MySQL迁移至PolarDB MySQL版本架构通过一键迁移升级功能,将RDS MySQL的数据实时...

来自:

解决方案

视频直播

阿里云视频直播服务(ApsaraVideo Live)是基于领先的内容接入与分发网络和大规模分布式实时流媒体转码技术打造的直播平台,提供便捷接入、高清流畅、低延迟、高并发的音视频云高清直播直播服务。

立即购买免费试用快捷入口控制台文档APISDK价格计算器产品定价03:14视频直播介绍产品动态内容甄选新场景直播间低代码开发2023.11.10功能升级视频直播GA全球加速产品化2023.10.10新功能视频直播支持远程鉴权自助配置2023.11.20解决方案低代码电商直播间搭建2023.10.01技术前沿一文详述流媒体传输网络MediaUni2023.08.08产品...

来自:

云产品

云数据库 SelectDB 版

阿里云数据库 SelectDB 是现代化实时数据仓库 SelectDB 在阿里云上的全托管服务,内核基于业界领先的开源分析型数据库 Apache Doris 研发,由阿里云和飞轮科技联合打造。阿里云数据库 SelectDB 聚焦于满足企业级大数据分析需求,广泛应用于实时报表分析、即席多维分析、日志检索分析、数据联邦与查询加速等场景,致力于为客户提供极致性能、简单易用的数据分析服务。

立即购买最新动态阿里云 SelectDB 携手 DTS,一键实现 TP 数据实时入仓2024.03.18最新功能基于Apache Doris 2.0开发的阿里云数据库 SelectDB 3.0版发布2023.10.12最新动态阿里云数据库 SelectDB 版支持云原生存算分离架构2023.08.20开发参考如何通过Stream Load导入数据至云数据库 SelectDB 版实例中2023.08.20开发参考如何...

来自:

云产品

Flink+Hologres搭建实时数仓

Flink+Hologres搭建实时数仓解决方案将Hologres与Flink深度集成,提供一体化的实时数仓联合解决方案,实现了数仓分层之间实时数据的高效流动,解决实时数仓分层问题。

方案预估:体验本方案预计费用不超过35元(假设您选择的是本方案示例的资源规格,且资源运行时间不超过1.5小时,数据源3张表约20条数据。具体价格与您选择的资源规格、数据量、运行时长等有关,请以控制台显示的实际报价以及最终账单为准)方案部署一步步跟随方案教程,带你快速上手,进行方案部署。方案介绍Flink+Hologres...

来自:

解决方案

- 产品推荐

- 这些文档可能帮助您