MongoDB Advance自动分片

以1000W级数据做测试

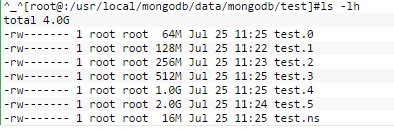

不分片的情况下,插入1000W条数据到一个数据库。

数据存储情况如下:

那要如何进行自动分片配置?

-

喜欢技术,喜欢努力的人

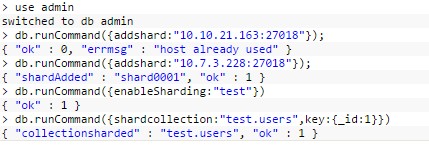

下面进行自动分片配置:

这里我们选择两台Server做测试

测试机IP为:

10.X.X.163

10.X.X.228

分别在163,228服务器上启动Shardsvr进程

[root@:/usr/local/mongodb/bin]#cat runServerShard.sh

./mongod --shardsvr -dbpath=../data/mongodb --logpath=../data/shardsvr_logs.txt --logappend --fork

在163服务器上启动configsvr 和 mongos路由进程(下面的27019为configsvr的ip,mongos的ip请到log里面去看)

[root@localhost bin]# cat runServerConfig.sh

./mongod --configsvr --dbpath=../data/mongodb/config_db/ --logpath=../data/mongodb/log/configsvr_logs.txt --logappend --fork

[root@localhost bin]# cat runServerMongos.sh

./mongos --configdb 10.10.21.163:27019 --logpath=../data/mongodb/log/mongos_logs.txt --logappend --fork

查看下是否都启动成功:

[root@localhost bin]# ps -ef | grep 'mongo'

root 17939 1 2 18:47 ? 00:01:26 ./mongod --shardsvr -dbpath=../data/mongodb --logpath=../data/shardsvr_logs.txt --logappend --fork

root 18250 1 0 19:05 ? 00:00:00 ./mongod --configsvr --dbpath=../data/mongodb/config_db/ --logpath=../data/mongodb/log/configsvr_logs.txt --logappend --fork

root 18290 1 12 19:08 ? 00:03:35 ./mongos --configdb 10.10.21.163:27019 --logpath=../data/mongodb/log/mongos_logs.txt --logappend --fork

向mongos进程进行插入1000W数据

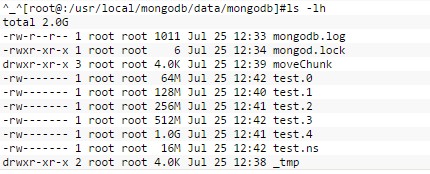

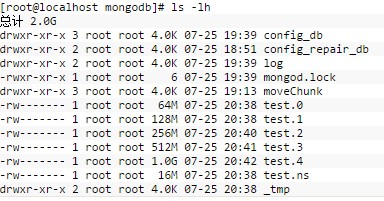

来看下数据的大小:

163:

228:

自动分片成2G。2019-07-17 18:43:56赞同 展开评论 打赏

版权声明:本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《阿里云开发者社区用户服务协议》和《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。