Java有自己提供的序列化机制,而我们的Hadoop也提供了自己的序列化机制,二者究竟有什么差异呢?为什么Hadoop要重新设计自己的序列化体系?序列化大数据对象的过程,Writable接口底层源码实现。

首先我们先了解一下什么是序列化,为什么需要序列化?

1、序列化机制Serialization

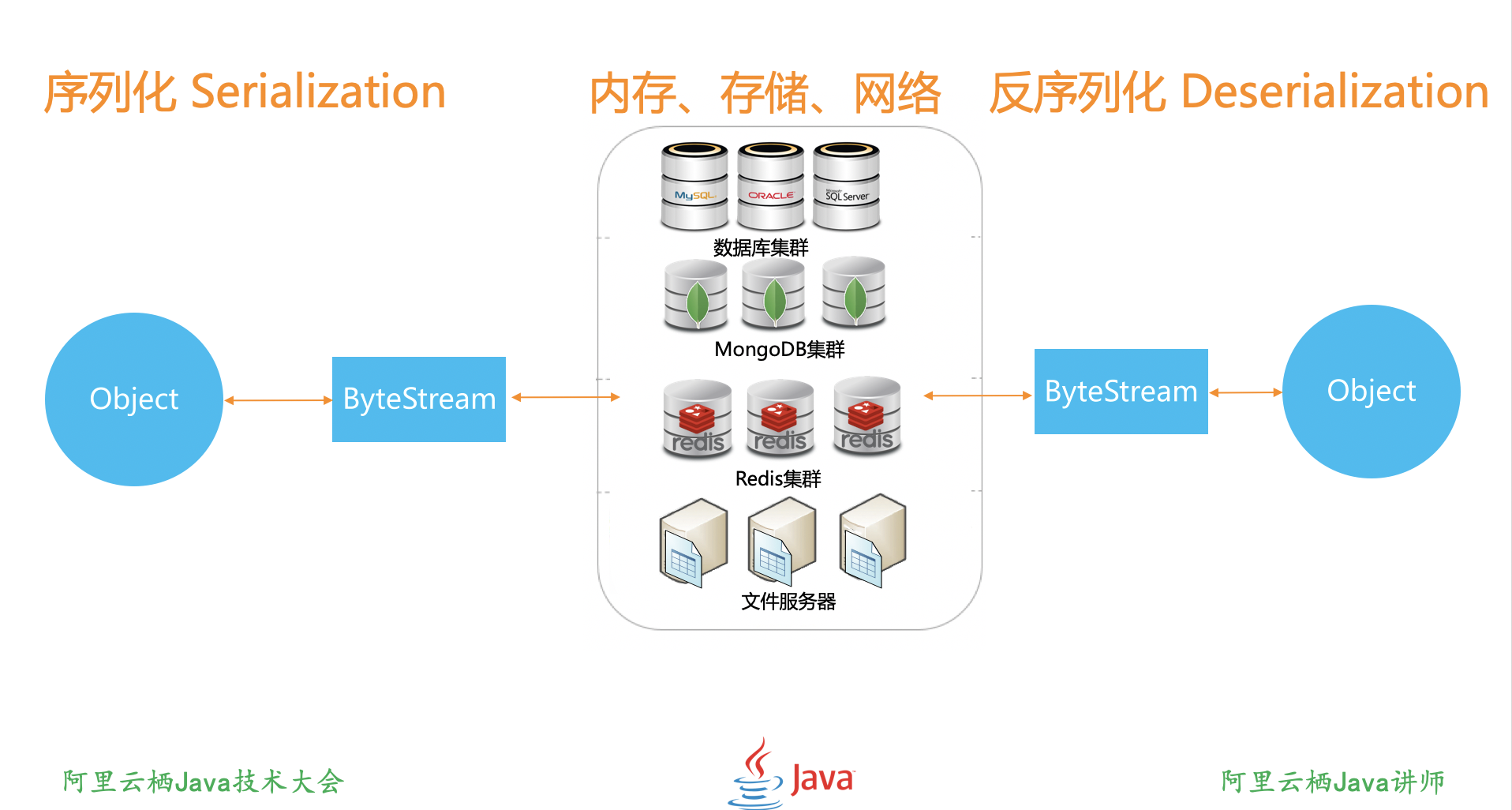

序列化Serialization,是将结构化对象转换为字节流以便通过网络传输或写入持久存储的过程。 中文也有翻译为:串行化。

反序列化deSerialization相反,是将字节流转换回一系列结构化对象的相反过程。 序列化用于分布式数据处理的两个截然不同的领域:进程间通信和持久存储。

2、Java序列化

Java对象序列化JDK 1.1引入,将Java对象转换为用于存储或传输的字节数组的机制,这样所述字节数组可以再转换回Java对象。Java提供了ObjectInputStream / ObjectOutputStream类,普通对象实现Serializable来支持序列化。

简单的订单Order对象序列化代码如下:

Order order = new Order("iPhone 8 X", 8888);

try {

FileOutputStream fileOut = new FileOutputStream("1.data");

ObjectOutputStream outObj = new ObjectOutputStream(fileOut);

outObj.writeObject(order);

outObj.close();

System.out.println("Objects were serialized!");

} catch (IOException e) {

e.printStackTrace();

}3、Hadoop序列化机制需求

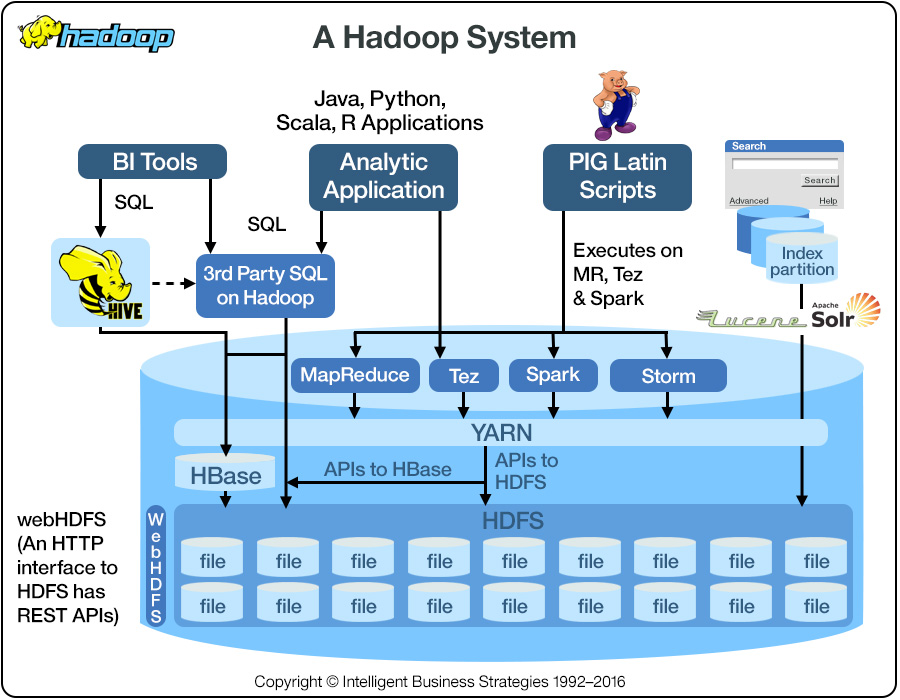

Doug Cutting决定重写Hadoop的序列化机制,大数据平台Hadoop数据传输有自己的特殊需求,大文件,大对象,而不希望依赖于Java语言。

设计的目标:

- Compact:压缩.

- Fast: 快速serialization and deserilization.

- Extensible: 可扩展

- Interoperable:互操作

所以大数据Hadoop没有使用Java Serialization,而是编写了自己的序列化框架。 Java序列化的主要问题是它将被序列化的每个对象的类名写入流中,该类的每个后续实例包含对第一个的5字节引用,而不是类名。

序列化过程除了减少Stream流的有效带宽之外,这还会导致随机访问以及序列化流中记录的排序问题。因此,Hadoop序列化不会编写类名或必需的引用,并假设客户端知道期望的类型。

Java Serialization还为每个反序列化的对象创建一个新对象。实现Hadoop序列化的Hadoop Writable可以重用。因此,有助于提高MapReduce的性能,从而对数十亿条记录进行逐步序列化和反序列化。

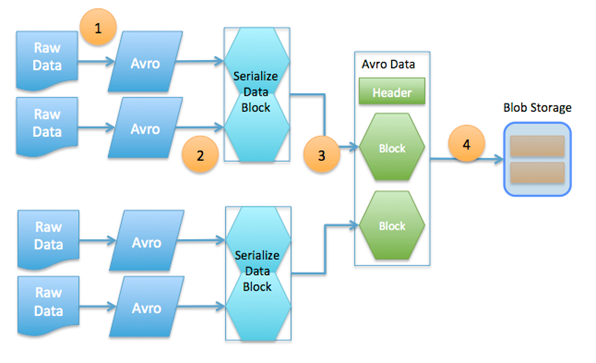

4、Avro大数据序列化框架源码

Avro适用于Hadoop,因为它以不同的方式接近序列化。客户端和服务器交换描述数据流的方案。这有助于使其快速,紧凑,并且重要的是使得更容易将语言混合在一起。

5、核心接口Writable

因此,Avro为来大数据定义了一种简化的高性能序列化格式,自己定义了Writable接口,一种用于客户端和服务器通信序列化流的协议,可以在在文件中紧凑地保存数据的方法。

Writable接口有两个方法——一个用于写Write,一个用于读Read。写入方法将其状态写入DataOutput二进制流,读取方法从DataInput二进制流读取其状态。保证高效处理大数据二进制流。

Writable的接口的源代码如下:

package org.apache.hadoop.io;

import java.io.DataOutput;

import java.io.DataInput;

import java.io.IOException;

public interface Writable {

void write(DataOutput out) throws IOException;

void readFields(DataInput in) throws IOException;

}序列化实现代码

public static byte[] serialize(Writable writable) throws IOException {

ByteArrayOutputStream outStream = new ByteArrayOutputStream();

DataOutputStream dataOut = new DataOutputStream(outStream);

writable.write(dataOut);

dataOut.close();

return outStream.toByteArray();

}反序列化实现代码

public static byte[] deserialize(Writable writable, byte[] bytes)

throws IOException {

ByteArrayInputStream inStream = new ByteArrayInputStream(bytes);

DataInputStream dataIn = new DataInputStream(inStream);

writable.readFields(dataIn);

dataIn.close();

return bytes;

}6、Hadoop 整数序列化过程

首先,通过在IntWritable类中包装一个整数值来实例化该类。

然后,实例化ByteArrayOutputStream类。

此外,实例化DataOutputStream类,然后将ByteArrayOutputStream类的对象传递给它。

此外,使用write()方法序列化IntWritable对象中的整数值。此外,确保在使用此方法时需要DataOutputStream类的对象。

最终,我们称为serialize的数据将存储在字节数组对象中,并且在实例化时,数据将作为参数传递给DataOutputStream类。

7、Hadoop反序列化过程

对于反序列化,首先通过在IntWritable类中包装一个整数值来实例化该类。

然后实例化ByteArrayOutputStream类。

此外,实例化DataOutputStream类,并将ByteArrayOutputStream类的对象传递给它。

然后,使用IntWritable类的readFields()方法,反序列化DataInputStream对象中的数据。

这样,反序列化的数据将存储在IntWritable类的对象中。使用这个类的get()方法,我们可以检索这个数据。

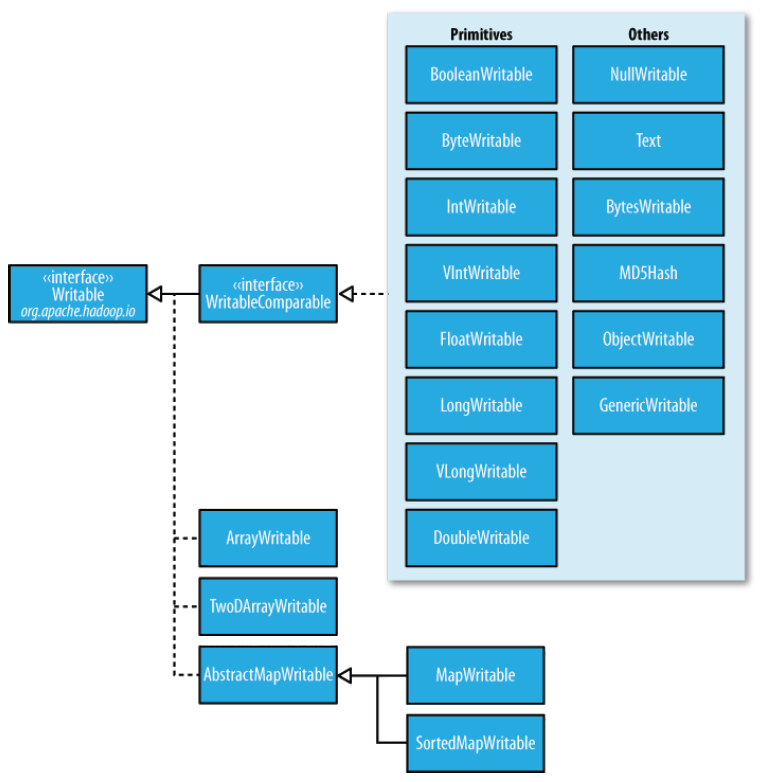

Writable针对不同类型,基本类型和引用类型都提供了自己的封装实现。继承关系如下图所示:

8、总结

Hadoop为来更高效的数据传输,自己定义了序列化机制,并且Avro只是大数据分布式架构的RPC传输。

本质上Avro降低了序列化和反序列化对象创建的开销,而且数据精简更加高效。

当然也有其局限性,比如Key是字符串类型。

Avro支持二进制和JSON格式。可以根据需要作出选择。