Flink入坑指南系列文章,从实际例子入手,一步步引导用户零基础入门实时计算/Flink,并成长为使用Flink的高阶用户。本文属个人原创,仅做技术交流之用,笔者才疏学浅,如有错误,欢迎指正。转载请注明出处,侵权必究。

从一个需求开始

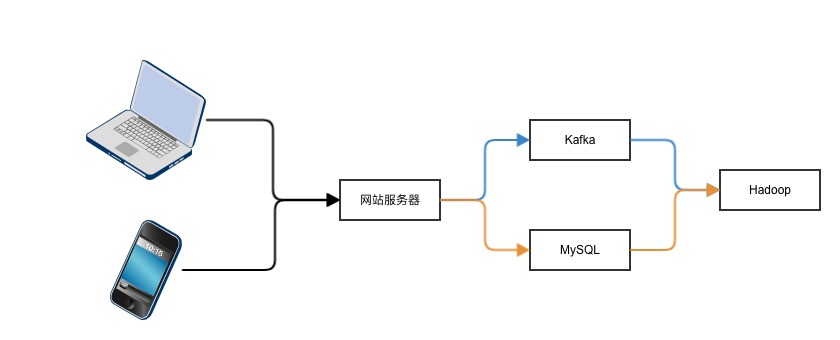

小明是一个电商平台的数据开发工程师,在其公司的电商平台上,分了很多类目,每个类目有很多店铺。整个公司的数据链路如下:

- 蓝色链路为日志点击链路,每次用户从手机端/PC端发起的浏览网页请求,都会被发送到kafka里,然后被持久化到HDFS上,供数据分析。

- 黄色链路交易链路,每次用户下单交易都会进入MySQL业务库。每天凌晨,MySQL库的数据都会被同步到Hadoop中。

- Hadoop的HDFS上,保存了该公司产生的所有数据,包括交易数据和点击数据。

在很长一段时间内,小明老板每天早上都会看一下整个平台业务运营报表,相关指标包括:

- 上一天的全网成交额

- 上一天的成交额Top10的店铺

- 上一天的成交额Top10的类目

- 上一天的成交额Top10的商品

- 上一天浏览量/点击量/加购量/成交量最高的商品

...

突然有一天,老板给小明提了个需求:作为一个正在成长为国际巨头的电商平台,不能满足与一天出一次报表,老板要能看到平台的实时全网成交额等所有指标。面对这个突如其来的需求,小明想了一下,要实现老板理想中的效果,用现有系统,竟束手无策。

作为一个正在成长为国际电商巨头的平台,每天交易量有上百万,点击/浏览/架购等数据,更是每天数十亿条。把这些数据全量存入MySQL等关系型数据库中,写RPS太高,并且对这么大量的数据进行复杂分析操作,数据库也扛不住。如果用Hbase等NO SQL系统,写入RPS可达标,但是HBase不具备复杂分析能力。

正在小明绞尽脑汁出方案的时候,突然想到了实时计算/Flink这个产品/系统。Flink的特点:

- 处理大/超大数据量

- 延时低,可达ms级的延时,完全满足业务需求

- 使用简单,完善的SQL支持,上手快

想到这里,小明毫不犹豫的开通了他的第一个实时计算/Flink集群。

入坑第一步 - 明确需求

调研实时计算/Flink过程中,小明先确定了几个要做的需求:

- 全网成交额

- 当天成交额Top10的店铺

- 当天成交额Top10的类目

- 当天成交额Top10的商品

- 当天浏览量/点击量/加购量/成交量Top10的商品

入坑第二步 - 确定系统架构

Flink是个计算引擎,本身并不存储数据!Flink是个计算引擎,本身并不存储数据!Flink是个计算引擎,本身并不存储数据! 重要的事情说三遍。

因此用户需要定义Flink的上下游系统:

- 上游:数据源,Flink进行计算的数据来源,一般为数据通道类系统,比如Kafka等开源系统,或者SLS/Datahub/MQ等阿里云上产品。实时计算产品目前支持10+上下游数据源

- 下游:数据存储,Flink计算完成的数据,需要写到哪个系统中,可以是数据通道类系统,也可以是数据库(比如MySQL等系统)

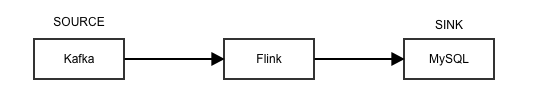

小明转念一想,假设Kafka中有所有需要计算的数据,经过Flink计算之后的结果要展示给老板,那么结果放到MySQL里比较合适。当然Hbase/Redis/Mongo等其他存储也可以做为Flink的输出。

因此满足小明需求的系统架构如下:

相关知识点:

- Flink本身是个计算引擎,不存储数据,因此使用前需要确定其数据的输入(SOURCE)/输出(SINK)系统。

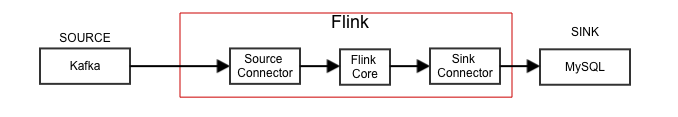

- Flink__内部__通过Connector这个模块,读取/写入外部数据,架构如下:

红色方框内部为Flink引擎的所有模块,Flink通过Source/Sink Connector来读取上游/下游系统的数据。

目前

-

实时计算产品目前支持的Connector类型及相关文档:

- 使用实时计算/Flink时,会创建源表和结果表,这写建表语句会真的在对应的系统上创建一张表么?不会

实时计算/Flink中所谓的建表,都是逻辑表,目的仅是让Flink作业知道上下游的数据结构。并不会真的在上下游系统建表。并且要注意的是,写Flink作业时,作业中用到的各系统的topic或表等,必须要提前准备好。 - 为什么Flink中,流数据计算能用表来表示,请参考Flink Commiter 金竹的精彩文章《Apache Flink 漫谈系列 - 流表对偶(duality)性》