论文动机

目标追踪是视频分析的基本任务,比目标识别更为复杂:目标追踪可以把每一帧看作单独的图片,再进行识别,但目标追踪不会这样做,因为没有考虑视频帧之间的冗余信息,效率低且慢。

目标追踪一直有两大阵营,CF 相关滤波和 CNN,当然也可以 CF+CNN 融合。

本文基于以下动机:

1. 物体运动时,大部分时间运动平缓,外观改变较慢。但是对于偶然发生的剧烈运动,需要复杂信息处理,需要单独验证。

2. CV 领域已经普及多线程计算,尤其 SLAM(Simultaneous localization and mapping、同步定位于地图构建)领域。PTAM 算法的一个关键观点是每一帧不是有必要构建地图。对于目标追踪而言,每一帧图片也不需要单独的验证。

3. tracking performance 和 efficiency 之间需要达到一种平衡。

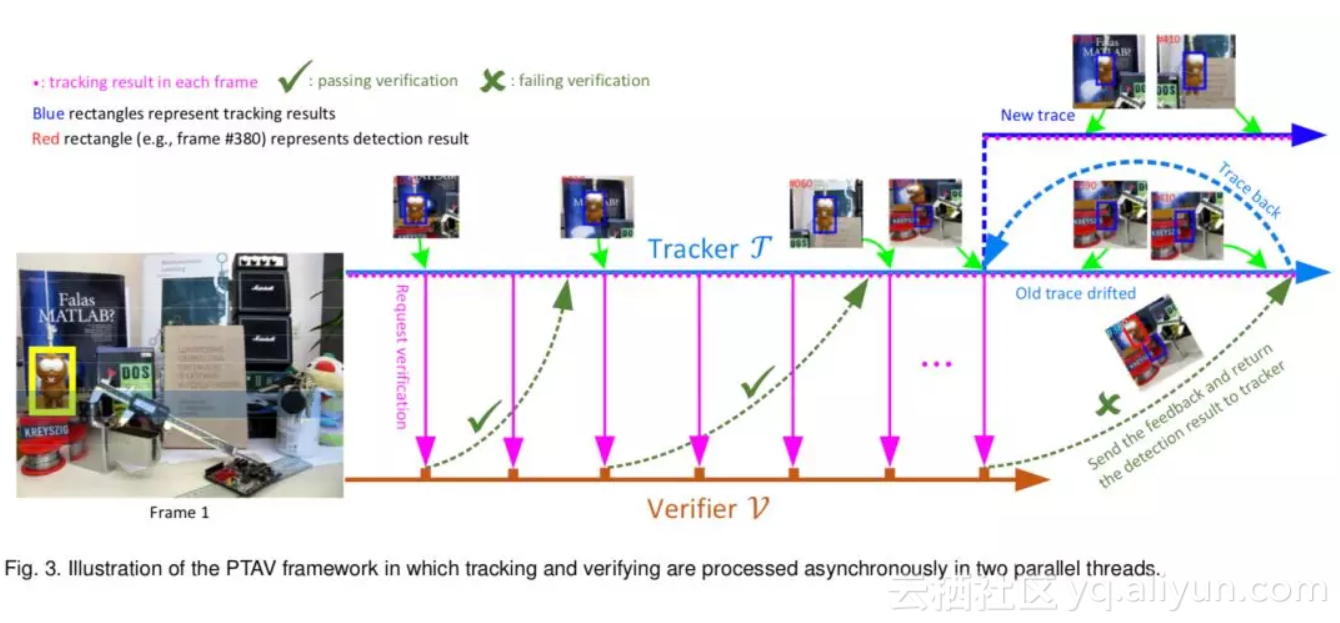

论文将 tracking 过程分解为两个并行但是相互协作的部分:一个用于快速的跟踪(fast tracking),另一个用于准确的验证(accurate verification)。

其实作者之前发布的论文版本 [1] 已被 ICCV 2017 录用,此版本在原文基础上做了进一步的修订。本文所有讨论以 2018 年 1 月 在 arXiv 上发布的版本为准。

该版本在原文基础上做了以下改进:

1. 使用更具有鲁棒性的跟踪器(Staple)提升性能。

2. 动态目标模板池用于自适应验证,放置目标外观的变化。

3. PTAV 的 V 和 T 进行了多方面验证,比如 T 使用 VGGNet 和 AlexNet ,V 使用 KCF、fDSST 和 Staple。

4. 使用更多实时性算法和基准,进行更彻底实验验证和分析。

论文模型

PTAV 算法架构包括三部分:Base Tracker T,Base Verifier V,以及它们之间的协调环节。

对于 T,论文选择的是 Staple 算法 [2]。验证环节 V 则选择采用 Siamese network 验证目标之间的相似性。对于协调环节,T 在合适的频率发送结果给 V,保证足够的时间验证。

为了改善 PTAV 的精度和速率,论文使用 k 均值聚类用于保持动态目标模板池用于自适应验证。

实验

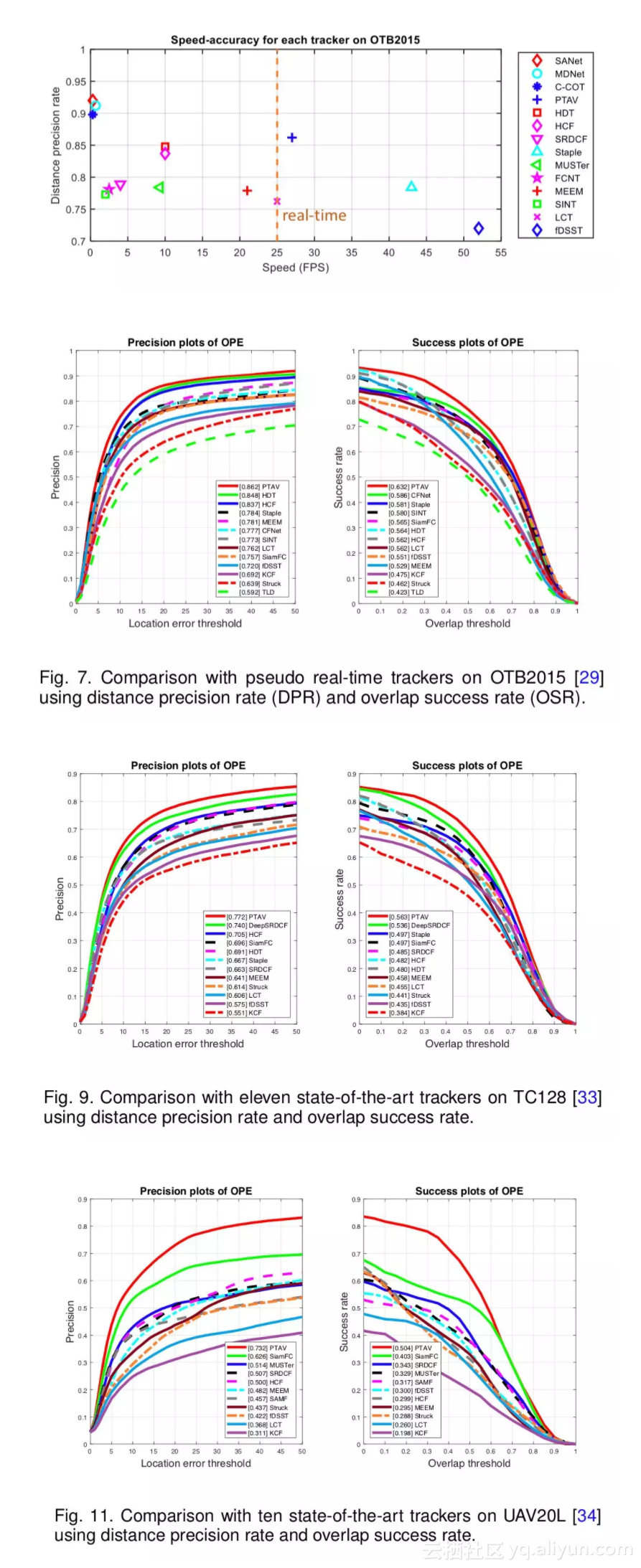

论文的实验数据详实,在主要数据集 OTB2015,TC128,UAV20L 和 VOT2016 上均和典型算法进行了对比。

从精度和实时性考虑各个模型,如图所示,OTB2015 数据集显示效果。

总结

PTAV 的假设是大部分时间目标运动平滑,位置改变很慢。而较难的情况是运动的无规律性。论文提出的 verifying 时刻并不一定是运动改变的时刻,具有偶然性,所以对“打架斗殴”等运动剧烈的情况会失败。10 帧更新速率对 verifying 不是最好的选择。

对于同样视频序列处理的 video segmentation,可以同样考虑。因为视频的逐帧操作比较耗费时间,这种间隔性的验证可大量节约资源。但是,对于剧烈变化的活动,更新会滞后。是否存在自使用速率变化的方法,这样的坑可以继续填。

原文发布时间为:2018-03-20

本文作者:陈泰红

本文来自云栖社区合作伙伴“PaperWeekly”,了解相关信息可以关注“PaperWeekly”微信公众号